有人遇到过类似的问题吗?

我的尝试:

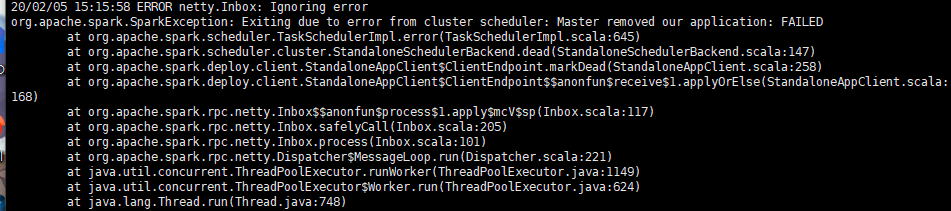

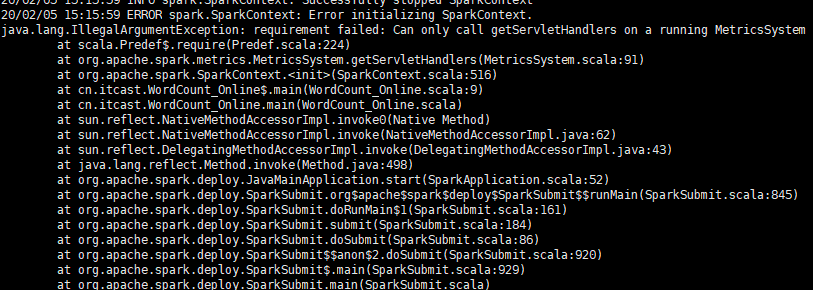

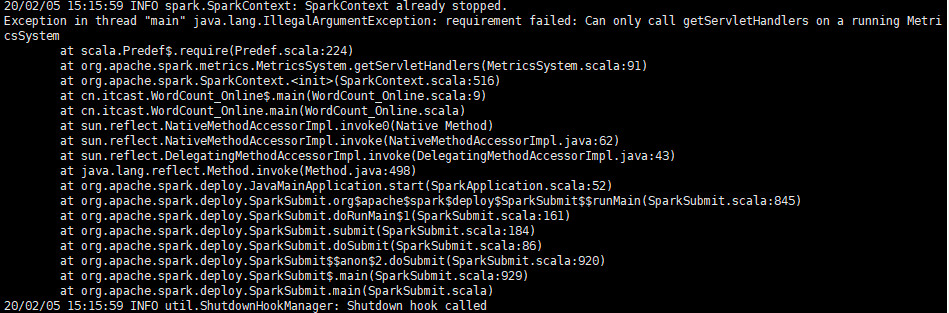

当没Master节点的Worker进程,运行会报错,当开启了Master节点的Worker进程有时不会报错,但是会说内存不够,但是我觉得不是这个问题,也能得出一定的结果,但并不是预期的结果。

执行的命令:bin/spark-submit --master spark://node1:7077 --class cn.itcast.WordCount_Online --executor-memory 1g --total-executor-cores 1 ~/data/spark_chapter02-1.0-SNAPSHOT.jar /spark/test/words.txt /spark/test/out

jar包是在idea中打包的,用的是scala语言,主要作用是词频统计

scala代码:

package cn.itcast

import org.apache.spark.rdd.RDD

import org.apache.spark.{SparkConf, SparkContext}

object WordCount_Online {

def main(args: Array[String]):Unit={

val sparkConf = new SparkConf().setAppName("WordCount_Online")

val sparkContext = new SparkContext(sparkConf)

val data : RDD[String] = sparkContext.textFile(args(0))

val words :RDD[String] = data.flatMap(_.split(" "))

val wordAndOne :RDD[(String,Int)] = words.map(x => (x,1))

val result :RDD[(String,Int)] = wordAndOne.reduceByKey(_+_)

result.saveAsTextFile(args(1))

sparkContext.stop()

}

}

我也做了很多尝试,希望懂的人可以交流一下