遇到如下问题,求教大神:

集群有三个节点,111为master。剩余两个为slave。每个节点 4核,6.6G。

提交命令如下

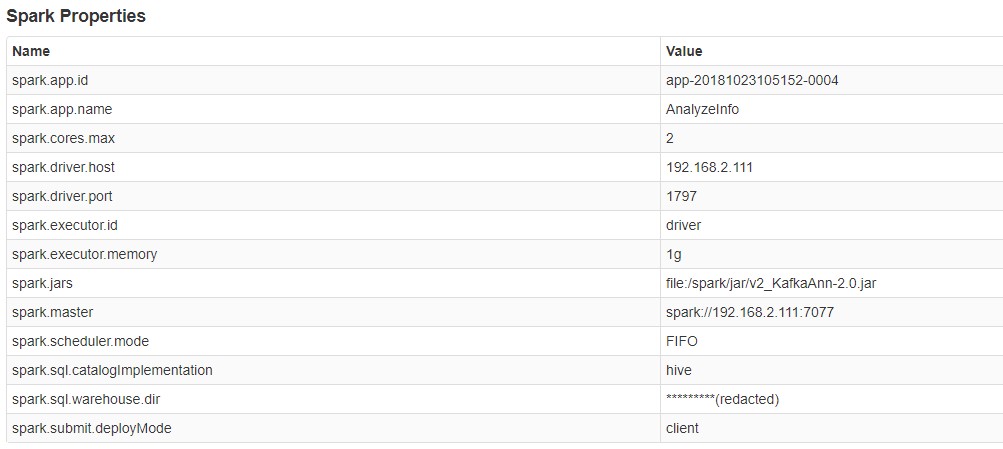

nohup bin/spark-submit --master spark://sousou:7077 --executor-memory 1g --total-executor-cores 2 --class AnalyzeInfo /spark/jar/v2_AnalyzeInfo.jar &

nohup bin/spark-submit --master spark://sousou111:7077 --executor-memory 1g --total-executor-cores 2 --class SaveInfoMain /spark/jar/saveAnn.jar &

问题如下:

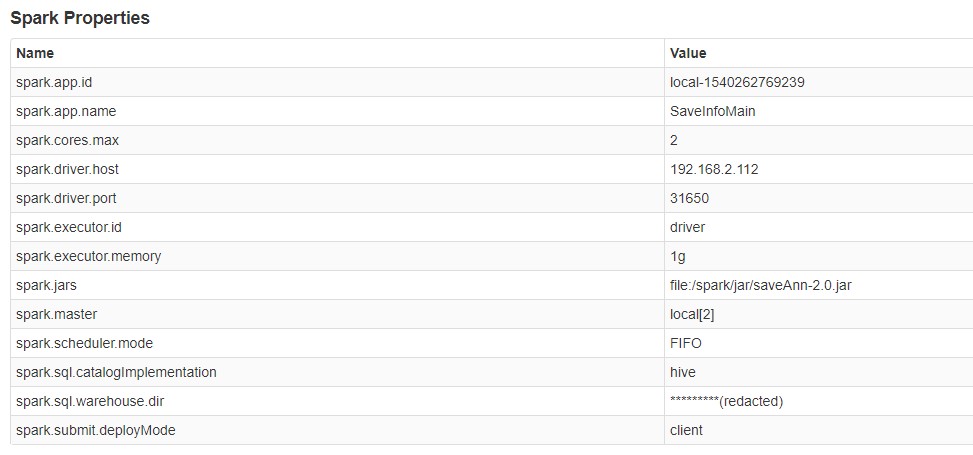

1. spark submit 提交集群任务后,spark Web UI界面不显示SaveInfoMain,但是有4040界面,且查看界面Environment显示local模式。这是为什么啊?这样造成的问题是程序没有办法在界面停止。且这个程序有时候会造成处理数据异常缓慢,偶尔处理三四个小时之前的数据,AnalyzeInfo这个任务就不会产生这个问题。

2. 而且这两个任务出现的共同点是:我设置的触发HDFS上的目录下文件就优雅停止程序,刚运行时还可以,但是这两个程序运行时间长了,比如说一天后我上传到HDFS上文件,这两程序就不能成功停止了。

Environment图片如下: