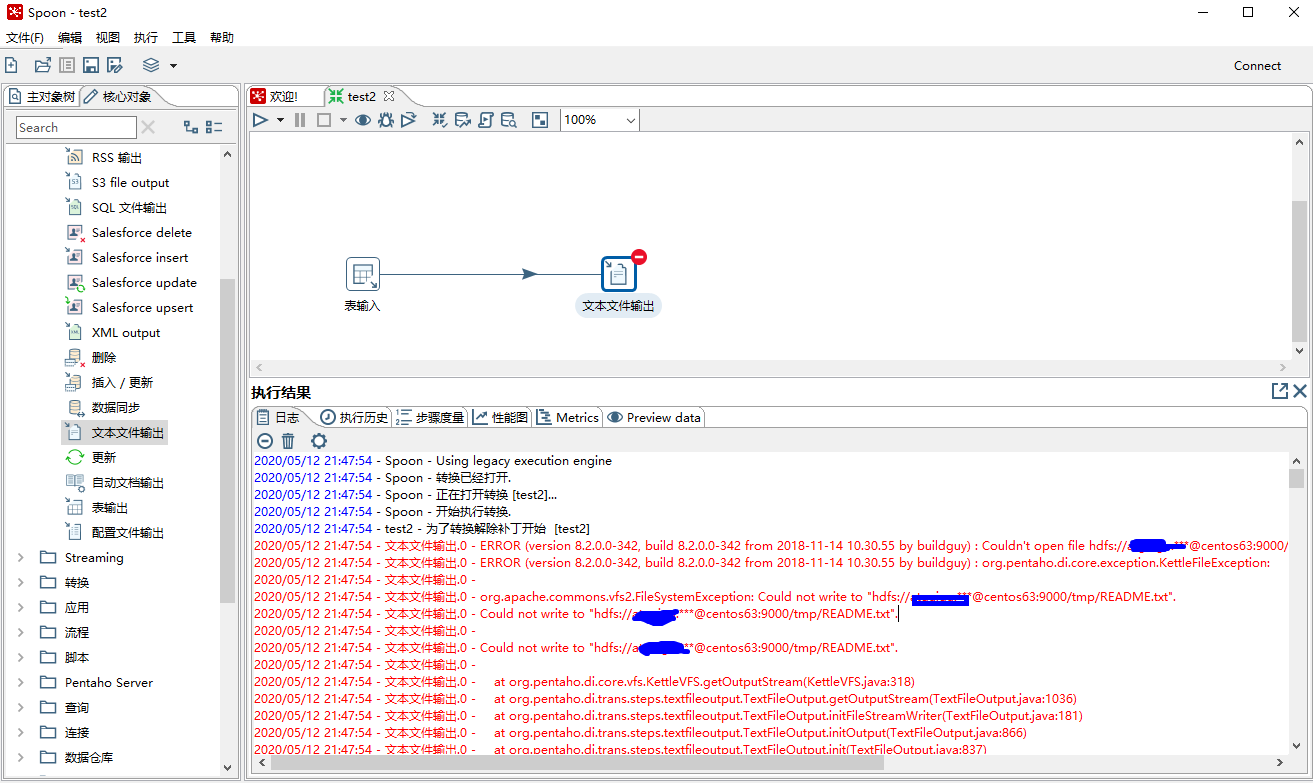

本地kettle,插件文件夹中复制了集群的hadoop的几个site配置文件的,集群是正常的,测试kettle从mysql导数据到hdfs就报错:Couldn't open file hdfs .

“表输入”是正常的,可以预览读取的mysql数据。

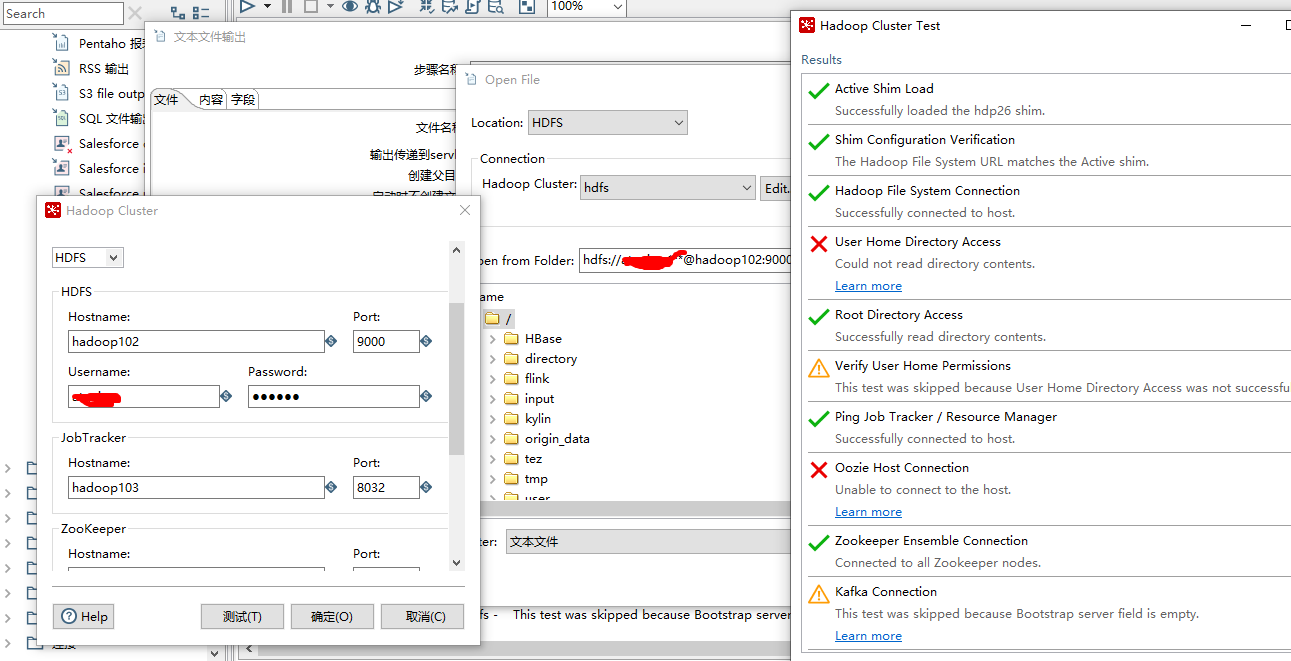

“文本文件输出”中在配置hdfs的时候,也能看到hdfs中的文件

用户名、密码是正确的,hostname、端口这些应该也没问题,就是执行就报错

刚才在网上无意中发现了一个配置,在kettle.properties 增加HADOOP_USER_NAME= 访问hdfs的用户名,增加了这个就可以用了 。。。终于解决了这个问题!~