代码如下:

-*- coding:utf-8 -*-

import urllib

import urllib2

import re

baseURL = 'http://zhidao.baidu.com/question/491268910.html'

headers = {'User-Agent':'Mozilla/5.0 (Windows NT 6.1; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/49.0.2623.110 Safari/537.36'}

#request = urllib2.Request(baseURL)

request = urllib2.Request(url=baseURL,headers=headers)

response = urllib2.urlopen(request)

print response.read().decode("GBK")

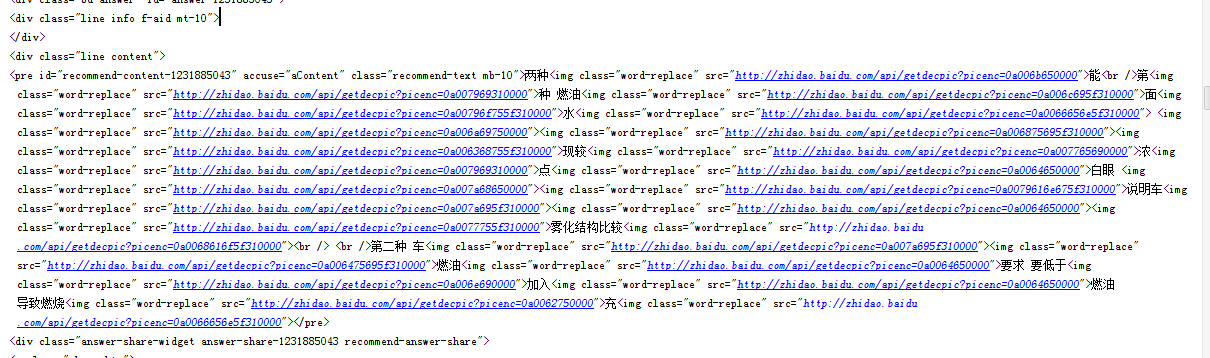

我用上面的代码爬取一个百度知道的答案,把抓取到的信息打印出来为什么有的地方跟网页审查元素所显示的代码不一样?

网页原来的段落为:

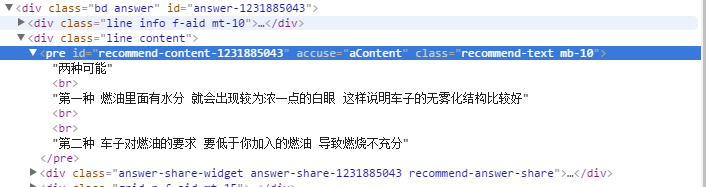

这段话对应的源代码为:

抓取网页信息后的对应的代码为:

我尝试了一个,在提取页面时,加载一个headers头部,但是结果还是不行,求各路大神指点,直接把解决办法附在评论区里,谢谢各路大神了。。。