在抓取https://mm.taobao.com/search_tstar_model.htm?spm=719.1001036.1998606017.2.4Cf8Nt

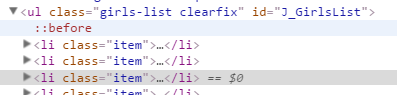

的时候发现::before和::after之间的元素抓取不到,通过BeautifulSoup解析出来的对象中寻找不到"li"标签。

请问这是“::before”引起的问题吗?如果是,如何解决?如果不是,可能是什么问题?

期待回复,谢谢!

用python抓取爬虫时无法抓取::before与::after之间的内容

- 写回答

- 好问题 0 提建议

- 追加酬金

- 关注问题

- 邀请回答

-

3条回答 默认 最新

oyljerry 2016-10-06 04:23关注

oyljerry 2016-10-06 04:23关注可能是Ajax异步加载的。需要用selenium等模拟浏览器

本回答被题主选为最佳回答 , 对您是否有帮助呢?解决 无用评论 打赏 举报

悬赏问题

- ¥15 这是哪个作者做的宝宝起名网站

- ¥60 版本过低apk如何修改可以兼容新的安卓系统

- ¥25 由IPR导致的DRIVER_POWER_STATE_FAILURE蓝屏

- ¥50 有数据,怎么建立模型求影响全要素生产率的因素

- ¥50 有数据,怎么用matlab求全要素生产率

- ¥15 TI的insta-spin例程

- ¥15 完成下列问题完成下列问题

- ¥15 C#算法问题, 不知道怎么处理这个数据的转换

- ¥15 YoloV5 第三方库的版本对照问题

- ¥15 请完成下列相关问题!