关注

码龄 粉丝数 原力等级 --

- 被采纳

- 被点赞

- 采纳率

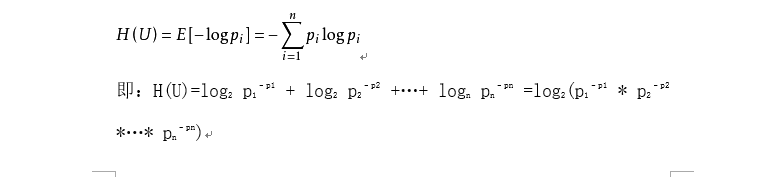

怎么证明信息熵的最大值取决于n

收起

- 写回答

- 好问题 0 提建议

- 关注问题

微信扫一扫点击复制链接

微信扫一扫点击复制链接分享

- 邀请回答

- 编辑 收藏 删除 结题

- 收藏 举报

0条回答 默认 最新

报告相同问题?

提交

- 2019-09-03 21:25王延凯的博客的博客 关于信息熵最大值的讨论最大离散熵定理均值受限的最大熵值 最大离散熵定理 \qquad一般的离散信源的r个概率分量分别为 p1,p_1,p1,p2,p_2,p2,...,...,...,pr,p_r,pr,必须满足条件∑i=1rpi=1\sum_{i=1}^rp_i=1∑i...

- 2026-01-15 18:59Atticus-Orion的博客 信息熵(H(X))是衡量信源不确定性的核心指标,通过比较沙漠和伦敦天气预报员的案例说明:确定性高的信源(如沙漠99%晴天)熵值低(0.11比特),信息量少且易压缩;随机性强的信源(如伦敦多变天气)熵值高(2比特)...

- 2021-01-15 23:38li-yizhi的博客 熵的单位通常为比特,但也用Sh、nat、Hart计量,取决于定义用到对数的底。 熵的概念最早起源于物理学,用于度量一个热力学系统的无序程度。在信息论里面,熵是对不确定性的测量。但是在信息世界,熵越高,则能传输越...

- 2024-01-10 02:32光子AI的博客 信息熵(Information entropy)是一种度量信息的方法,它...HX−∑i1nPxilog2PxiHX−i1∑nPxilog2Pxi其中,HXH(X)HX是信息熵,XXX是一个随机变量,xix_ixi是XXX的取值,PxiP(x_i)Pxi是xix_ixi的概率。

- 2021-03-17 12:01熊江乔的博客 日常工作中经常需要确定各个指标的权重,利用熵值法确定权重属于客观赋权法,从数据出发,避免过强的主观性,但是也同时带来了一些问题。在某个论坛的帖子中,作者提出了这样的一个问题:“熵值法用于确定权重是否...

- 2024-12-23 12:14具身机器人曾小健的博客 −logP(x)(信息量)-\log P(x) \quad \text{(信息量)}−logP(x)(信息量)它在信息论中是一个核心概念,广泛用于描述随机过程的复杂性、信息量和数据压缩效率。随机变量 XXX 的某个可能取值 xxx 的概率。香农熵...

- 2016-11-25 21:18-柚子皮-的博客 熵/信息熵http://这篇文章主要讲:熵, 联合熵(joint...熵/信息熵在信息论中,熵是接收的每条消息中包含的信息的平均量,又被称为信息熵、信源熵、平均自信息量。这里, 消息代表来自分布或数据流中的事件、样本或特征。

- 2024-08-19 23:14感谢地心引力的博客 延迟互信息(熵、概率密度、高斯核、带宽估计)。

- 2025-09-12 01:30cherry的博客 本文深入探讨了信息熵在逆向工程中识别加壳文件的核心应用。通过对比手工计算、Python原生实现与pyEntropy库三种方法,详细解析了其原理、性能与适用场景,并结合PE文件分析实践,为安全研究人员提供了高效检测恶意...

- 2025-03-30 21:46徐福记c的博客 统计意义上,信息熵反映了随机变量的平均不确定性,熵值越大,不确定性越高;例如,熵值为 (H(X)) 的随机变量,理论上可以用 (H(X)) 比特的平均长度进行无损编码。它假设在满足某些约束条件的情况下,选择熵最大的...

- 2026-04-12 22:49未收敛的博客 **最大值$\log_2 n$**出现在均匀分布(各事件概率相等),此时系统最难预测。通过函数分析和拉格朗日法可严格证明该结论。熵本质衡量系统整体不确定性:分布越集中熵越小,越均匀熵越大。需注意熵反映的是分布结构...

- 2019-07-13 22:59yipala的博客 单位取决于定义用到对数的底。当b = 2,熵的单位是bit;当b = e,熵的单位是nat;而当b = 10,熵的单位是 Hart。 熵的取值范围 从定义式,我们可以看出,虽然信息熵经常被称为负熵,但是其取值恒为正,这是因为pi恒...

- 2024-07-08 23:02Infor_Theory_AHU的博客 信息熵(Information Entropy)由克劳德·香农(Claude Shannon)在1948年的论文《通信的数学理论》中提出,用来...熵的单位取决于对数的底数,常用的单位有比特(底数的对数)和纳特(底数为e的自然对数)。离散信源。

- 2024-07-04 21:44m0_53623159的博客 对于一个离散随机变量XXX和其概率分布PXP(X)PX,熵HXH(X)HXHX−∑iPxilogPxiHX−i∑PxilogPxiPxiP(x_i)Pxi是随机变量XXX取值xix_ixi的概率。对数底数可以是 2(熵的单位为比特)、自然对数(熵的单位为...

- 没有解决我的问题, 去提问