3条回答 默认 最新

summerstars 2017-08-03 07:53关注

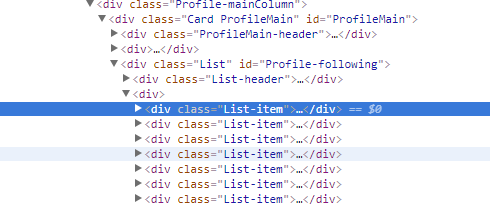

summerstars 2017-08-03 07:53关注因为zhihu网页不是静态html页面,截图中的html代码是浏览器渲染后最终的代码,不是URL对应的原始html代码。

1.Chrome按F12,点击network。F5刷新页面,第1个URL对应的Response是原始html代码。分析它,重新修改python脚本。

2.使用phantomjs渲染后再获取html代码评论 打赏 举报解决 4无用

悬赏问题

- ¥60 更换迈创SOL6M4AE卡的时候,驱动要重新装才能使用,怎么解决?

- ¥15 让node服务器有自动加载文件的功能

- ¥15 jmeter脚本回放有的是对的有的是错的

- ¥15 r语言蛋白组学相关问题

- ¥15 Python时间序列如何拟合疏系数模型

- ¥15 求学软件的前人们指明方向🥺

- ¥50 如何增强飞上天的树莓派的热点信号强度,以使得笔记本可以在地面实现远程桌面连接

- ¥20 双层网络上信息-疾病传播

- ¥50 paddlepaddle pinn

- ¥20 idea运行测试代码报错问题