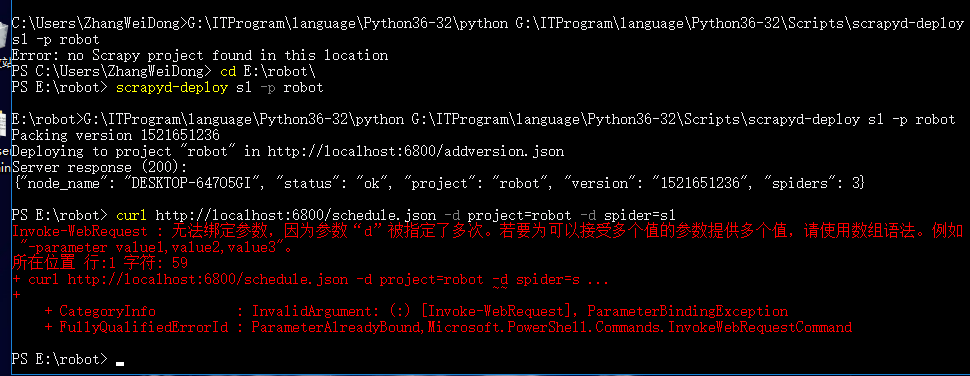

就是网上运行爬虫这一步一直有问题,求解!

命令:curl http://localhost:6800/schedule.json -d project=robot -d spider=s1

scrapyd 运行爬虫失败,求解!!!!

- 写回答

- 好问题 0 提建议

- 追加酬金

- 关注问题

- 邀请回答

-

2条回答 默认 最新

悬赏问题

- ¥15 三菱伺服电机按启动按钮有使能但不动作

- ¥20 为什么我写出来的绘图程序是这样的,有没有lao哥改一下

- ¥15 js,页面2返回页面1时定位进入的设备

- ¥200 关于#c++#的问题,请各位专家解答!网站的邀请码

- ¥50 导入文件到网吧的电脑并且在重启之后不会被恢复

- ¥15 (希望可以解决问题)ma和mb文件无法正常打开,打开后是空白,但是有正常内存占用,但可以在打开Maya应用程序后打开场景ma和mb格式。

- ¥20 ML307A在使用AT命令连接EMQX平台的MQTT时被拒绝

- ¥20 腾讯企业邮箱邮件可以恢复么

- ¥15 有人知道怎么将自己的迁移策略布到edgecloudsim上使用吗?

- ¥15 错误 LNK2001 无法解析的外部符号