有偿解答,解决了可商量

各位大佬,请教个问题:

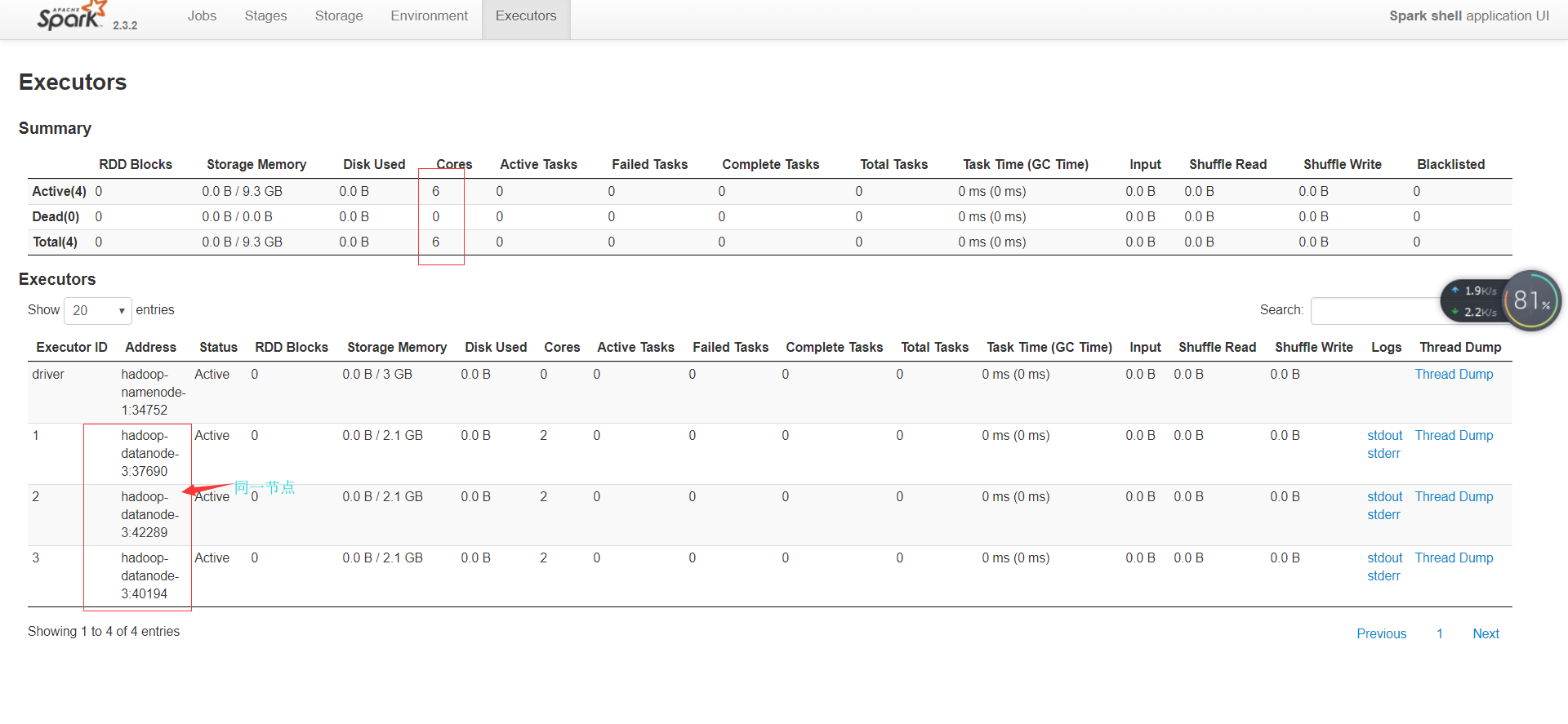

集群为三节点计算节点。

现在我提交spark作业到yarn的时候,出现会把单个作业的所有资源分配给同一个节点的情况,这个需要怎么解决?

比如:提交spark作业的时候分配的资源为:

--num-executors 3 --executor-cores 2 --executor-memory 4g

第一次提交的时候申请到的资源全部都是datanode1节点的资源

第二次提交的时候申请到的资源全部都是datanode2节点的资源