spark rdd,看网上都说调用getPartions中的sclie中的分区中分区规则,好奇是如何调用getPartions ?我的季理解是new rdd,为啥还调用了方法?

关注

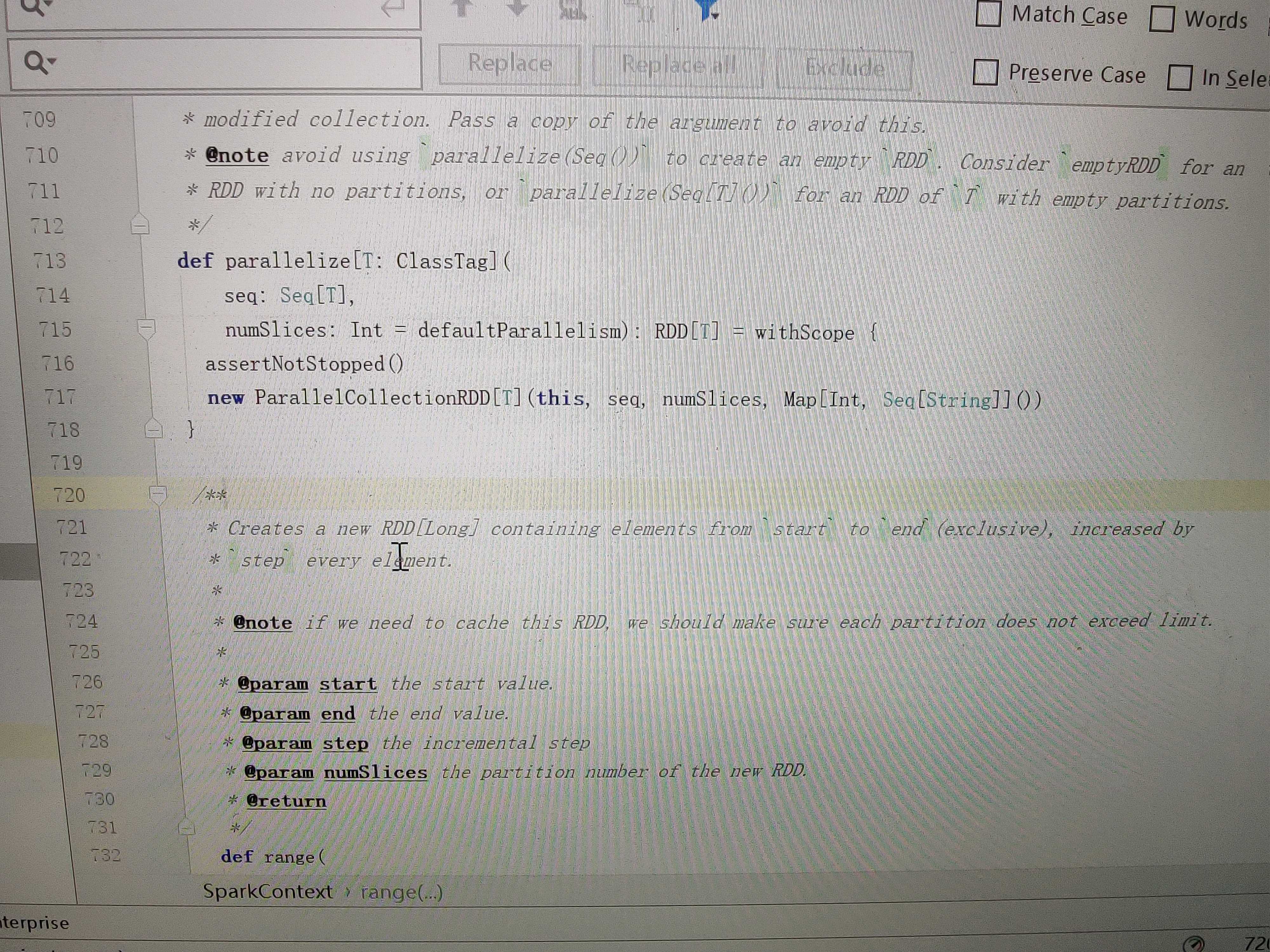

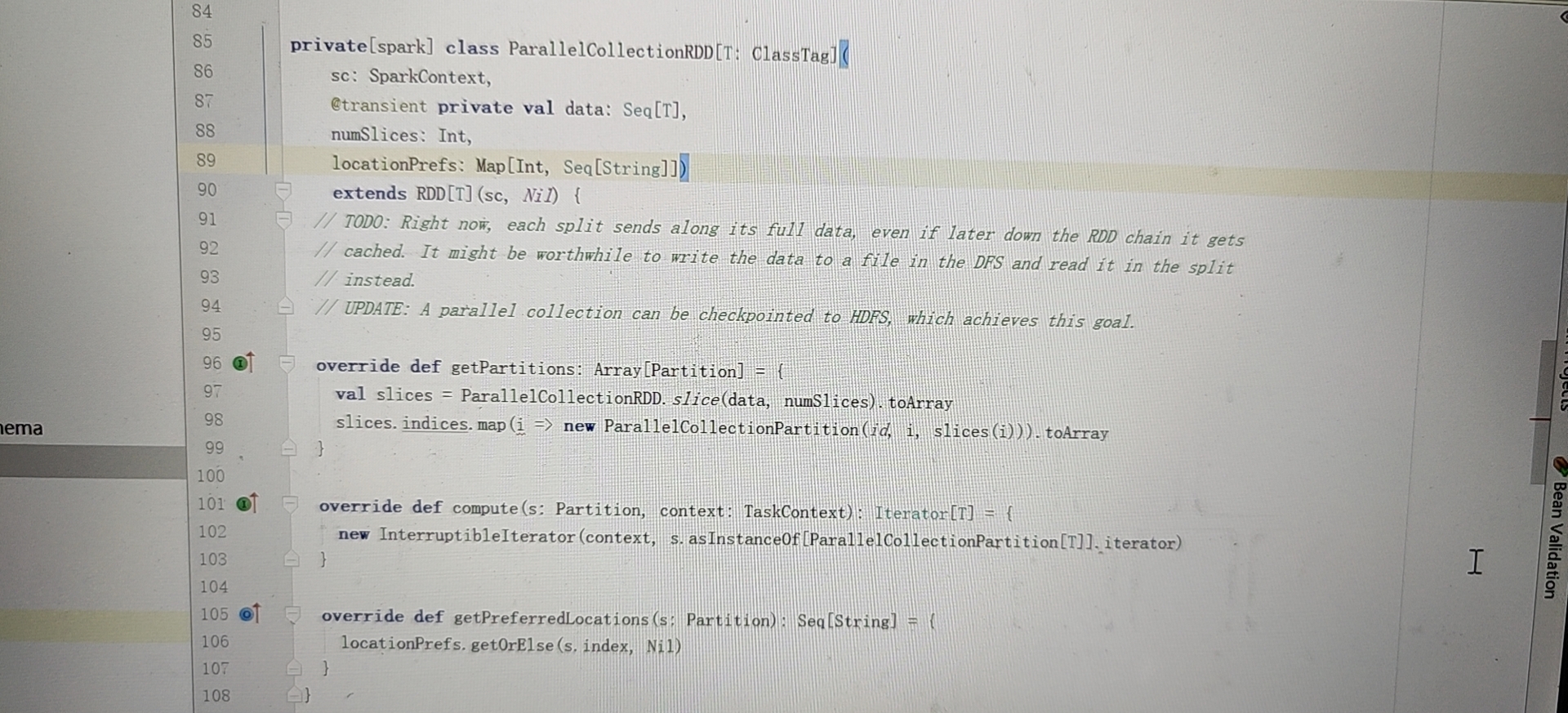

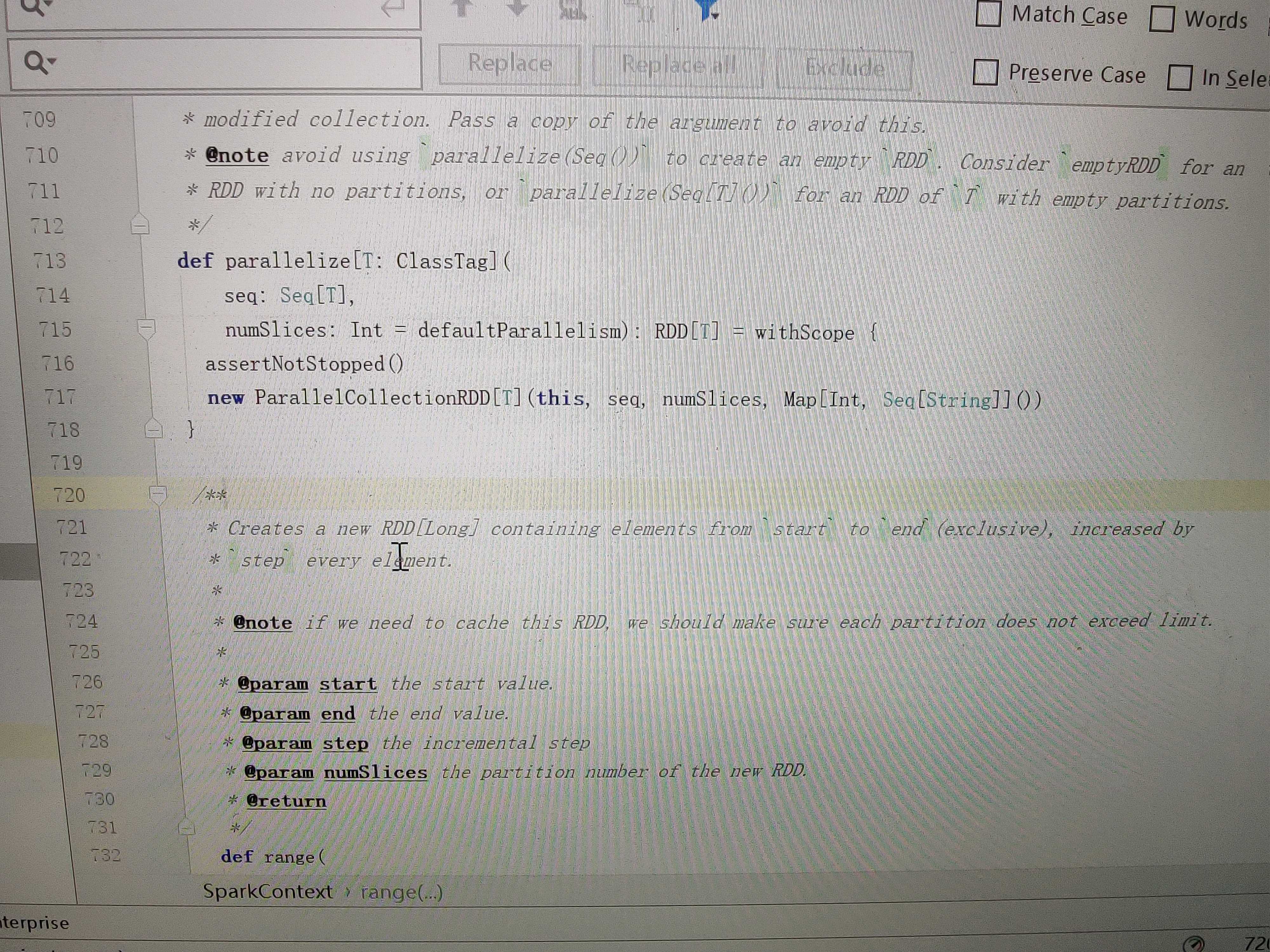

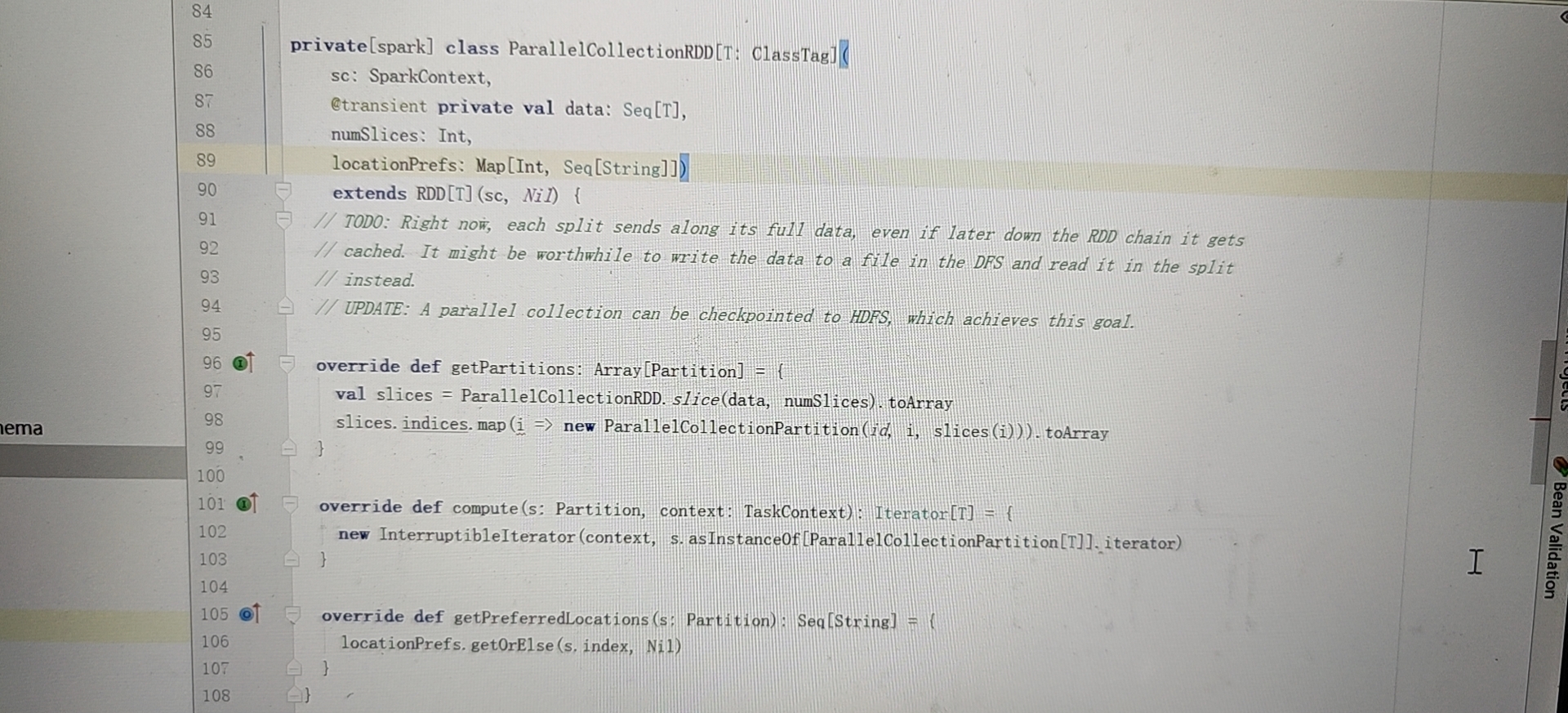

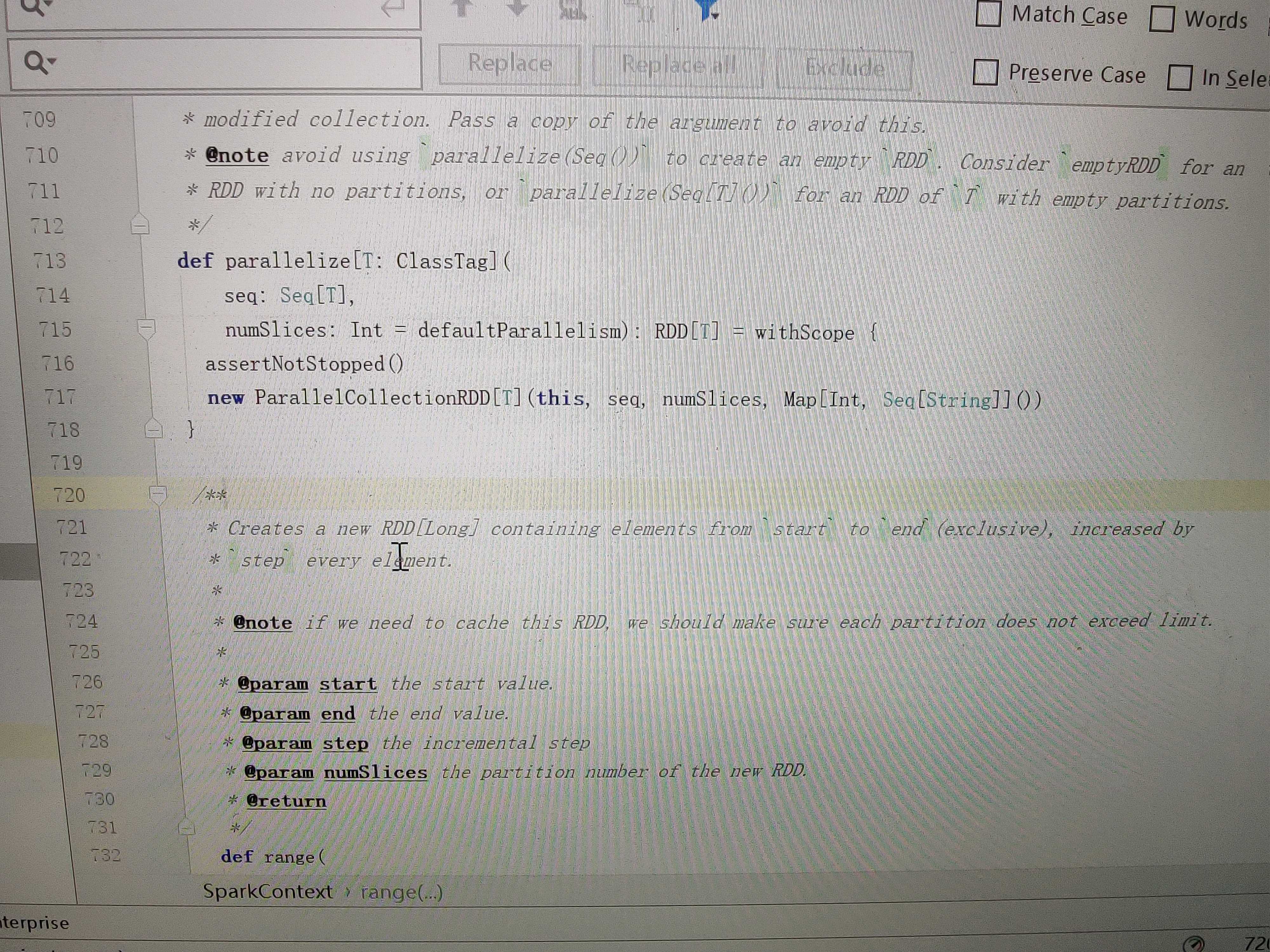

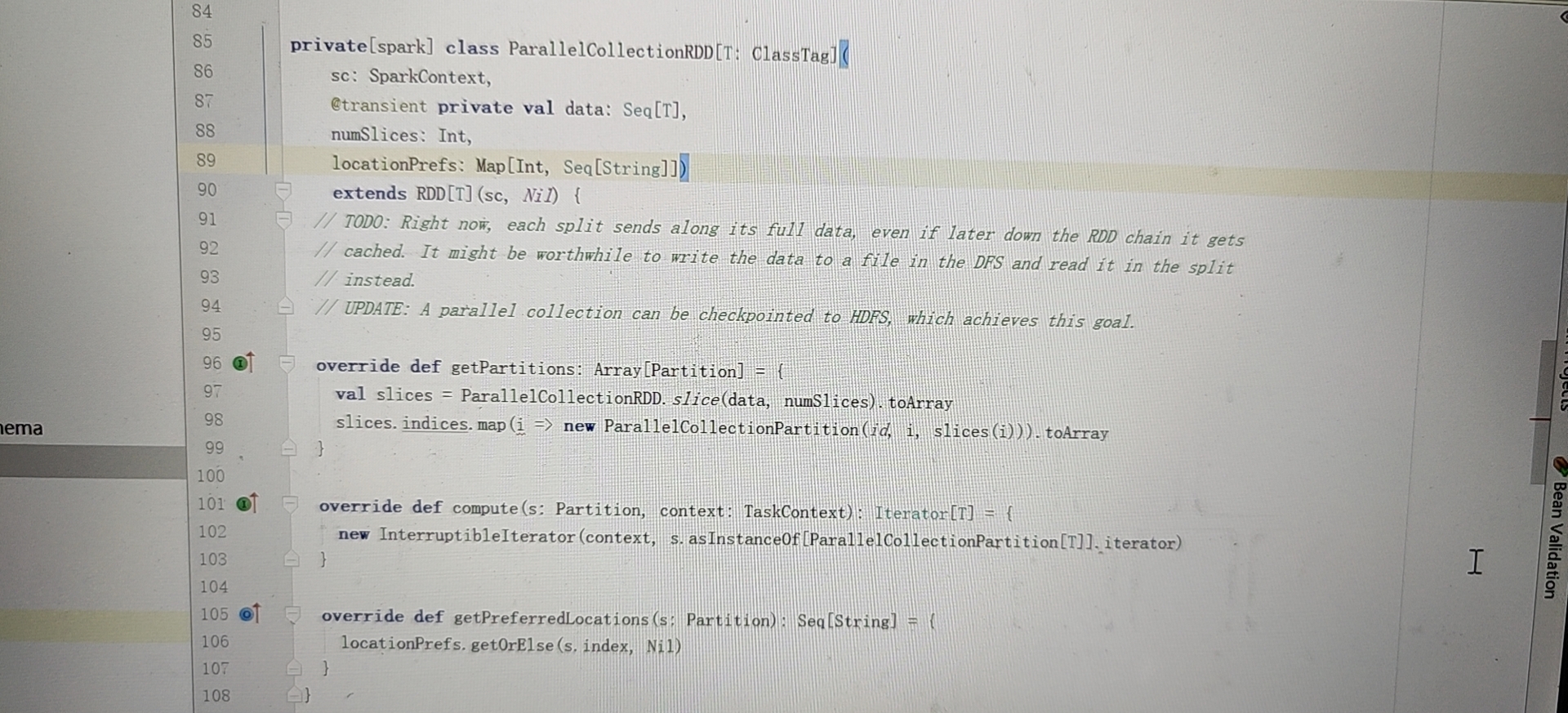

关注让阿豪来帮你解答,本回答参考chatgpt3.5编写提供,如果还有疑问可以评论或留言首先,让我们来解释一下RDD的`getPartitions`方法以及如何调用它。 在Spark中,`getPartitions`方法是RDD的一个方法,用于获取RDD的分区信息。每个RDD都有一个分区器`Partitioner`来决定数据如何被划分到不同的分区中。在调用`getPartitions`方法时,实际上是在获取RDD的分区信息,包括分区的数量、分区的规则等。 在实际应用中,我们通常不会直接调用`getPartitions`方法来获取分区信息,而是通过Spark的API来创建RDD,Spark会在内部调用`getPartitions`方法来获取分区信息。例如,在创建一个新的RDD时,可以指定分区的数量或者使用默认的分区规则。 下面是一个简单的示例代码,演示如何创建一个RDD并获取其分区信息:

from pyspark import SparkContext

# 创建SparkContext

sc = SparkContext("local", "Simple App")

# 创建一个包含0到9的RDD

rdd = sc.parallelize(range(10))

# 获取RDD的分区信息

partitions = rdd.getNumPartitions()

print("Number of partitions: ", partitions)

sc.stop()

在这个示例中,我们使用parallelize方法创建了一个包含0到9的RDD,并通过getNumPartitions方法获取了RDD的分区数量。实际上,在创建RDD时,Spark会根据默认的分区规则将数据划分到不同的分区中。 总的来说,调用getPartitions方法是为了获取RDD的分区信息,而在实际应用中,我们通常通过Spark的API来创建RDD,Spark会在内部调用getPartitions方法来获取分区信息。