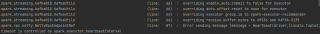

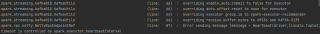

应该是sparkstreaming对接kafka的时候出现数据积压的问题,报错如下:

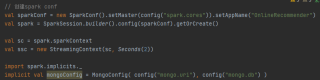

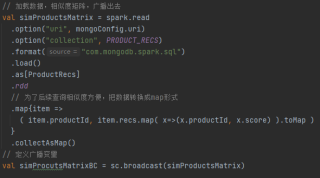

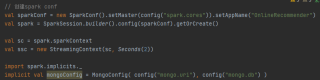

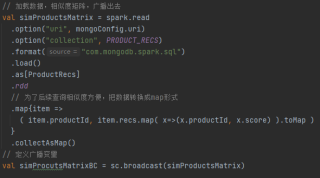

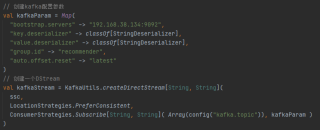

部分代码:

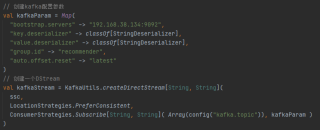

试过手动配置offsets,还是报错

val offsets = collection.Map[TopicPartition, Long] {

new TopicPartition(“recommender”, 0.toInt) -> 21

}

有没有大佬能解决的!!卡了好久了

应该是sparkstreaming对接kafka的时候出现数据积压的问题,报错如下:

部分代码:

试过手动配置offsets,还是报错

val offsets = collection.Map[TopicPartition, Long] {

new TopicPartition(“recommender”, 0.toInt) -> 21

}

有没有大佬能解决的!!卡了好久了