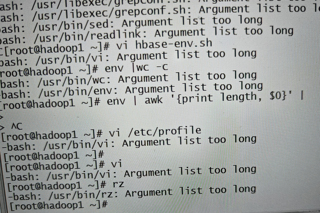

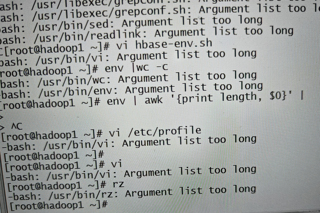

crt无论输入什么命令都无法运行成功,想问问怎么解决,最好详细一点一步一步来,因为刚开始学 专业术语可能听不太懂谢谢大家

crt无论输入什么命令都无法运行成功,想问问怎么解决,最好详细一点一步一步来,因为刚开始学 专业术语可能听不太懂谢谢大家

以下内容由CHATGPT及阿里嘎多学长共同生成、有用望采纳:

从您提供的日志信息来看,您在Hadoop环境中使用bash shell时遇到了“Argument list too long”的错误。这个问题通常是由于命令行参数过多导致的。在您的情况下,看起来是在尝试编辑配置文件或执行命令时,由于环境变量或命令本身参数过长,超出了系统的限制。

下面是一些解决这个问题的步骤:

检查环境变量:这个错误可能是由于您的环境变量设置不当导致的。例如,PATH 环境变量如果太长,可能会导致这个问题。您可以使用 echo $PATH 来查看当前的 PATH 环境变量。

编辑配置文件:如果您在尝试编辑配置文件时遇到这个错误,可以尝试使用不同的文本编辑器,或者在命令行中减少参数的数量。例如,使用 nano 而不是 vi,因为 nano 可能需要的参数更少。

使用命令行参数:如果问题是由于命令行参数过长,尝试将参数写入一个文件中,然后使用 @ 符号来引用这个文件。例如:

echo '参数列表' > params.txt

命令 @params.txt

修改bash的配置:如果问题是由于bash的内部限制导致的,您可以尝试增加bash的参数列表长度限制。这可以通过修改 /etc/profile 或 ~/.bashrc 文件来实现,添加如下行:

export ARG_MAX=131072 # 或者更大的值

然后重新加载配置文件:

source /etc/profile

使用更长的命令行:如果可能的话,尝试使用更长的命令行,例如 env -i 来启动一个新的shell环境,不使用当前的环境变量。

查看日志文件:您提供的日志文件显示了错误信息,但可能没有提供足够的上下文来确定问题的具体原因。检查您的Hadoop配置文件和日志文件,看看是否有更详细的错误信息。

搜索相关文档:您可以搜索Hadoop的官方文档,了解如何配置环境变量和解决常见问题。Hadoop的官方文档地址是:Apache Hadoop

社区支持:如果上述方法都不能解决问题,您可以在Hadoop社区论坛或Stack Overflow等平台上寻求帮助。

请注意,这些步骤可能需要根据您的具体情况进行调整。如果您需要更详细的指导或代码示例,请提供更多的上下文信息,例如您尝试执行的具体命令和您的Hadoop版本。