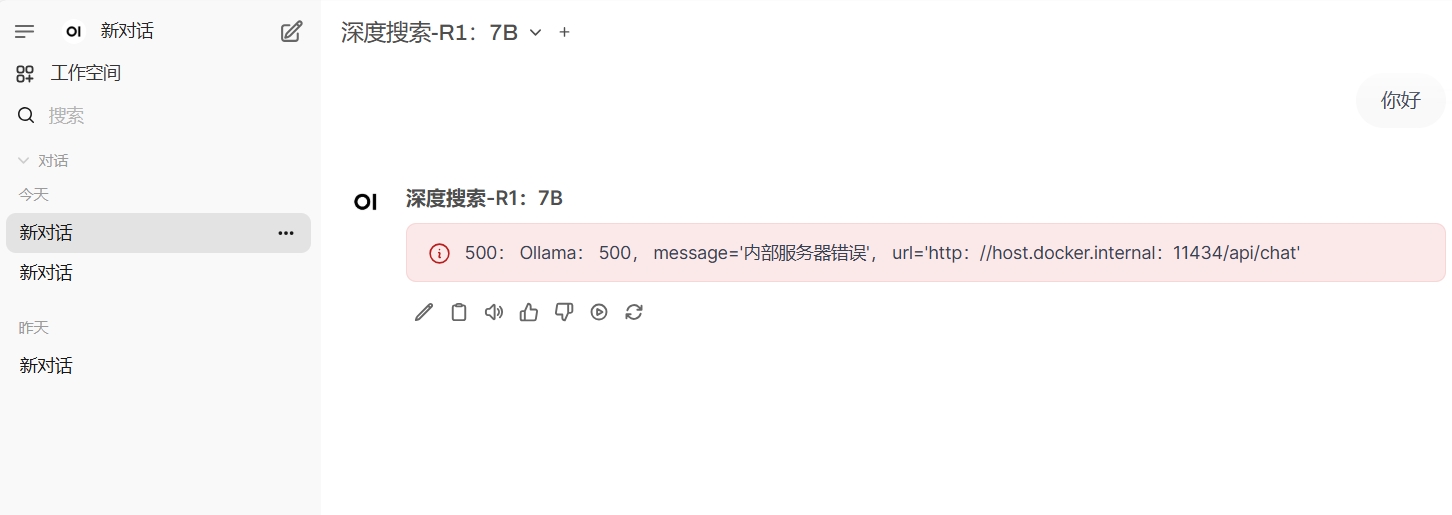

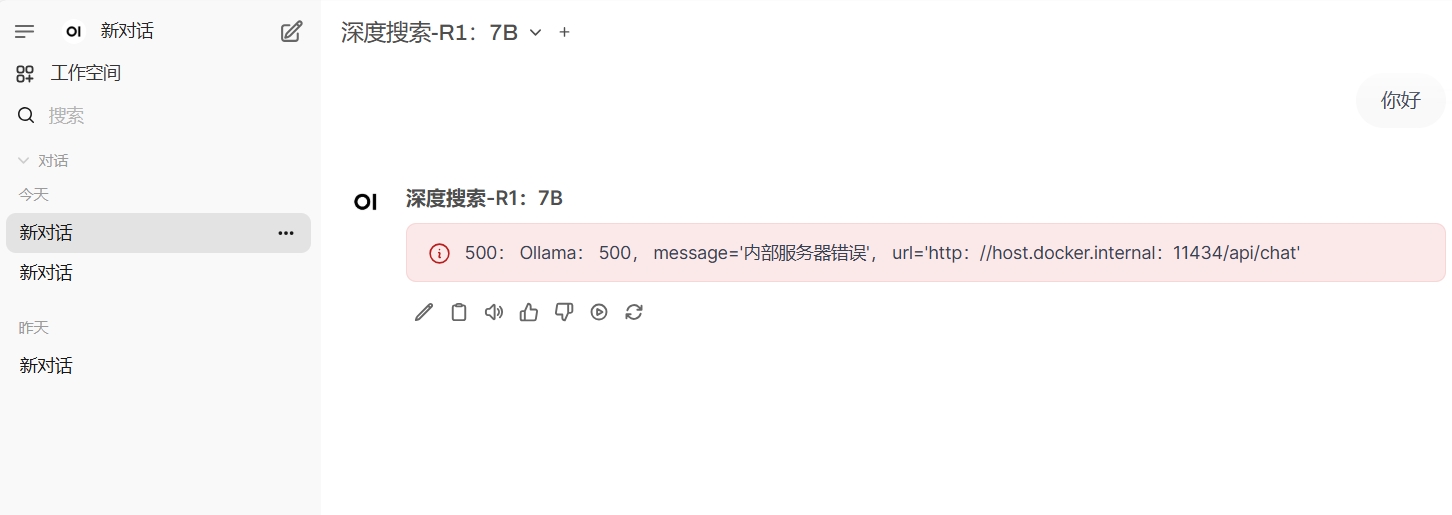

博主您好,我在docker+ollama本地部署过程中 open webui 打开对话时出现了500: Ollama: 500, message='内部服务器错误', url='http://host.docker.internal:11434/api/chat' 这个问题,请问您知道如何解决吗? 打扰了

博主您好,我在docker+ollama本地部署过程中 open webui 打开对话时出现了500: Ollama: 500, message='内部服务器错误', url='http://host.docker.internal:11434/api/chat' 这个问题,请问您知道如何解决吗? 打扰了

关注

关注让 “紫雾凌寒” 来帮你回答,本回答结合 DeepSeek

如果还有问题,请评论或点击头像私信,如果有帮助到您, 请关注、采纳、点赞

bash

ollama serve --model mymodeljavascript

// 在open webui的配置文件中

const ollamaApiUrl = 'http://host:ollama_port/api/generate';host和ollama_port正确,并且ollama确实在监听该端口。希望以上解答对您有所帮助。如果您有任何疑问,欢迎在评论区提出。