请问我目前使用chatbox作为我的科研工具。

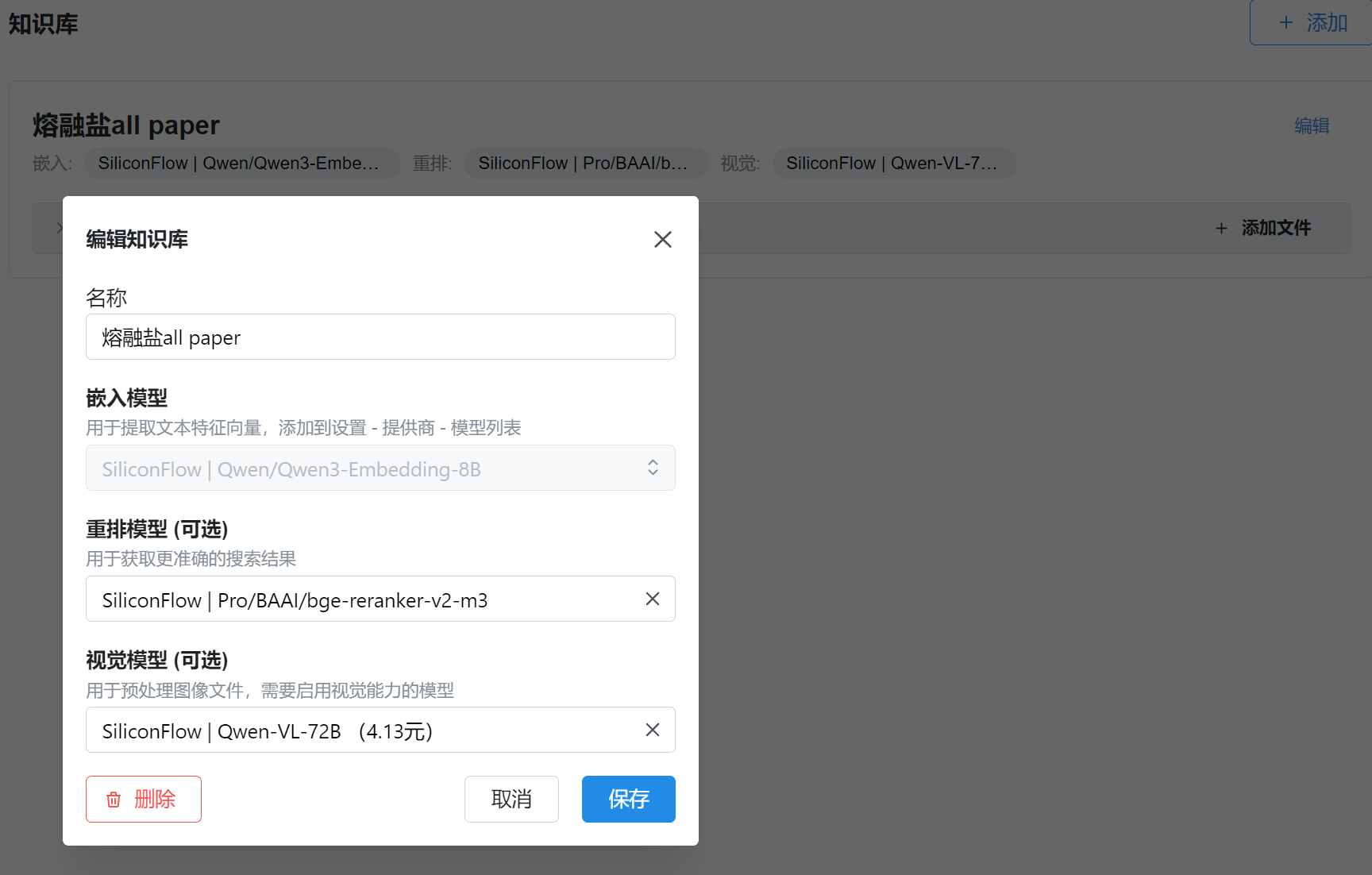

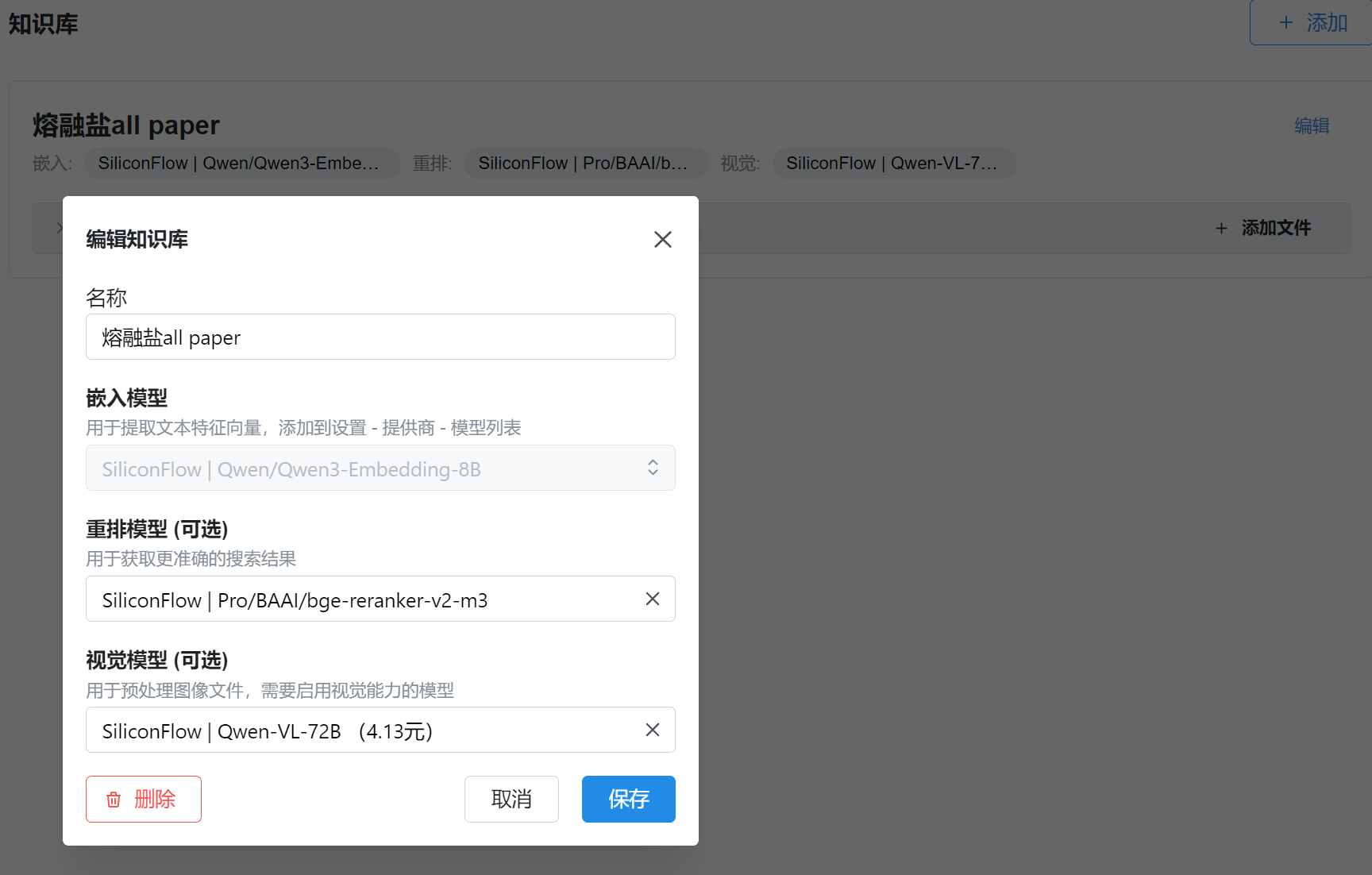

往知识库中直接导入了文献的PDF文件(使用了硅基流动的嵌入和重排序模型),随后让ai在撰写论文和报告时调用知识库中的文献作为参考文献。

目前的问题是ai对知识库中文献的识别似乎不是很准确,经常输出错误的参考文献,比如文章题目、时间、作者对应不上,有时候是吧A文献的题目匹配到了B文献上面。有时还会提供不存在的文章。

目前我想到的方法是把所有文献的信息提取出来保存成TXT格式。

请问这种方法是否可行,或者说有没有更好的办法

请问我目前使用chatbox作为我的科研工具。

往知识库中直接导入了文献的PDF文件(使用了硅基流动的嵌入和重排序模型),随后让ai在撰写论文和报告时调用知识库中的文献作为参考文献。

目前的问题是ai对知识库中文献的识别似乎不是很准确,经常输出错误的参考文献,比如文章题目、时间、作者对应不上,有时候是吧A文献的题目匹配到了B文献上面。有时还会提供不存在的文章。

目前我想到的方法是把所有文献的信息提取出来保存成TXT格式。

请问这种方法是否可行,或者说有没有更好的办法

关注

关注让【宝码香车】来帮您解答,本回答参考DeepSeek编写,并整理提供。

如果答案让您满意,请采纳、点赞、关注,非常感谢!

.

每日一句正能量,让它带给您好心情:世界上没有白费的努力,只有不为人知的坚持。

.

您好!您遇到的这个问题非常典型,是使用AI知识库进行学术研究时的一个核心挑战。您能想到将文献信息提取成TXT,这个方向是完全正确的,但这只是优化流程中的一步。下面我为您详细分析原因并提供一套更系统、更可靠的解决方案。

您遇到的“张冠李戴”和“虚构文献”问题,主要源于以下几个技术环节的局限性:

您提出的“提取文献信息保存成TXT”是可行且推荐的做法,但需要系统化的流程来确保质量。单纯转换格式(PDF to TXT)并不能解决根本问题。

以下是一套更完善的最佳实践(Best Practice):

目标是为知识库提供干净、结构化、富含元数据的文本。

#Title: [论文的完整标题]

#Authors: [作者1, 作者2, 作者3]

#Publication Year: [年份]

#Journal/Conference: [期刊或会议名称]

#DOI: [DOI号]

#Abstract: [论文摘要全文]

---正文开始---

[论文的正文内容,尽量清理掉页眉、页脚、页码、参考文献列表等无关信息]

```

* **为什么这样做?**

* **强化元数据**:将标题、作者等关键信息以显式标签(如`#Title:`)标出,让嵌入模型能更好地学习和索引这些信息。

* **提高检索准确度**:当您查询“某某作者在某某年提出的理论”时,系统能精准地检索到包含`#Authors: ...`和`#Publication Year: ...`的文本块,极大降低混淆的可能。

* **便于AI引用**:AI在生成回答时,更容易从文本块中提取出格式统一的参考文献信息。

#### 第2步:优化知识库配置

1. **分块(Chunking)策略**:

* 调整分块大小(Chunk Size)和重叠区(Overlap)。对于学术文献,可以尝试较小的块大小(如512-1024 tokens)配合较大的重叠区(如200 tokens)。这有助于保持上下文完整性,并让元数据信息有更高概率出现在每个块中。

* **理想情况**:如果您的知识库工具支持,可以尝试将**元数据**(标题、作者等)和**正文**分别用不同的策略处理,或者在检索时赋予元数据更高的权重。

2. **Metadata(元数据)过滤**:

* 检查您的知识库系统(Chatbox背后连接的可能是SiliconFlow或其他平台)是否支持为每个文档块添加自定义元数据(Metadata)。

* 在导入时,主动为每个文本块添加诸如 `title: "xxx"`, `author: "xxx"`, `year: 2020`, `doi: "xxx"` 等字段。

* 这样,您可以在提问时或系统检索后,要求AI**必须引用来自具有特定元数据的文档**,或者可以在后台通过元数据进行过滤,进一步提升准确性。

#### 第3步:优化提问(Query)策略

您在向AI提问时,指令至关重要。

* **不佳的提问**:“请写一段关于熔融盐电池的综述,并引用知识库中的文献。”

* **更佳的提问**:

> “请根据知识库中的文献,写一段关于熔融盐电池正极材料发展的综述。**请确保:**

> 1. 每一句引用的观点都必须严格对应知识库中的内容。

> 2. **对于每一处引用,都必须提供准确的文献标题、第一作者和发表年份。**

> 3. 如果无法找到完全匹配的文献,请说明‘根据现有知识库,未找到直接相关的文献’,而不要编造文献。”

这种指令能最大限度地抑制模型“幻觉”,迫使它更依赖检索到的内容。

### 总结与可行方案

您的思路正确,但需要更精细化的操作。

1. **短期可行方案**:

* 手动整理核心文献,将其**标题、作者、年份、摘要**复制到一个TXT文件中,每篇文献的元数据都用明显的标记(如`##`)括起来,然后再导入知识库。这虽然耗时,但会立即见效。

2. **中长期推荐方案**:

* **使用Grobid等专业工具**批量处理您的PDF库,生成结构化的文本。

* **编写脚本**将Grobid的输出整理成上述推荐的**结构化TXT格式**。

* 在导入知识库时,**充分利用元数据(Metadata)功能**,为每个文档块添加准确的属性。

* **优化您的提问技巧**,明确要求AI准确引用。

通过**高质量的数据预处理** + **优化的知识库配置** + **精准的提问指令**三者结合,可以极大地缓解您当前遇到的问题,使AI真正成为一个可靠的科研助手。