问题遇到的现象和发生背景

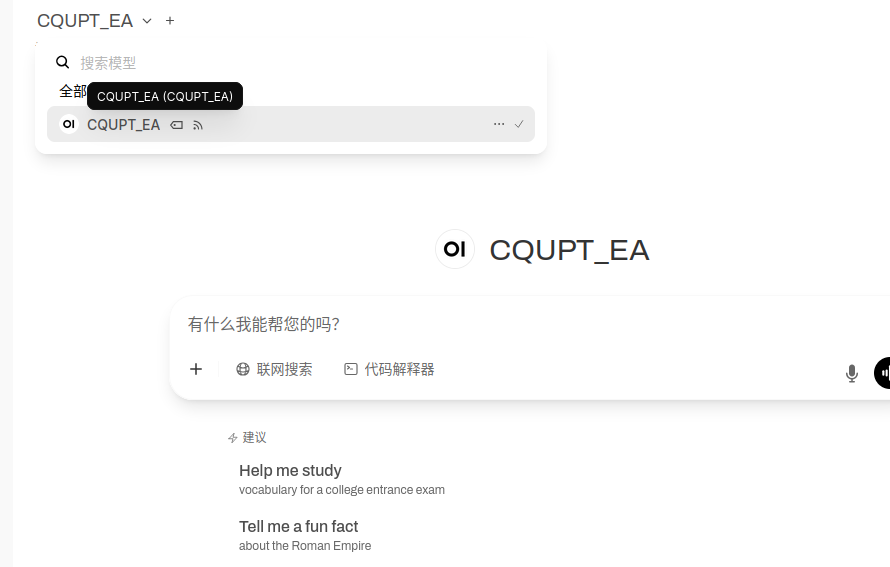

采用docker方式,以VLLM架构本地部署Qwen3-32B-FP8模型,并以open-webui作为前端,访问本地VLLM大模型服务,在宿主机可以登陆open-webui并和大模型对话,但是在局域网的其他机器上,输入宿主机IP:3212之后,可以登陆open-webui并注册,但是在模型目录却无法看见本地部署的Qwen3-32B-FP8模型(open-webui里面的名字是CQUPT_EA)

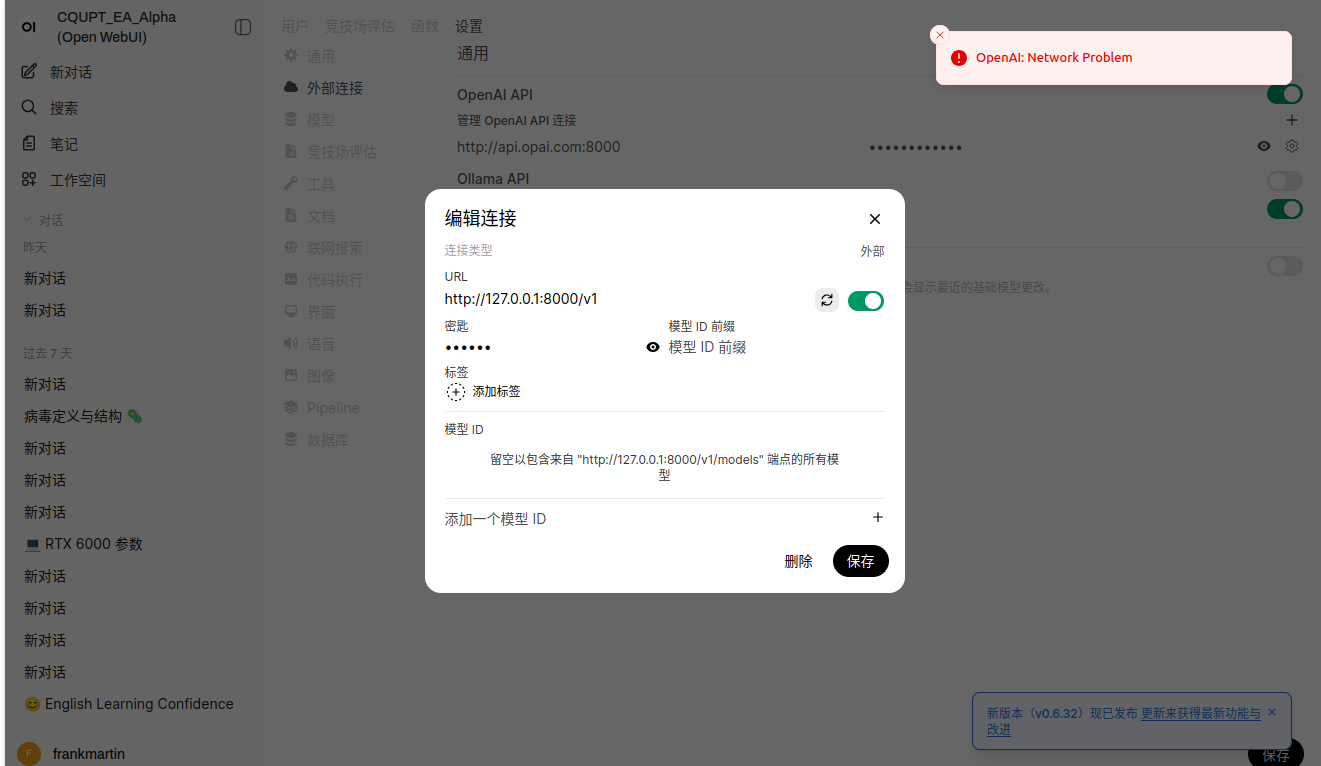

另一个奇怪的事情是,我在宿主机的open-webui里面,如果在管理员面板设置openai api的话,反而本地宿主机也看不到模型

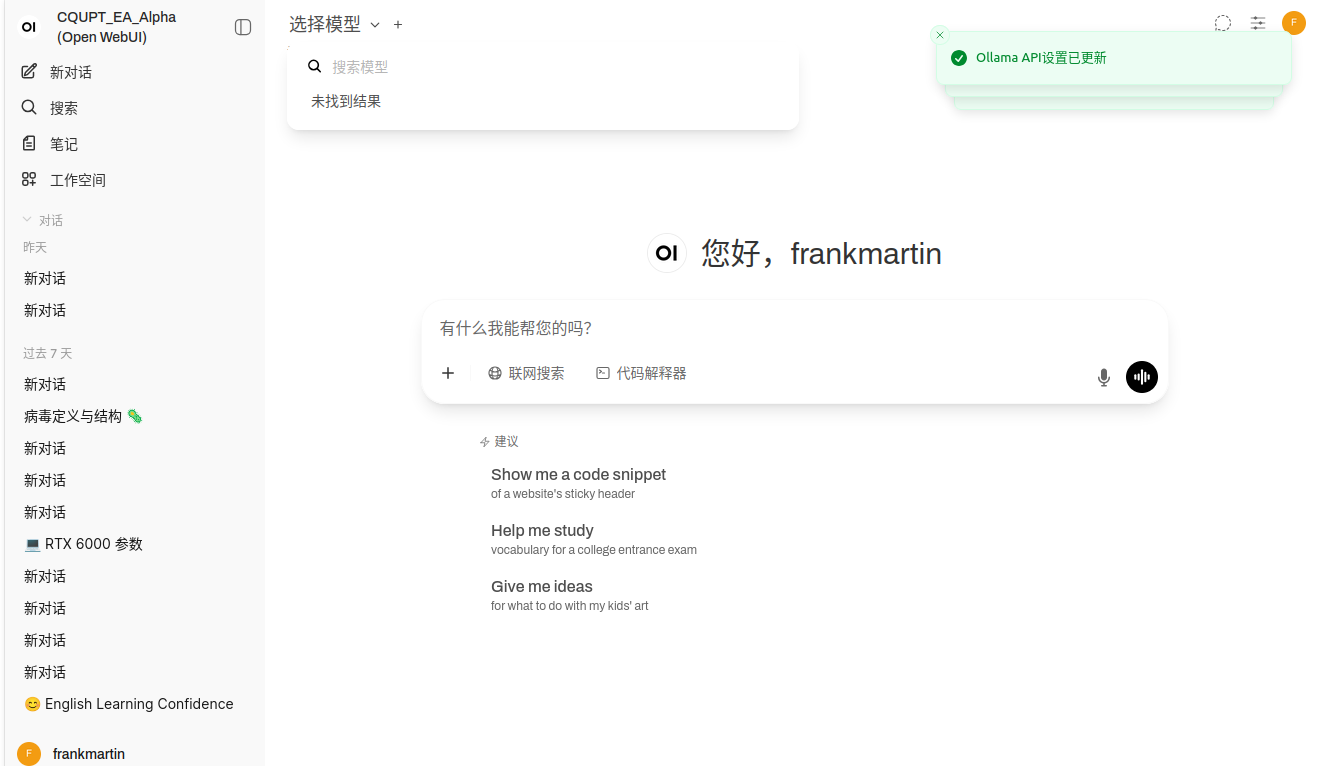

但如果我不进入管理员面板,在open-webui左下角直接进入设置

将API url设置好之后,反而就能看见模型列表了

我的问题究竟出在哪里呢?

- 局域网其他机器通过宿主机IP:3212可以访问open-webui前端,但是看不到模型列表?

- 宿主机按照晚上的教程,管理员面板设置后,始终无法看到模型列表,反而不进入管理员面板,在左下角设置里直接设置API URL,反而宿主机就能看到模型列表了?

docker compose 代码如下:

services:

vllm-backend:

image: vllm/vllm-openai:latest

container_name: vllm-backend

runtime: nvidia

deploy:

resources:

reservations:

devices:

- driver: nvidia

count: all

capabilities: [gpu]

volumes:

- /home/frankmartin/Models/models/Qwen3-32B-FP8:/model

command:

--model /model

--served-model-name CQUPT_EA

--tensor-parallel-size 1

--gpu-memory-utilization 0.95

--max-model-len 32768

--block-size 16

--cpu-offload-gb 0

--enable-chunked-prefill

--api-key UZI666

--host 0.0.0.0

--port 8000

ports:

- "8000:8000"

networks:

- openwebui-net

open-webui:

image: swr.cn-north-4.myhuaweicloud.com/ddn-k8s/ghcr.io/open-webui/open-webui:v0.6.25

container_name: open-webui-app

ports:

- "3212:8080"

volumes:

- open-webui-data:/app/backend/data

environment:

- OLLAMA_BASE_URL=http://vllm-backend:8000

- OPENAI_API_BASE_URL=http://10.16.32.60:8000/v1

- OPENAI_API_KEY=UZI666

- VLLM_API_KEY=UZI666

- WEBUI_NAME=CQUPT_EA_Alpha

- WEBUI_URL=http://localhost:3212

- DISABLE_SIGNUP=false

- VLLM_API_KEY=UZI666

- SEARCH_ENGINE_ENABLED=true

- SEARCH_ENGINE_URL=http://searxng:8080/search

- SEARCH_ENGINE_NAME=searxng

- SEARCH_ENGINE_TIMEOUT=15

- REDIS_URL=redis://redis:6379/0

- WEBUI_SECRET_KEY=your_secure_random_key_here

restart: unless-stopped

depends_on:

- vllm-backend

- searxng

- redis

networks:

- openwebui-net

searxng:

image: searxng/searxng

container_name: searxng

ports:

- "8080:8080"

volumes:

- searxng-config:/etc/searxng

environment:

- SEARXNG_SETTINGS__server__public_instance=True

- SEARXNG_SETTINGS__brand__instance_name=CQUPT_EA_Search

networks:

- openwebui-net

restart: unless-stopped

redis:

image: redis:alpine

container_name: redis

ports:

- "6379:6379"

volumes:

- redis-data:/data

command: redis-server --appendonly yes

networks:

- openwebui-net

restart: unless-stopped

networks:

openwebui-net:

driver: bridge

volumes:

open-webui-data:

driver: local

searxng-config:

driver: local

redis-data:

driver: local

操作环境、软件版本等信息

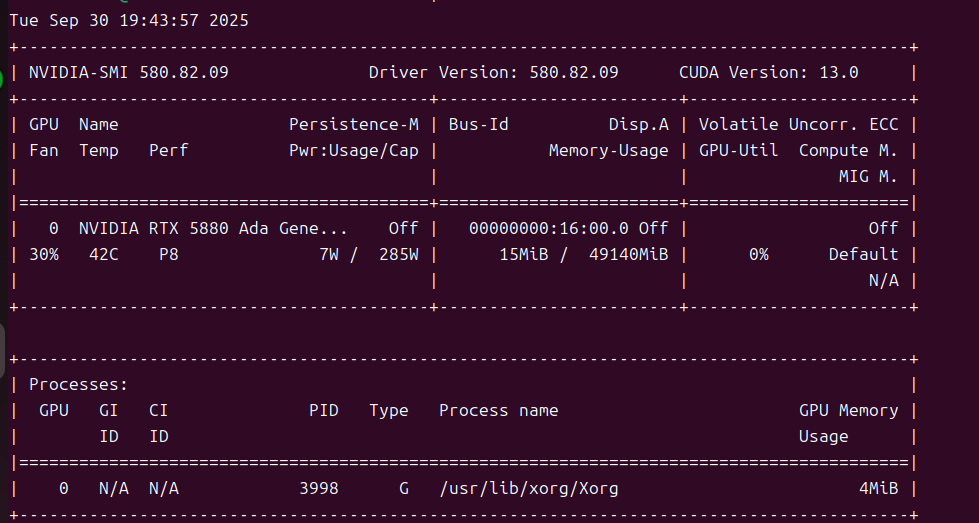

系统Ubuntu24.04 Lts,计算机配置1024GB DDR5 4800内存,显卡Rtx 5880 Ada 显存48G,显卡驱动为最新582.82.09, cuda版本13.0

vllm版本为0.9.2

尝试过的解决方法

通过询问AI和查阅资料,我首先在open-webui的工作空间里面,将我部署的模型设置为公开(全部可见)

但局域网客户机仍然看不到模型列表

后来询问AI,说可能是我的命令里面没有把宿主机IP添加进去,也就是OPENAI_API_BASE 这个部分,我又添加进去了,宿主机局域网IP为10.16.32.60,代码如下

environment:

- OLLAMA_BASE_URL=http://vllm-backend:8000

- OPENAI_API_BASE_URL=http://10.16.32.60:8000/v1

- OPENAI_API_KEY=UZI666

- VLLM_API_KEY=UZI666

但局域网客户机仍然看不到模型列表

我想要达到的结果

局域网客户机通过宿主机IP:3212能够访问并使用我在宿主机上部署的大模型