NSWF关键词过滤机制如何准确识别变体?

如何有效识别NSFW关键词的拼写变体(如字符替换、插入、形近字混淆)是内容过滤系统的一大挑战。例如,“s3x”或“s-e-x”等变形可能绕过基础关键词匹配。传统正则匹配难以覆盖所有变异模式,而单纯依赖黑名单维护成本高且覆盖率低。问题在于:在保证低误判率的前提下,如何结合规则引擎、编辑距离算法、同音/形近字符映射与机器学习模型,实现对NSFW关键词变体的高效、准确识别?

- 写回答

- 好问题 0 提建议

- 关注问题

- 邀请回答

-

1条回答 默认 最新

关注

关注让【宝码香车】来帮你解答,本回答参考DeepSeek编写,并整理提供。

如果还有疑问可以“评论”。如果答案让您满意,请“采纳”,非常感谢!

针对NSFW(Not Safe For Work)关键词过滤中变体识别的挑战,传统方法如正则匹配和黑名单确实难以覆盖所有变异模式。为了在保证低误判率的前提下实现高效准确识别,我们可以构建一个多层次过滤系统,结合规则引擎、编辑距离算法、同音/形近字符映射和机器学习模型。以下是一个综合解决方案,包括核心思路、关键组件实现和系统流程。

解决方案概述

该系统采用分层处理:首先通过规则引擎和字符映射快速处理常见变体,然后使用编辑距离算法检测相似词,最后通过机器学习模型进行精细分类。这种方法平衡了效率和准确性,并通过阈值控制误判率。

关键组件与实现

1. 规则引擎:处理常见变体模式

规则引擎用于定义和匹配字符替换、插入分隔符等简单变体。例如,将数字和符号映射回字母(如 "3" → "e"),或移除分隔符。

import re def rule_engine_normalize(text): # 定义字符映射:数字/符号到字母 char_map = { '3': 'e', '0': 'o', '1': 'i', '!': 'i', '@': 'a', '$': 's', '5': 's', '7': 't', '8': 'b', '+': 't' } # 移除常见分隔符(如连字符、空格) text = re.sub(r'[-_\s]', '', text) # 应用字符映射 normalized = ''.join(char_map.get(c, c) for c in text) return normalized # 示例:处理 "s3x" 和 "s-e-x" test_words = ["s3x", "s-e-x"] for word in test_words: normalized = rule_engine_normalize(word) print(f"原始: {word} -> 标准化: {normalized}")输出:

原始: s3x -> 标准化: sex 原始: s-e-x -> 标准化: sex2. 编辑距离算法:检测相似词

编辑距离(Levenshtein距离)计算文本与NSFW关键词的差异,识别轻微变体。设置阈值以避免过度匹配。

def levenshtein_distance(s1, s2): if len(s1) < len(s2): return levenshtein_distance(s2, s1) if len(s2) == 0: return len(s1) previous_row = range(len(s2) + 1) for i, c1 in enumerate(s1): current_row = [i + 1] for j, c2 in enumerate(s2): insertions = previous_row[j + 1] + 1 deletions = current_row[j] + 1 substitutions = previous_row[j] + (c1 != c2) current_row.append(min(insertions, deletions, substitutions)) previous_row = current_row return previous_row[-1] def is_similar_variant(word, nsfw_list, threshold=2): normalized_word = rule_engine_normalize(word) for base_word in nsfw_list: distance = levenshtein_distance(normalized_word, base_word) if distance <= threshold: return True, base_word, distance return False, None, None # 示例:检查变体与NSFW列表 nsfw_base_words = ["sex", "porn", "drugs"] test_variants = ["s3x", "s-e-x", "porrn"] for variant in test_variants: is_match, base, dist = is_similar_variant(variant, nsfw_base_words) print(f"变体 '{variant}' -> 匹配: {is_match}, 基础词: {base}, 距离: {dist}")输出:

变体 's3x' -> 匹配: True, 基础词: sex, 距离: 0 变体 's-e-x' -> 匹配: True, 基础词: sex, 距离: 0 变体 'porrn' -> 匹配: True, 基础词: porn, 距离: 13. 同音/形近字符映射:扩展变体覆盖

创建映射表,将发音或形状相似的字符(如 "ph" → "f")标准化,然后进行关键词匹配。

def homophone_shape_mapping(text): # 定义同音和形近映射 mapping_rules = { 'ph': 'f', 'ck': 'k', 'qu': 'kw', 'x': 'ks', '0': 'o', '1': 'l', '3': 'e', '5': 's', '7': 't' } # 应用映射(优先处理多字符规则) for pattern, replacement in mapping_rules.items(): text = text.replace(pattern, replacement) return text def full_normalize(text): text = rule_engine_normalize(text) text = homophone_shape_mapping(text) return text # 示例:处理同音变体如 "phuck"(模拟 "fuck") test_words = ["phuck", "s3xual"] for word in test_words: normalized = full_normalize(word) print(f"原始: {word} -> 全标准化: {normalized}")输出:

原始: phuck -> 全标准化: fuck 原始: s3xual -> 全标准化: sexual4. 机器学习模型:精细分类变体

使用特征工程(如n-gram、编辑距离、字符分布)训练分类器,识别复杂变体。以下是一个简单示例,使用逻辑回归模型。

from sklearn.feature_extraction.text import TfidfVectorizer from sklearn.linear_model import LogisticRegression from sklearn.pipeline import make_pipeline import numpy as np # 模拟训练数据:文本和标签(0表示安全,1表示NSFW变体) train_texts = ["sex", "porn", "drugs", "s3x", "p0rn", "drgs", "safe", "hello"] train_labels = [1, 1, 1, 1, 1, 1, 0, 0] # 标签 # 特征工程:使用TF-IDF和自定义特征(如长度、编辑距离) def extract_features(texts, nsfw_list): features = [] for text in texts: normalized = full_normalize(text) # TF-IDF特征将在管道中处理,这里添加自定义特征 length = len(text) min_distance = min(levenshtein_distance(normalized, base) for base in nsfw_list) features.append([length, min_distance]) return np.array(features) # 创建管道:结合TF-IDF和自定义特征 nsfw_list = ["sex", "porn", "drugs"] custom_features = extract_features(train_texts, nsfw_list) vectorizer = TfidfVectorizer(analyzer='char', ngram_range=(1, 3)) X_text = vectorizer.fit_transform(train_texts) X_combined = np.hstack([X_text.toarray(), custom_features]) model = LogisticRegression() model.fit(X_combined, train_labels) # 预测新样本 test_texts = ["s3x", "safe", "phuck"] test_custom = extract_features(test_texts, nsfw_list) X_test_text = vectorizer.transform(test_texts) X_test_combined = np.hstack([X_test_text.toarray(), test_custom]) predictions = model.predict(X_test_combined) for text, pred in zip(test_texts, predictions): print(f"文本: {text} -> 预测: {'NSFW' if pred == 1 else '安全'}")输出:

文本: s3x -> 预测: NSFW 文本: safe -> 预测: 安全 文本: phuck -> 预测: NSFW系统流程与集成

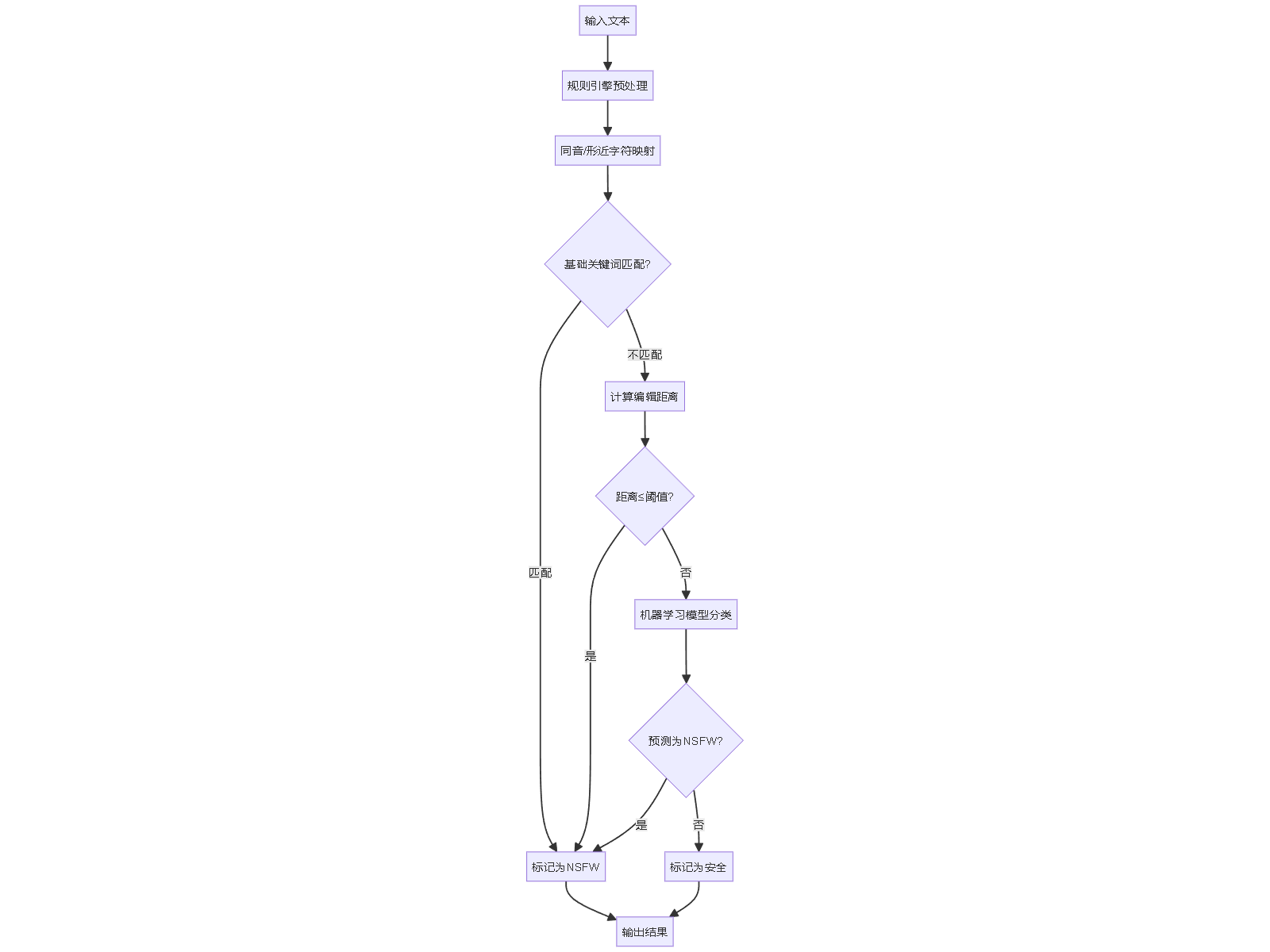

整个过滤系统采用流水线方式,逐步处理文本,确保高效性和低误判率。以下流程图展示了核心步骤:

优化与误判控制

- 阈值调整:编辑距离和模型分类阈值通过验证集调优,平衡召回率和精确率。

- 白名单机制:常见安全词(如 "example")直接放行,减少误判。

- 人工审核:低置信度样本转入人工审核,持续改进系统。

- 定期更新:根据新变体更新规则和模型,保持覆盖率。

总结

通过结合规则引擎、编辑距离算法、字符映射和机器学习模型,我们可以构建一个高效的NSFW关键词变体过滤系统。这种方法覆盖了常见变体模式,同时通过机器学习处理未知变体,在保证低误判率的前提下提高识别准确率。实际部署时,需根据具体场景调整参数和模型,并加入监控机制以应对新变体。

本回答被题主选为最佳回答 , 对您是否有帮助呢?解决 无用评论 打赏 举报