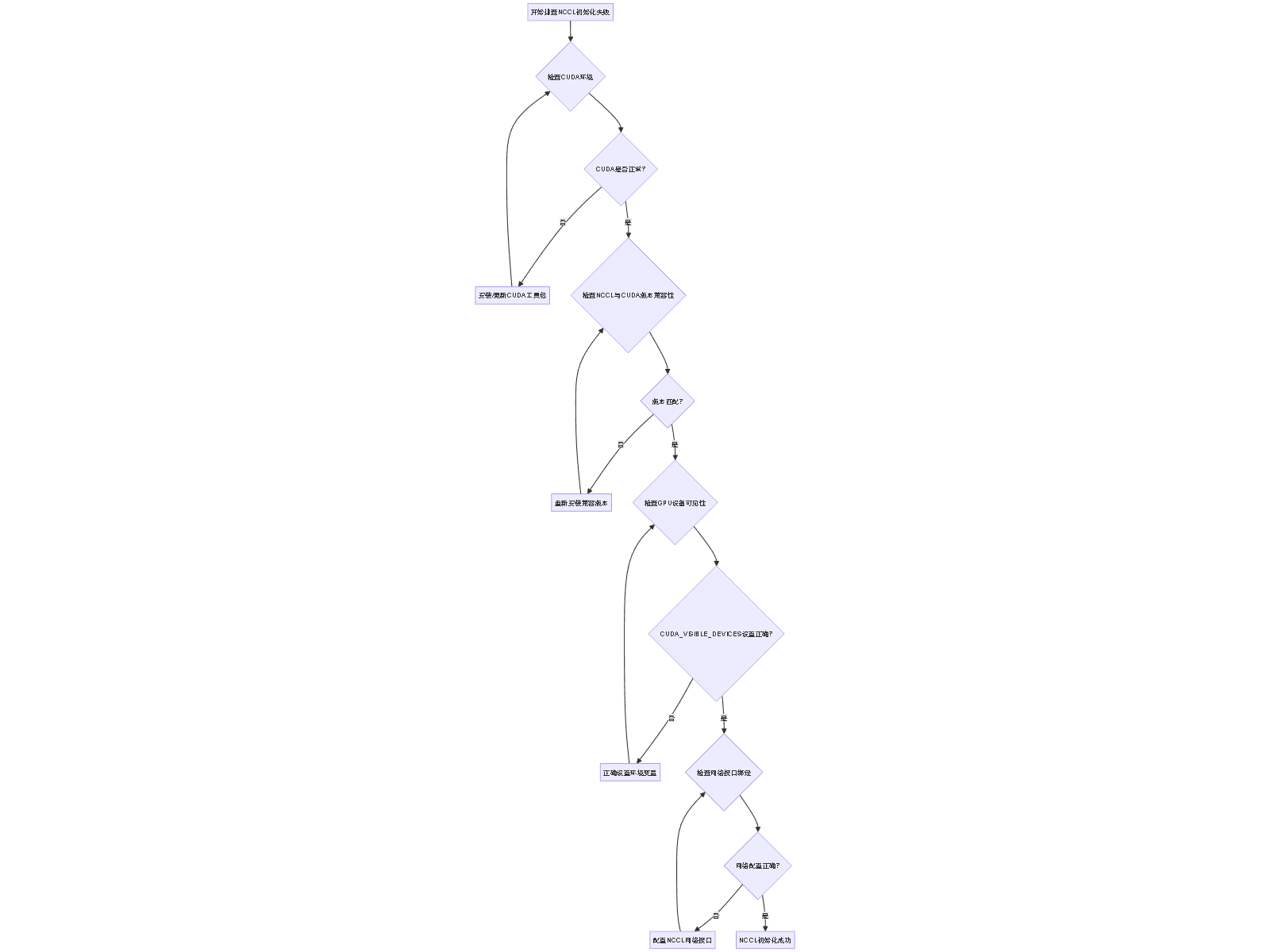

在使用NCCL进行多GPU通信时,常遇到“NCCL backend initialization failed”错误。该问题通常出现在基于CUDA的分布式训练中,尤其是在PyTorch或TensorFlow等框架下。其根本原因可能是CUDA环境未正确配置、GPU驱动版本不兼容,或NCCL无法识别可用的CUDA设备。此外,当CUDA_VISIBLE_DEVICES设置不当,或跨节点通信时网络接口绑定错误,也会导致NCCL初始化失败。由于NCCL依赖于CUDA实现高效的GPU间通信(如AllReduce、Broadcast等),因此任何CUDA运行时异常都会直接影响NCCL功能。如何确保NCCL与CUDA版本匹配,并正确初始化上下文,是解决此类问题的关键。

2条回答 默认 最新

关注

关注让【宝码香车】来帮你解答,本回答参考DeepSeek编写,并整理提供。

如果还有疑问可以“评论”。如果答案让您满意,请“采纳”,非常感谢!

CUDA与NCCL的关系及NCCL初始化失败解决方案

CUDA与NCCL的关系

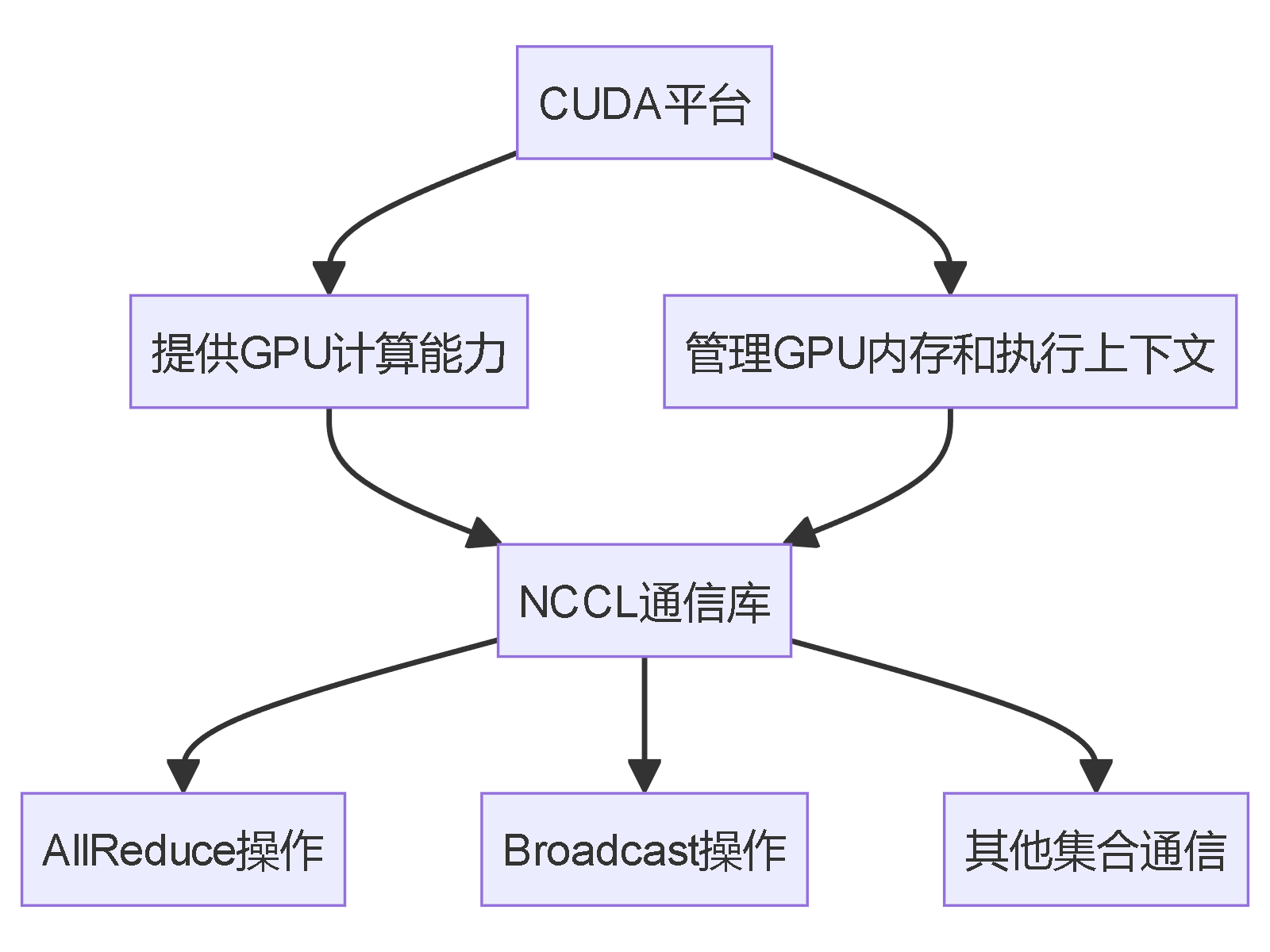

CUDA(Compute Unified Device Architecture)是NVIDIA推出的并行计算平台和编程模型,而NCCL(NVIDIA Collective Communications Library)是建立在CUDA之上的多GPU通信库。

核心关系:

- 依赖关系:NCCL完全依赖于CUDA,使用CUDA提供的API进行GPU内存管理和核函数执行

- 功能互补:CUDA负责单GPU计算,NCCL负责多GPU间通信

- 性能优化:NCCL利用CUDA的流、事件等机制实现通信与计算的流水线并行

NCCL初始化失败排查流程

详细解决方案

1. 验证CUDA环境

# 检查CUDA安装 nvidia-smi nvcc --version # 验证CUDA运行时 python -c "import torch; print(torch.cuda.is_available())"2. 检查版本兼容性

import torch import subprocess def check_versions(): print(f"PyTorch版本: {torch.__version__}") print(f"CUDA版本: {torch.version.cuda}") # 检查NCCL try: result = subprocess.run(['nccl-config', '--version'], capture_output=True, text=True) print(f"NCCL信息: {result.stdout}") except: print("NCCL配置工具未找到") check_versions()3. 环境变量配置

# 设置正确的GPU设备 export CUDA_VISIBLE_DEVICES=0,1,2,3 # NCCL调试信息 export NCCL_DEBUG=INFO export NCCL_DEBUG_SUBSYS=INIT,ENV # 网络接口绑定(多节点环境) export NCCL_SOCKET_IFNAME=eth0 # 根据实际网络接口调整 export NCCL_IB_DISABLE=1 # 如果InfiniBand不可用4. 完整的NCCL初始化检查脚本

import os import torch import torch.distributed as dist def check_nccl_environment(): """检查NCCL环境配置""" print("=== NCCL环境检查 ===") # 检查CUDA if not torch.cuda.is_available(): print("❌ CUDA不可用") return False print(f"✅ CUDA可用,设备数量: {torch.cuda.device_count()}") # 检查环境变量 cuda_visible = os.getenv('CUDA_VISIBLE_DEVICES', '未设置') print(f"CUDA_VISIBLE_DEVICES: {cuda_visible}") # 尝试初始化NCCL try: dist.init_process_group(backend='nccl', init_method='env://') print("✅ NCCL初始化成功") # 清理 dist.destroy_process_group() return True except Exception as e: print(f"❌ NCCL初始化失败: {e}") return False def test_multi_gpu_communication(): """测试多GPU通信""" if torch.cuda.device_count() < 2: print("⚠️ 需要至少2个GPU进行通信测试") return print("\n=== 多GPU通信测试 ===") try: # 初始化进程组 dist.init_process_group(backend='nccl') # 在每个GPU上创建张量并执行AllReduce local_rank = dist.get_rank() torch.cuda.set_device(local_rank) tensor = torch.ones(10).cuda() * (local_rank + 1) dist.all_reduce(tensor) print(f"Rank {local_rank}: AllReduce结果 {tensor[:5]}") dist.destroy_process_group() print("✅ 多GPU通信测试成功") except Exception as e: print(f"❌ 多GPU通信测试失败: {e}") if __name__ == "__main__": if check_nccl_environment(): test_multi_gpu_communication()5. Docker环境配置

如果使用Docker,确保正确的运行时和权限:

# Dockerfile示例 FROM nvidia/cuda:11.8-devel-ubuntu20.04 # 安装NCCL RUN apt-get update && apt-get install -y \ libnccl2=2.16.2-1+cuda11.8 \ libnccl-dev=2.16.2-1+cuda11.8 # 设置环境变量 ENV NCCL_VERSION=2.16.2 ENV CUDA_VISIBLE_DEVICES=0,1,2,36. 版本兼容性参考

# NCCL与CUDA版本兼容性参考 compatible_versions: "CUDA 11.x": - "NCCL 2.8.x - 2.18.x" "CUDA 12.x": - "NCCL 2.16.x - 2.20.x" recommended_combinations: - "CUDA 11.8 + NCCL 2.16.2" - "CUDA 12.1 + NCCL 2.18.5"常见错误及解决方案

- NCCL版本不匹配:重新安装与CUDA版本兼容的NCCL

- GPU权限问题:确保用户有GPU访问权限

- 网络配置错误:在多节点环境中正确设置NCCL_SOCKET_IFNAME

- 内存不足:减少每个进程的GPU内存使用

通过系统性地按照上述流程排查,大多数NCCL初始化问题都能得到解决。

本回答被题主选为最佳回答 , 对您是否有帮助呢?解决 无用评论 打赏 举报