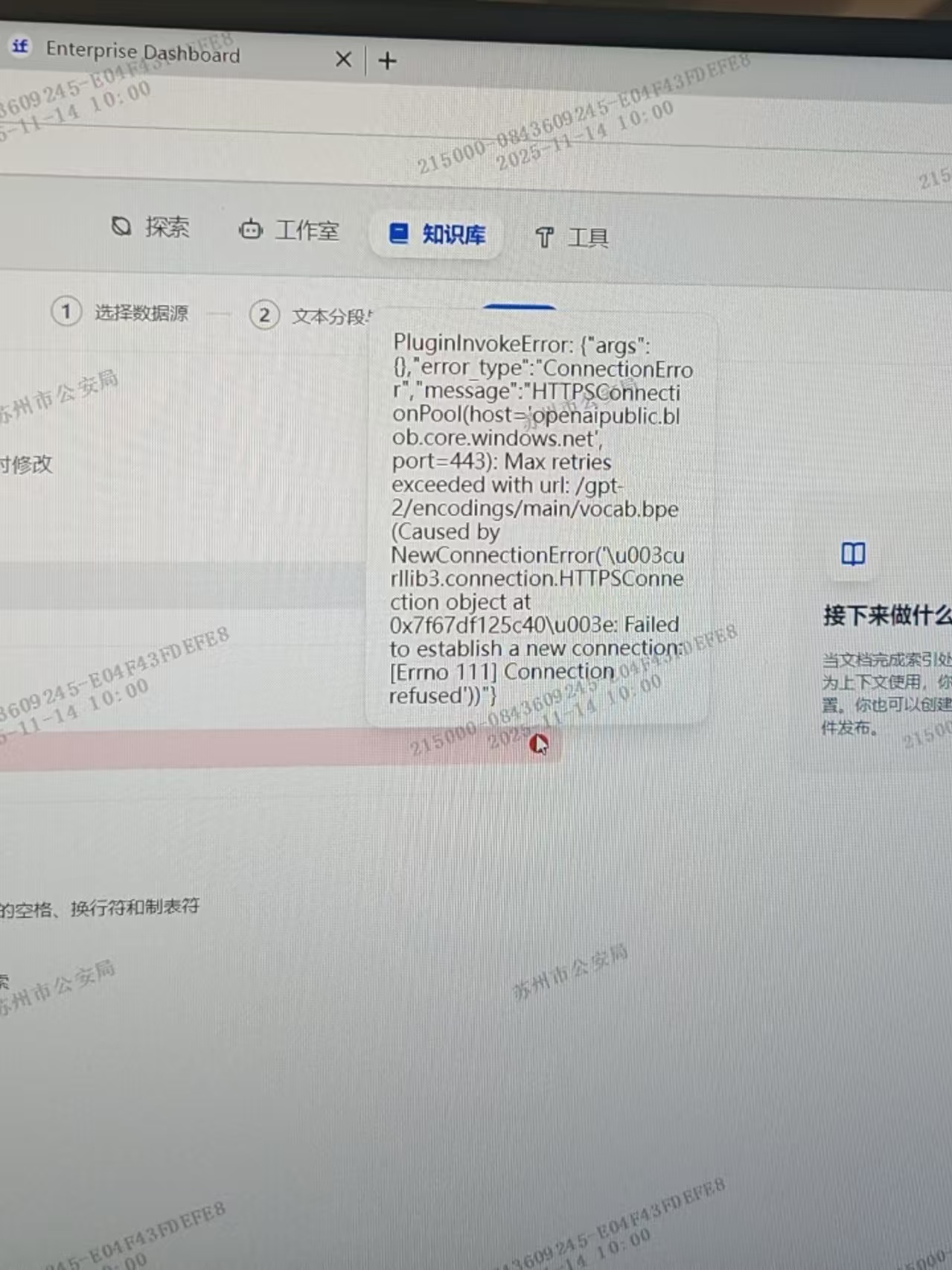

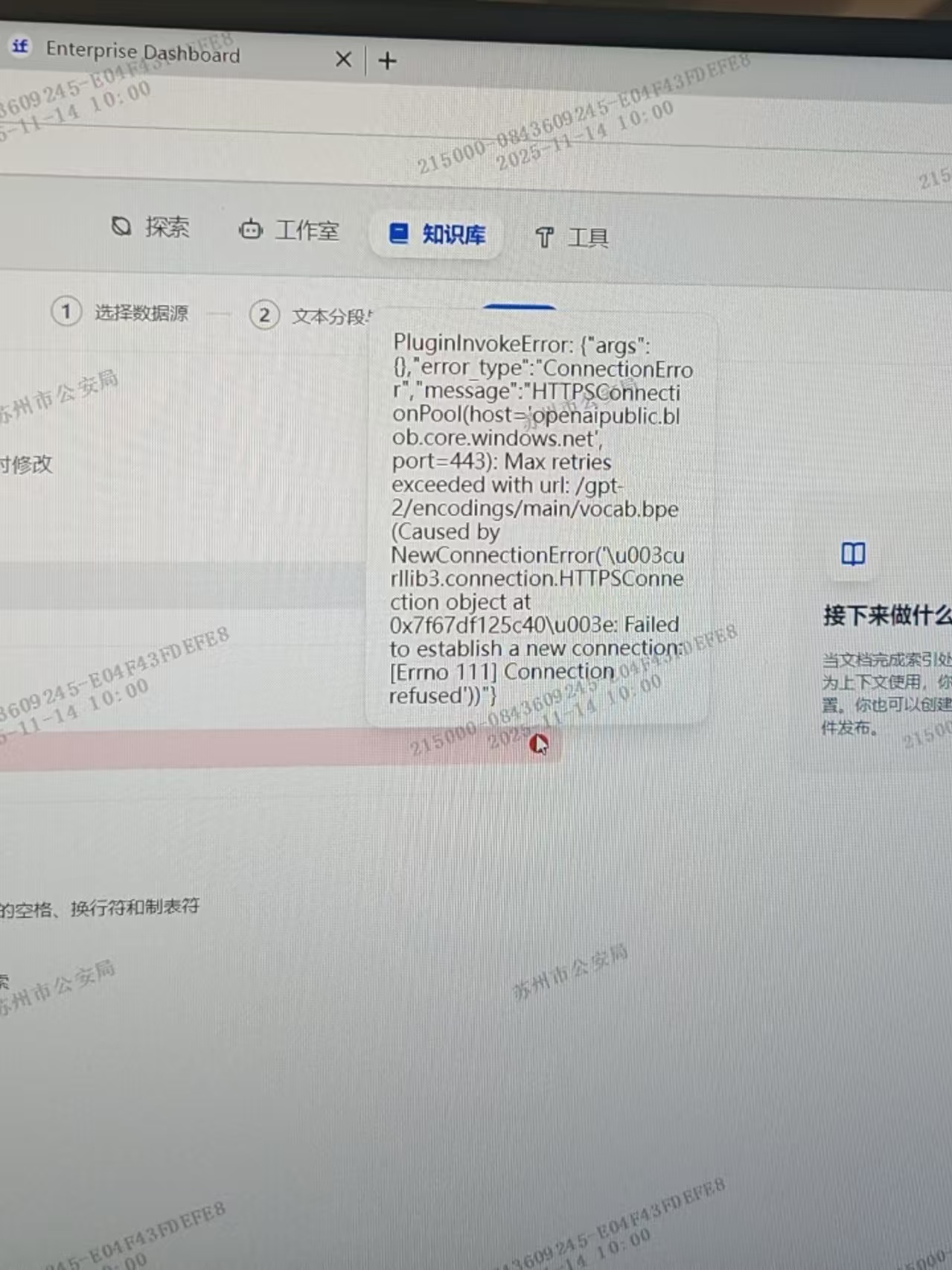

您好,咨询个问题,离线部署的dify,使用OpenAI-API-compatible插件,配置了一个本地的embdding模型,但是我在知识库中使用的时候,使用这个模型会报错

我查了下,是知识库使用这类模型的时候会去线上下载对应的文件,我把这些文件下载下来挂载在OpenAI-API-compatible这个插件的pod上,但还是回去线上下载,这有什么解决办法吗

您好,咨询个问题,离线部署的dify,使用OpenAI-API-compatible插件,配置了一个本地的embdding模型,但是我在知识库中使用的时候,使用这个模型会报错

晚上好🌙🌙🌙

本答案参考通义千问

你好!你遇到的问题是Dify 在离线环境中使用知识库时,仍然尝试从线上下载模型文件,即使你已经将这些文件挂载到插件的 Pod 上。这是一个典型的 离线环境配置问题,下面我将详细分析原因并提供解决方案。

Dify 的知识库模块在加载模型时,会主动去访问网络资源:

OpenAI API 兼容插件的模型路径配置可能未正确设置:

Pod 挂载路径不一致或权限问题:

检查插件配置中指定的模型路径:

OpenAI-API-compatible 插件的配置文件(如 config.yaml 或通过界面设置)。model_path: /path/to/local/model 的配置项。确保挂载路径与插件配置路径一致:

/mnt/models/,而插件配置的是 /models/,那么需要调整挂载路径或插件配置。重点提示: 确保挂载路径和插件配置路径完全一致,否则模型无法被识别。

# config.yaml 示例

embedding:

model: "local"

model_path: "/mnt/models/your_embedding_model"

重点提示: 如果插件不支持直接配置模型路径,可能需要修改源码或使用自定义插件。

例如,在代码中查找类似以下内容:

if not os.path.exists(model_path):

download_model_from_url()

将其替换为:

if not os.path.exists(model_path):

raise Exception("Model file not found at specified path.")

重点提示: 此操作需要具备一定的开发能力,建议在测试环境中验证后再部署。

示例 Kubernetes Deployment 配置片段:

volumeMounts:

- name: model-volume

mountPath: /mnt/models

volumes:

- name: model-volume

hostPath:

path: /host/models

重点提示: 确保

mountPath与插件配置中的model_path完全匹配。

示例 Dockerfile 片段:

FROM your-base-image

COPY models /mnt/models

ENV EMBEDDING_MODEL_PATH=/mnt/models/your_model

重点提示: 这种方式适合生产环境,但会增加镜像体积,需权衡利弊。

如果你使用的是 Python 插件,可以参考以下方式强制使用本地模型:

import os

def load_embedding_model():

model_path = "/mnt/models/your_embedding_model"

if not os.path.exists(model_path):

raise FileNotFoundError(f"Model file not found at {model_path}")

# 加载模型逻辑...

| 步骤 | 内容 | |------|------| | 1 | 确认插件配置的模型路径是否与挂载路径一致 | | 2 | 修改插件配置文件,显式指定本地模型路径 | | 3 | 如果有源码,禁用自动下载逻辑 | | 4 | 检查 Kubernetes Pod 挂载配置 | | 5 | 考虑将模型打包进 Docker 镜像 |

如果你能提供具体的插件配置文件或错误日志,我可以进一步帮你定位问题所在。希望以上方法对你有所帮助!