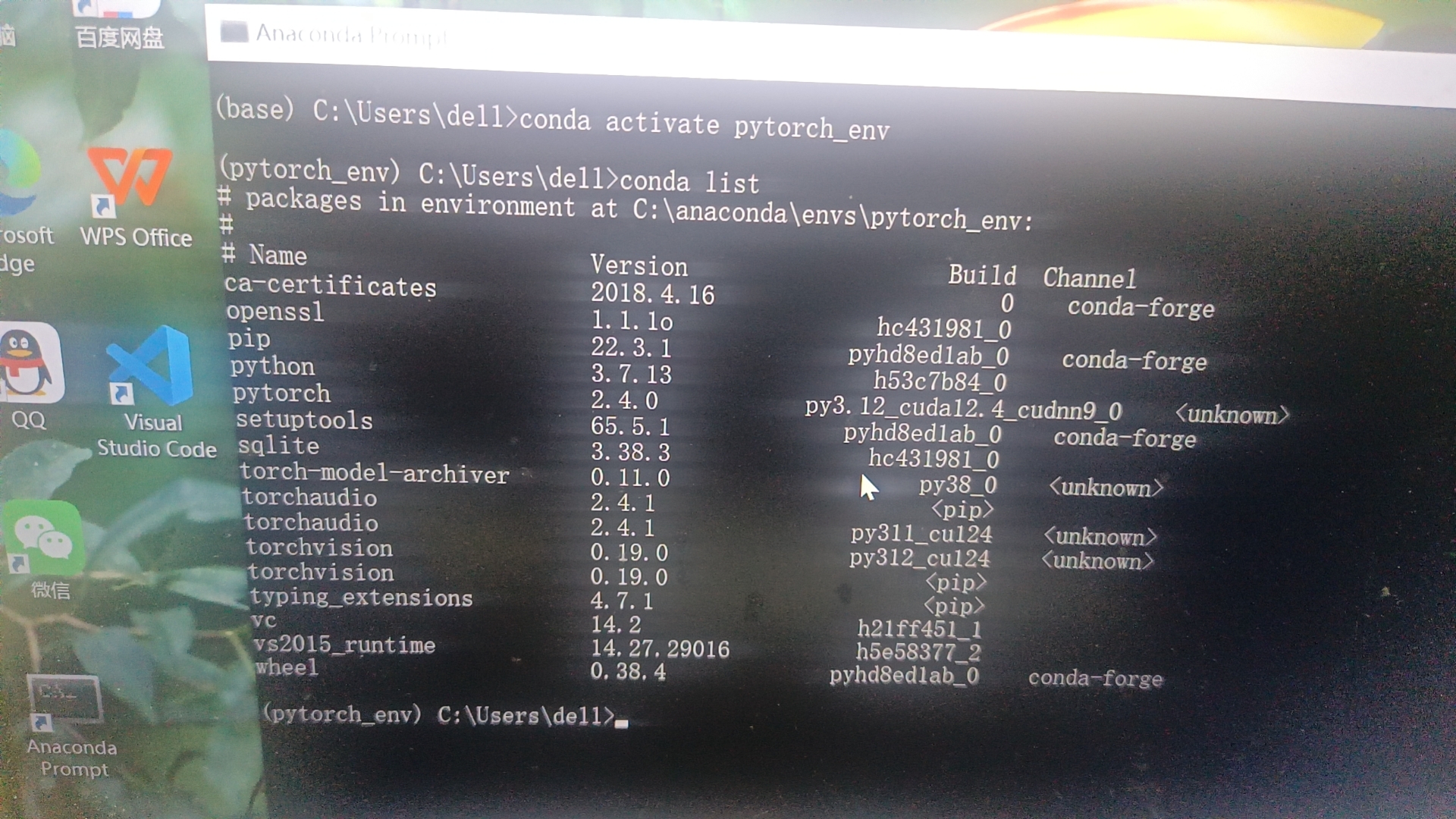

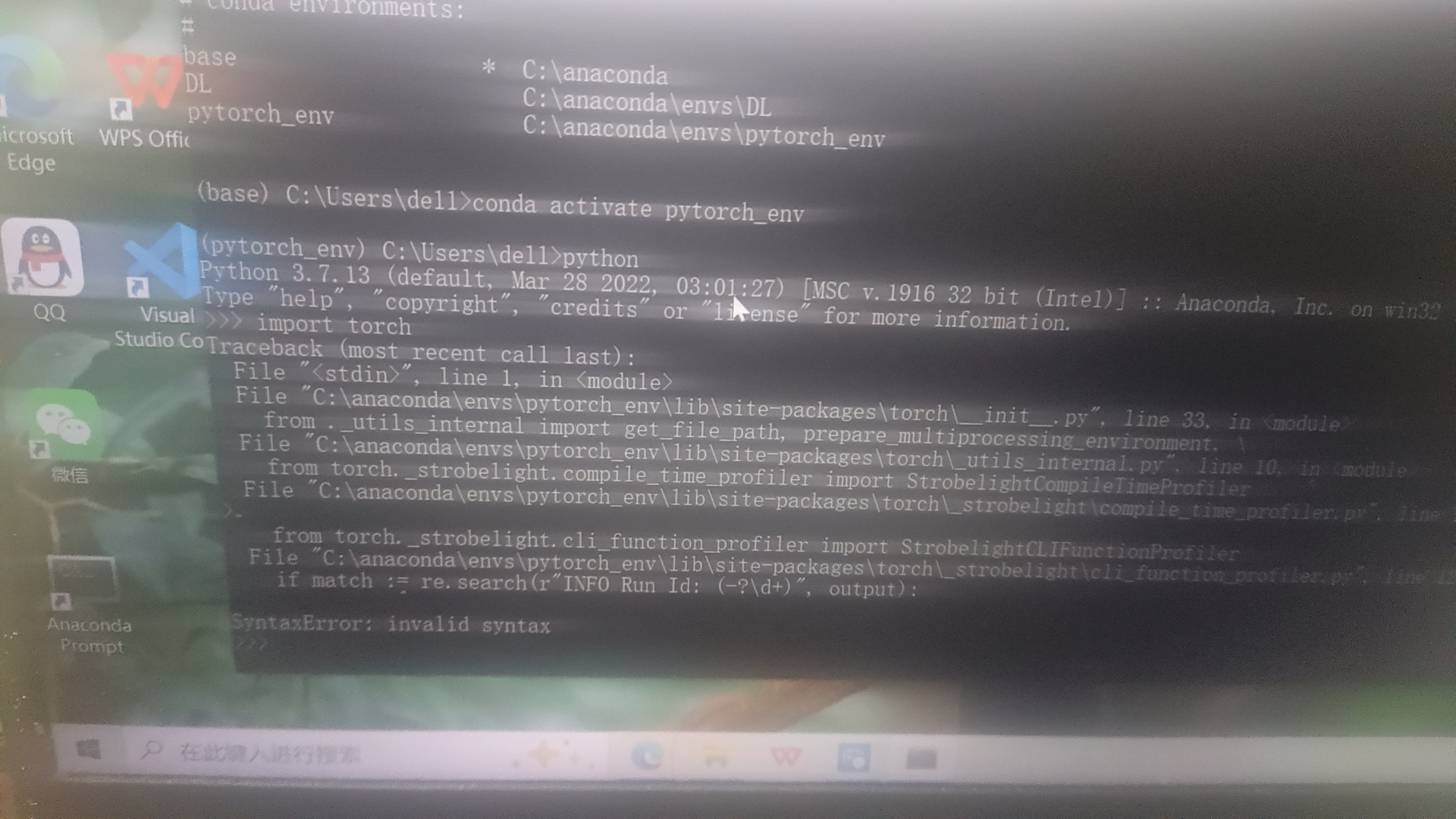

先是说No model name typing_extension,下载了之后就这样

晚上好🌙🌙🌙

本答案参考通义千问

你提到的“No model name typing_extension”错误通常与 PyTorch 或 Hugging Face Transformers 相关。这个错误一般出现在你尝试加载一个模型时,指定的模型名称不正确或不存在。下面我将详细分析可能的原因,并给出解决方案。

typing_extension)。确保你使用的模型名称是有效的,例如:

from transformers import AutoModelForSequenceClassification, AutoTokenizer

model_name = "bert-base-uncased" # 正确的模型名称示例

model = AutoModelForSequenceClassification.from_pretrained(model_name)

tokenizer = AutoTokenizer.from_pretrained(model_name)

注意:

typing_extension不是一个标准的 Hugging Face 模型名称。

你可以访问 Hugging Face Model Hub 查找可用的模型名称。例如:

"bert-base-uncased""roberta-base""distilbert-base-uncased"如果模型需要从网络下载,请确保你的网络可以访问 Hugging Face 的服务器。你可以尝试以下命令测试网络:

ping huggingface.co

如果无法连接,可能是网络限制导致的问题。

如果你在中国大陆,可能需要设置代理来加速下载:

import os

os.environ["HTTP_PROXY"] = "http://your-proxy:port"

os.environ["HTTPS_PROXY"] = "http://your-proxy:port"

确保你安装的是最新版本的 transformers 和 torch:

pip install --upgrade torch transformers

如果你是在自定义模型中使用 typing_extension,请确认它是否为一个自定义模块或类,而不是模型名称。例如:

# 错误示例(假设 typing_extension 是一个模块)

from typing_extension import SomeClass # 如果你没有安装该模块,会报错

# 正确做法(如果是模型名称)

from transformers import AutoModel

model = AutoModel.from_pretrained("bert-base-uncased")

| 问题 | 解决方案 |

|------|----------|

| 模型名称错误 | 使用有效模型名称,如 "bert-base-uncased" |

| 网络连接问题 | 检查网络或设置代理 |

| 依赖版本问题 | 升级 torch 和 transformers |

| 自定义模块错误 | 确认是否混淆了模型名称和模块名 |

from transformers import AutoModelForSequenceClassification, AutoTokenizer

# 使用正确的模型名称

model_name = "bert-base-uncased"

# 加载模型和分词器

model = AutoModelForSequenceClassification.from_pretrained(model_name)

tokenizer = AutoTokenizer.from_pretrained(model_name)

print("模型加载成功!")

如果你能提供具体的代码片段或完整的错误信息,我可以更准确地帮你定位问题。希望以上内容对你有帮助!