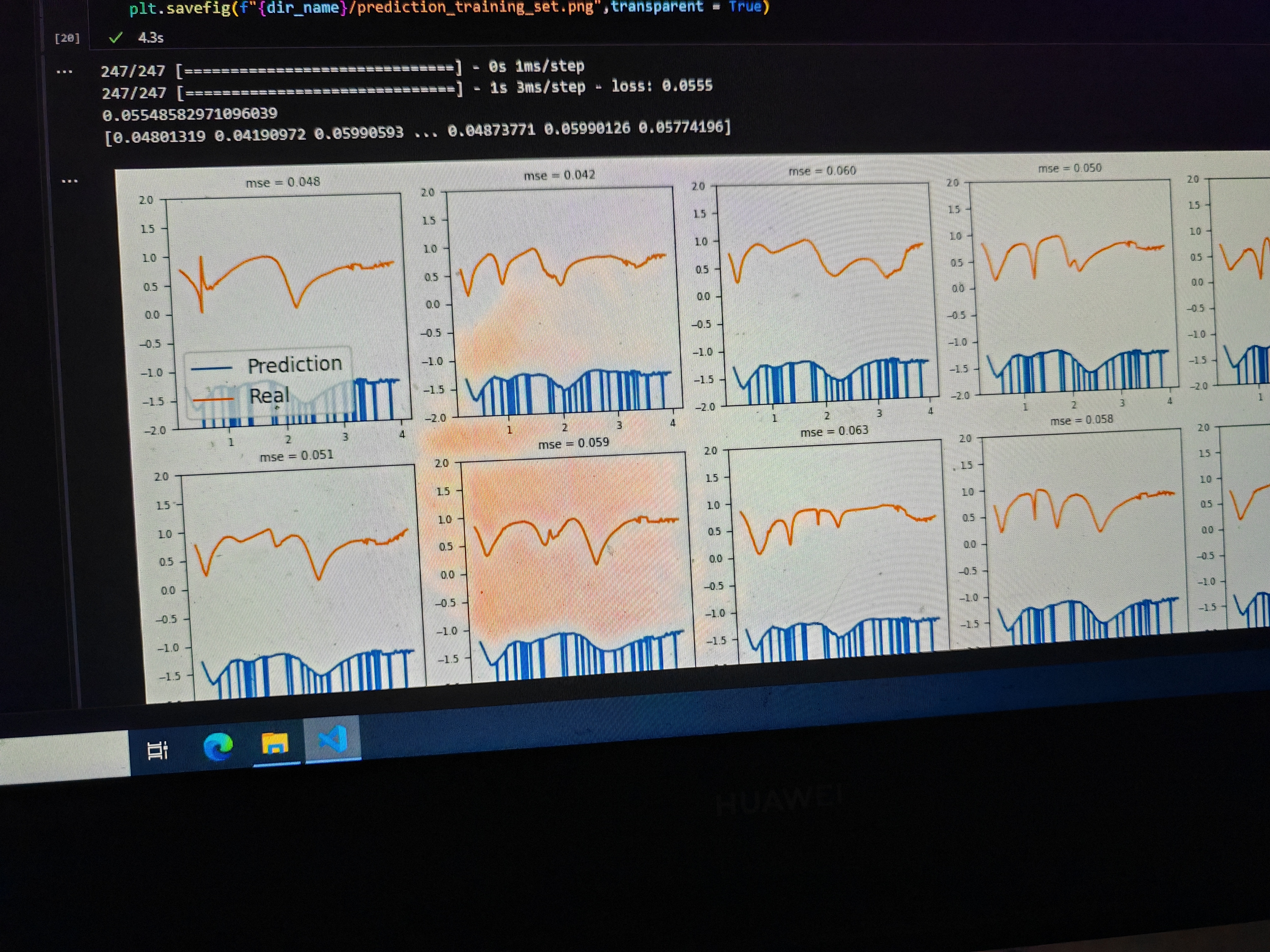

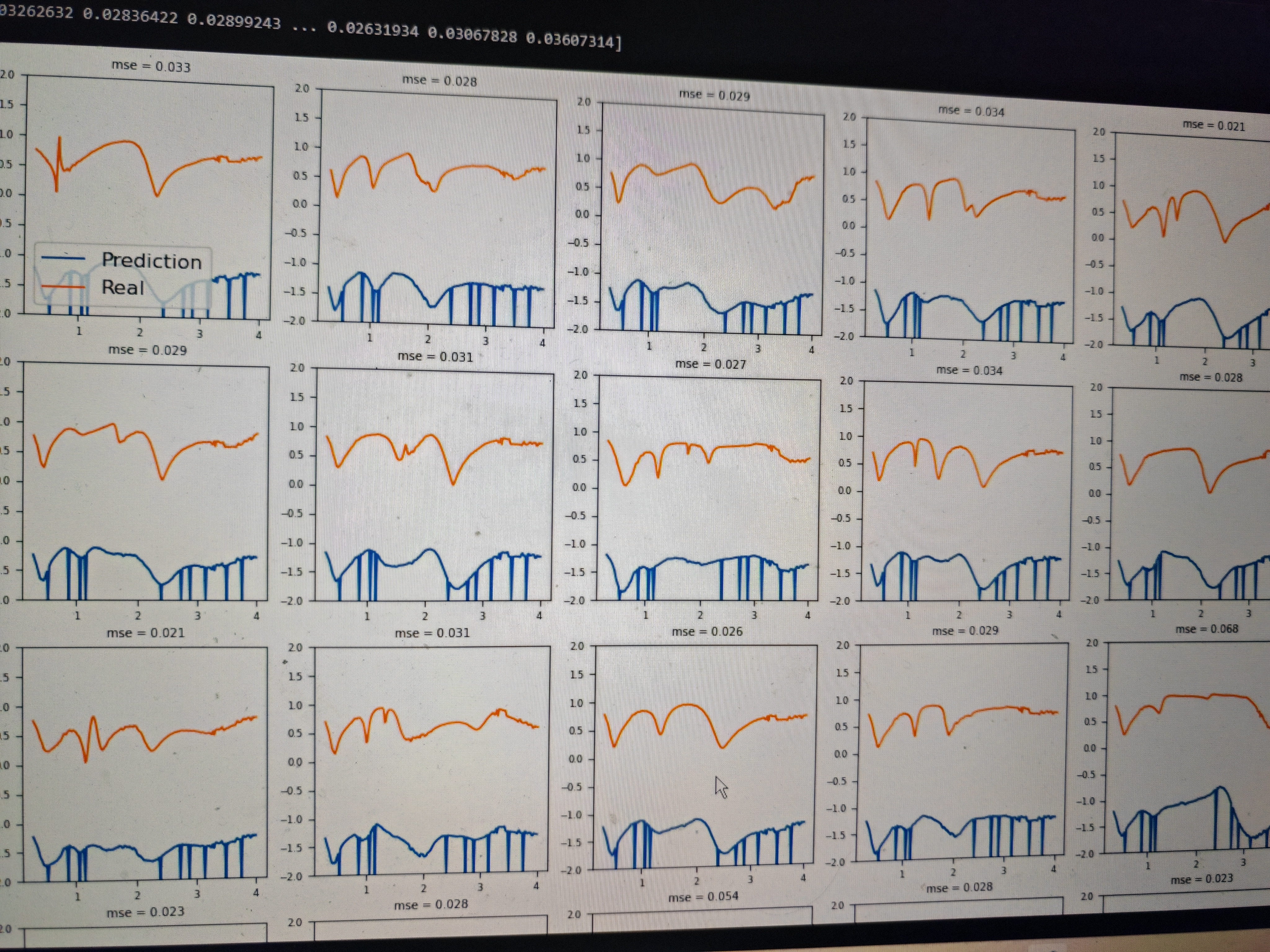

有人知道我的神经网络的预测图固定位置出现突刺是什么原因吗,我把每个样本里面的数据减少了突刺也减少了

关注

关注让 “紫雾凌寒” 来帮你回答,本回答结合 DeepSeek

如果还有问题,请评论或点击头像私信,如果有帮助到您, 请关注、采纳、点赞

scipy.signal库进行均值滤波,代码如下:from scipy.signal import medfilt

import numpy as np

# 假设data是你的数据数组

data = np.array([...])

filtered_data = medfilt(data, kernel_size = 3) # 这里kernel_size可以根据情况调整

- **异常值处理**:识别并去除数据中的异常值。可以通过计算数据的统计特征,如均值、标准差,设定一个合理的阈值范围来判断异常值。例如:

import numpy as np

data = np.array([...])

mean = np.mean(data)

std = np.std(data)

lower_bound = mean - 3 * std

upper_bound = mean + 3 * std

cleaned_data = data[(data >= lower_bound) & (data <= upper_bound)]

from keras import regularizers

from keras.models import Sequential

from keras.layers import Dense

model = Sequential()

model.add(Dense(units = 64, input_dim = input_dim, kernel_regularizer = regularizers.l2(0.01)))

model.add(Dense(units = 1))

- **调整模型结构**:尝试增加或减少网络层数、神经元数量等,看是否能改善预测的稳定性。例如增加一个隐藏层:

from keras.models import Sequential

from keras.layers import Dense

model = Sequential()

model.add(Dense(units = 64, input_dim = input_dim, activation='relu'))

model.add(Dense(units = 32, activation='relu'))

model.add(Dense(units = 1))

Adam优化器并调整学习率的示例:from keras.optimizers import Adam

model.compile(optimizer = Adam(lr = 0.001), loss='mse')

model.fit(X_train, y_train, epochs = 100, batch_size = 32)

- **早停机制**:使用早停机制,在验证集上的性能不再提升时提前停止训练,防止模型过拟合。在Keras中可以使用`EarlyStopping`回调函数:

from keras.callbacks import EarlyStopping

early_stopping = EarlyStopping(monitor='val_loss', patience = 5, restore_best_weights = True)

model.fit(X_train, y_train, epochs = 100, batch_size = 32, validation_data=(X_val, y_val), callbacks=[early_stopping])

希望以上解答对您有所帮助。如果您有任何疑问,欢迎在评论区提出。