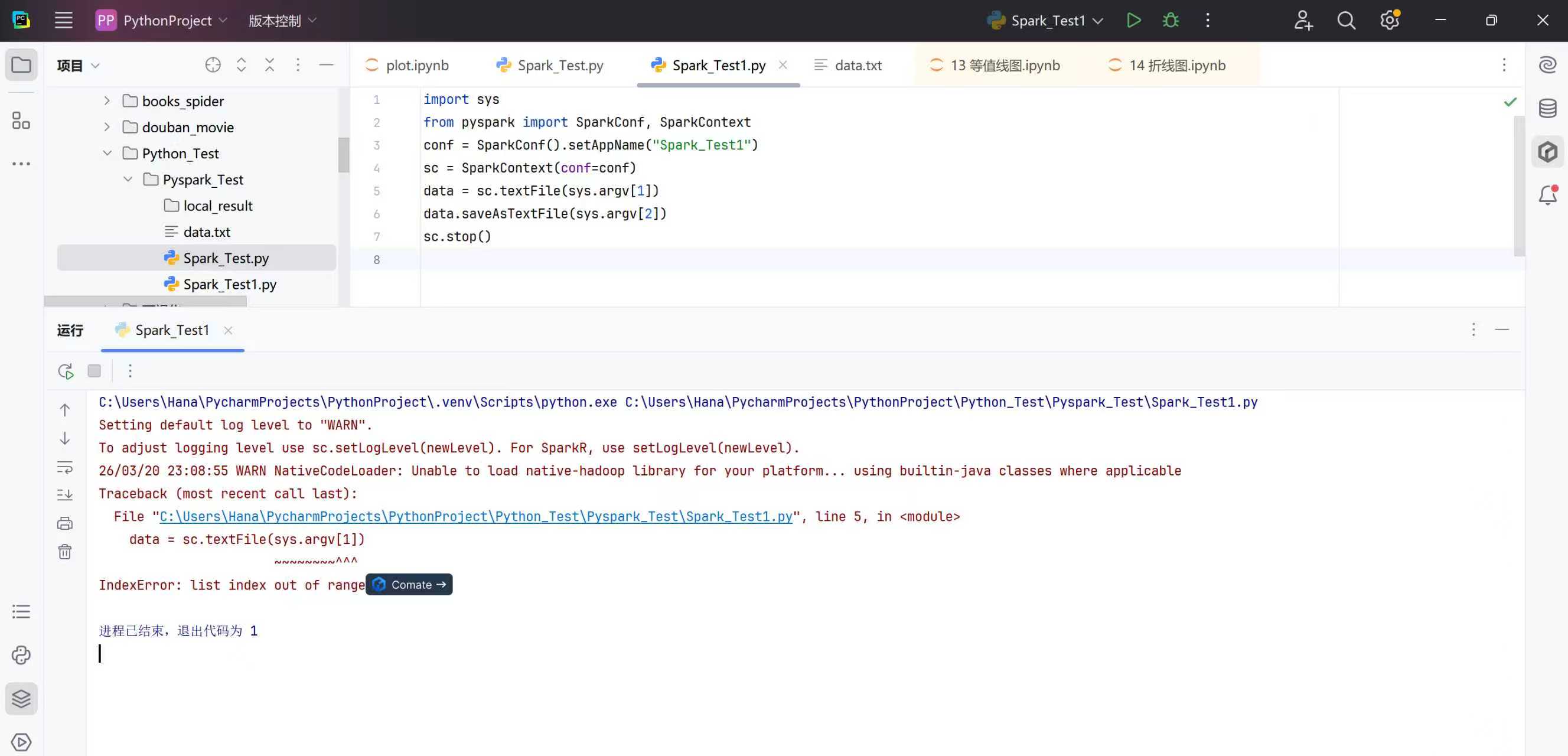

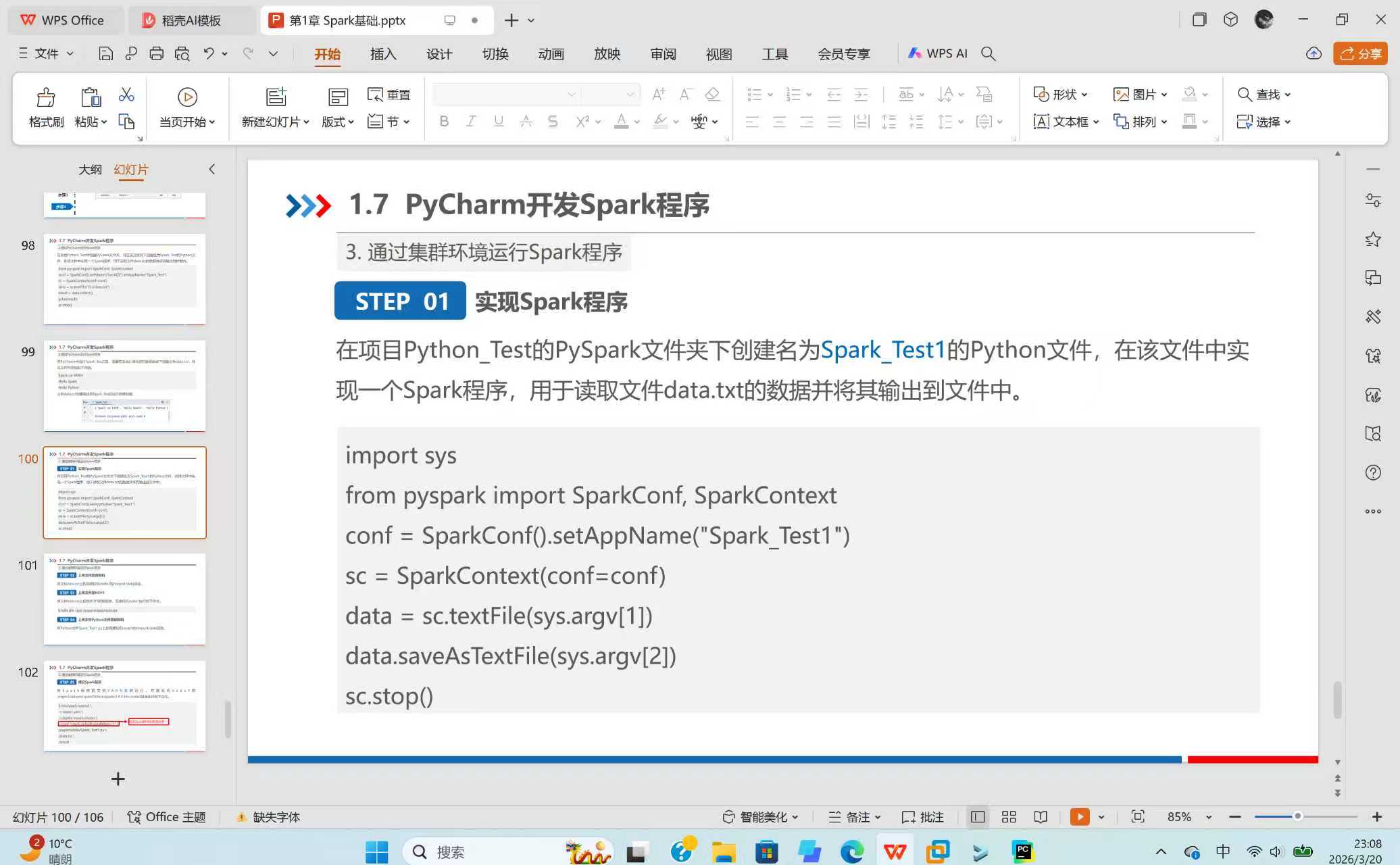

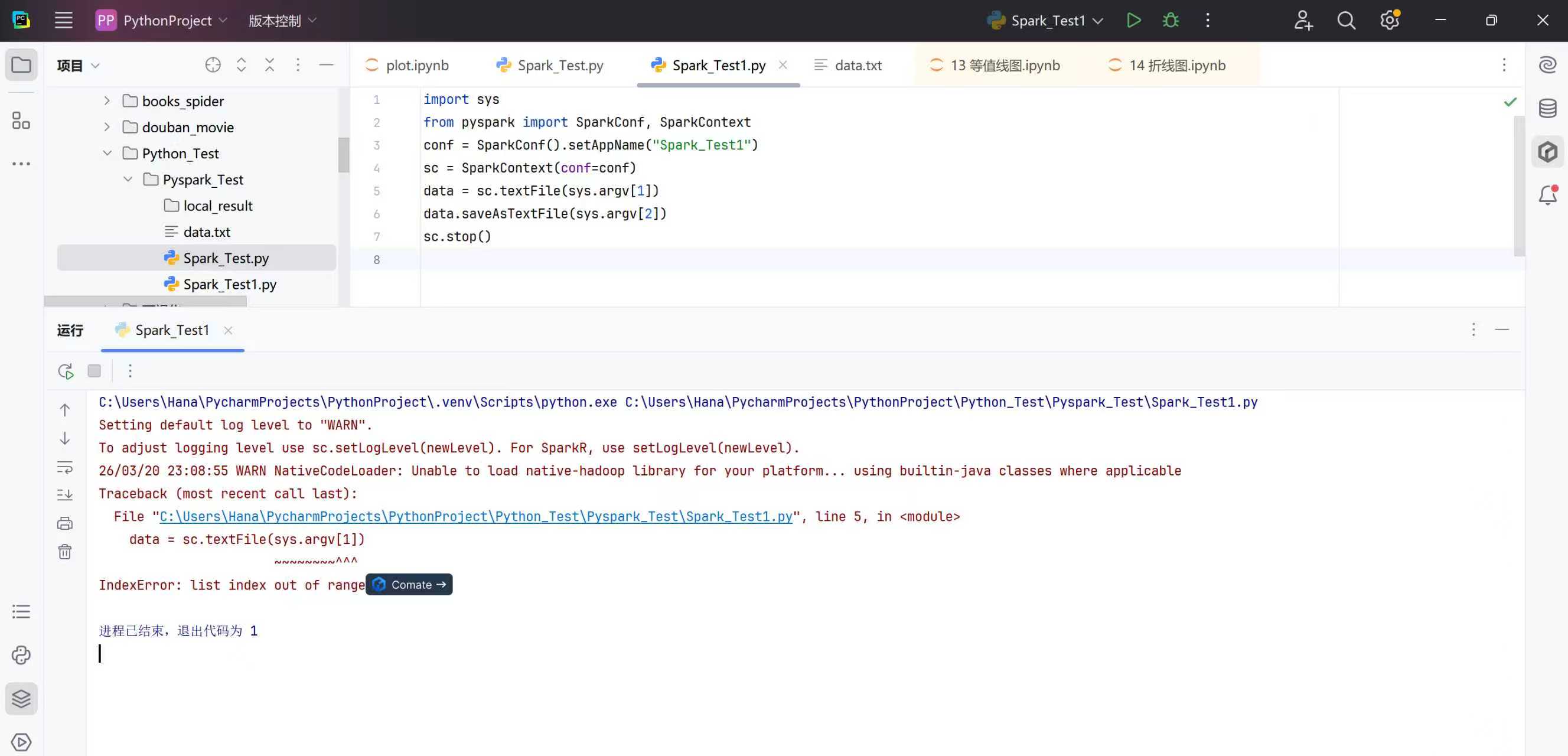

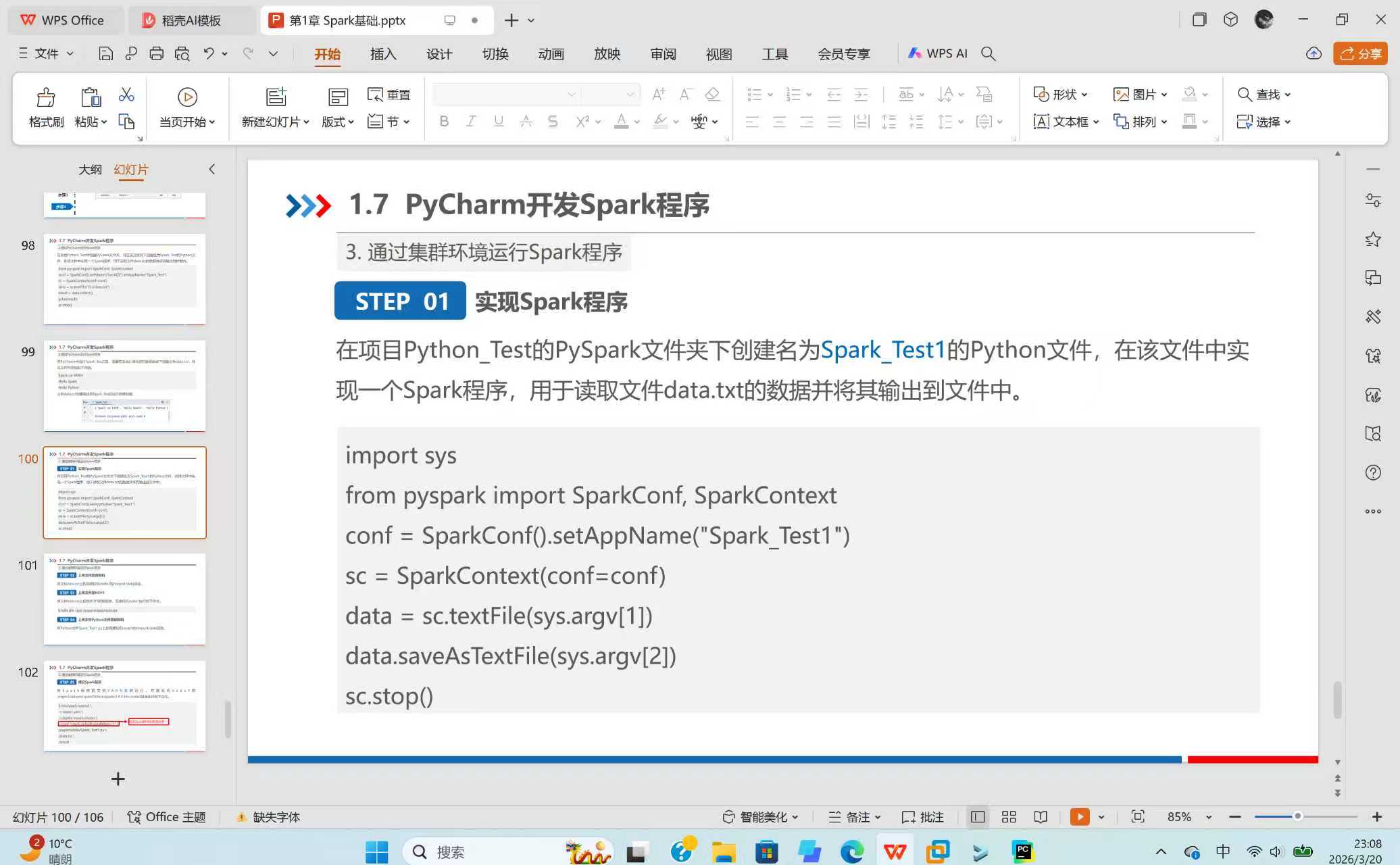

pycharm开发spark程序

豆包给的方案:在 PyCharm 中配置运行参数(推荐,符合课件要求)

1. 点击右上角运行配置下拉框 → 选择「编辑配置」

2. 在「参数」一栏中填入输入输出路径(对应课件要求):

data.txt local_result

3. 点击「应用」→「确定」,再重新运行脚本。

依旧不能成功

1. 点击右上角运行配置下拉框 → 选择「编辑配置」

2. 在「参数」一栏中填入输入输出路径(对应课件要求):

data.txt local_result

3. 点击「应用」→「确定」,再重新运行脚本。

依旧不能成功

晚上好🌙🌙🌙

本答案参考通义千问

在 PyCharm 中运行 Spark 程序时遇到报错,可能涉及多个方面的问题。以下是详细的排查和解决步骤,请根据实际情况逐步检查并修复问题。

spark-submit 或 SparkContext。pyspark,需要先通过 pip 安装:

pip install pyspark

No module named 'pyspark' 或 SparkContext not found。Script path 中指定你的 .py 文件路径。Parameters 中填写输入输出路径,例如:

--input /path/to/input --output /path/to/output

spark-submit 命令,需在 Script path 中写入 spark-submit 的路径,而不是你的 Python 脚本。ModuleNotFoundError: No module named 'pandas' 或其他依赖缺失。pip install 安装缺失的依赖包。File → Settings → Project: <project_name> → Python Interpreter,然后点击 + 添加所需库。Application failed to start 或 Driver is not running。local[*] 模式,确保本地 Spark 环境已启动。--master 参数正确(如 yarn、k8s 等)。+ 号,选择 Python 类型。SparkApp)。C:/myproject/spark_app.py)。--input input.txt --output output.txt)。C:/myproject)。spark-submit --version

SPARK_HOME 和 PATH)。from pyspark import SparkConf, SparkContext

conf = SparkConf().setAppName("MyApp")

sc = SparkContext(conf=conf)

# your code here

sc.stop()

SparkContext,也会导致错误。argparse 或类似工具解析参数。import argparse

from pyspark import SparkConf, SparkContext

def main():

parser = argparse.ArgumentParser(description="Spark Application")

parser.add_argument("--input", help="Input file path")

parser.add_argument("--output", help="Output file path")

args = parser.parse_args()

conf = SparkConf().setAppName("MyApp")

sc = SparkContext(conf=conf)

# 读取数据

data = sc.textFile(args.input)

# 处理逻辑

result = data.map(lambda x: x.upper()).saveAsTextFile(args.output)

sc.stop()

if __name__ == "__main__":

main()

| 错误信息 | 解决方案 |

|----------|----------|

| No module named 'pyspark' | 安装 pyspark:pip install pyspark |

| spark-submit not found | 安装 Spark 并配置环境变量 |

| Driver is not running | 检查 Spark 配置和 SparkContext 初始化 |

| Permission denied | 检查 HDFS 或本地文件权限 |

spark-submit 是否可用。argparse 解析命令行参数,避免硬编码路径。如有更多具体错误信息,欢迎继续提问,我会帮助你进一步分析。