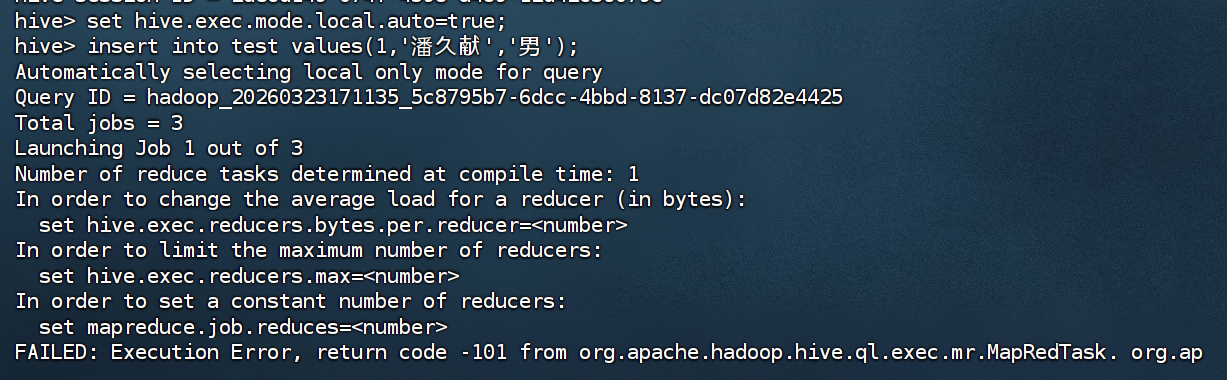

hive部署好后,在hive里进行数据的操作一直失败,改成本地模式也不行,为什么?

下午好🌅🌅🌅

本答案参考通义千问

在 Hive 部署完成后,如果在 Hive 中进行数据操作一直失败,并且即使切换到本地模式(local mode)也无法运行,这通常意味着存在一些配置问题或环境问题。以下是一些可能的原因和解决方案:

hive-site.xml)中可能存在不正确的参数设置。hive.exec.mode.local.auto 设置为 false,或者 hive.metastore.warehouse.dir 路径无效。core-site.xml 或 hdfs-site.xml 配置有误。检查 hive-site.xml 文件:

<property>

<name>hive.exec.mode.local.auto</name>

<value>true</value> <!-- 确保设置为 true 以启用本地模式 -->

</property>

<property>

<name>hive.metastore.warehouse.dir</name>

<value>/user/hive/warehouse</value>

</property>

修改后重启 Hive 服务:

hive --service metastore

检查 Hadoop 是否启动:

jps

应看到 NameNode, DataNode, ResourceManager, NodeManager 等进程。

检查 HDFS 目录权限:

hdfs dfs -ls /

确保你有权限访问 HDFS。

如果使用 Derby:

schematool -dbType derby -initSchema

hive-site.xml 中的 javax.jdo.option.ConnectionURL 是否正确。确认 Java 版本:

java -version

建议使用 JDK 8 或以上版本。

设置环境变量:

export JAVA_HOME=/usr/lib/jvm/java-8-openjdk-amd64

如果你希望强制使用本地模式,可以手动设置如下参数:

在 Hive 命令行中设置:

SET hive.exec.mode.local.auto=true;

SET hive.exec.mode.local.auto.inputbytes.max=100000000; -- 根据你的数据量调整

SET hive.exec.mode.local.auto.output.file.count=1;

查看 Hive 日志文件:

tail -f /var/log/hive/hive.log

或根据你的部署路径查找日志文件。

如果你在 Hive 脚本中执行查询,例如:

CREATE TABLE test_table (id INT);

INSERT OVERWRITE DIRECTORY '/output'

SELECT * FROM source_table;

请确保 /output 目录在 HDFS 中存在且可写。

创建 HDFS 目录并赋权:

hdfs dfs -mkdir -p /output

hdfs dfs -chmod 777 /output

| 问题类型 | 解决方案 |

|----------|----------|

| Hive 配置错误 | 检查 hive-site.xml,确保 hive.exec.mode.local.auto 为 true |

| Hadoop 环境异常 | 检查 Hadoop 是否正常启动,HDFS 权限是否正确 |

| 元数据库问题 | 初始化或修复 Derby 数据库 |

| Java 环境问题 | 确保 JDK 正确安装并配置 JAVA_HOME |

| Hive 日志分析 | 查看 Hive 日志文件定位具体错误 |

如果你能提供具体的错误信息或日志内容,我可以进一步帮助你定位问题。