我现在手上有正点原子h743的板子,想实现物品识别(两到三个),我想部署yolov5,可以实现吗,或者有啥更好的方案吗

晚上好🌙🌙🌙

本答案参考通义千问

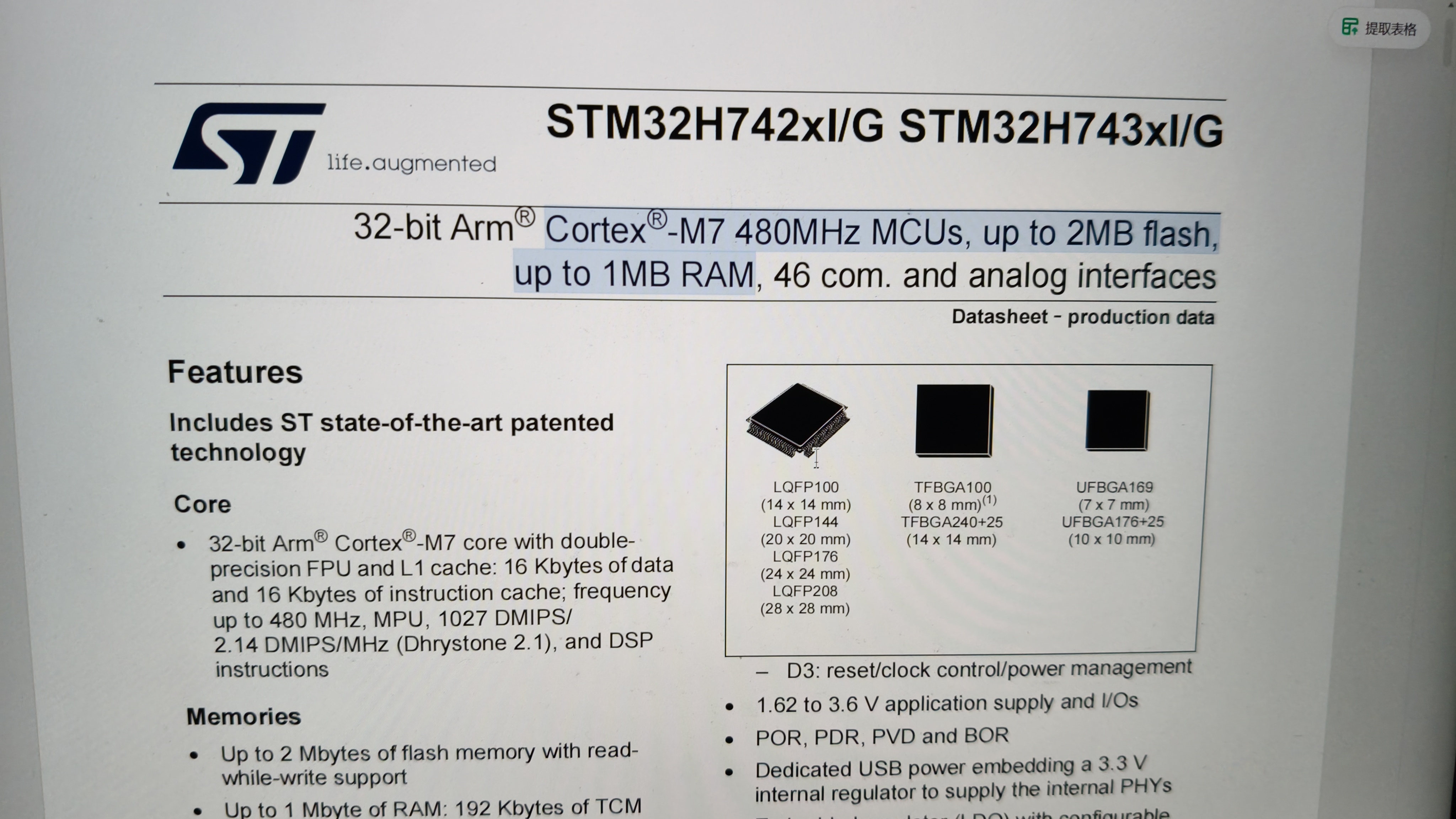

你手上的 正点原子H743 是一款基于 STM32H743 的高性能嵌入式开发板,拥有强大的处理能力(主频高达400MHz),适合运行一些轻量级的机器学习模型。如果你想在上面实现 物品识别(两到三个),可以考虑部署 YOLOv5 或者更轻量化的 YOLOv8、MobileNetV3 + YOLO 等方案。

下面我将从几个方面详细分析,并给出具体解决方案:

YOLOv5 模型本身是为 GPU 设计的,直接在 H743 上运行会非常吃力,因为:

所以,直接部署原始 YOLOv5 不太现实,但可以通过以下方式优化后部署:

YOLOv8 是 YOLOv5 的升级版,具有更好的性能和精度,且对嵌入式平台有更好的支持。

你可以结合 MobileNetV3 作为骨干网络,再接一个轻量的 YOLO 分类器,这样可以显著降低模型大小和计算量。

安装 Python 环境(建议使用 conda 或 virtualenv)

安装 PyTorch 和 YOLOv5 相关库:

pip install torch torchvision torchaudio

git clone https://github.com/ultralytics/yolov5

cd yolov5

pip install -r requirements.txt

训练自己的模型(如果你没有现成的模型):

python train.py --img 640 --batch 16 --epochs 100 --data your_dataset.yaml --weights '' --name my_yolov5s

python export.py --weights runs/train/my_yolov5s/weights/best.pt --include onnx

注意:H743 是 STM32 平台,不支持标准的 ONNX Runtime,因此你需要使用 ONNX Lite 或其他嵌入式推理引擎。

示例代码(伪代码):

// 加载 ONNX 模型

onnx::Session session("model.onnx");

// 输入图像预处理

cv::Mat image = imread("test.jpg");

image = resize(image, Size(640, 640));

float* input_data = preprocess(image);

// 执行推理

std::vector<float> output = session.run(input_data);

// 解析输出结果

for (auto& result : output) {

// 处理检测结果

}

如果你希望更极致地优化模型,可以考虑使用 TinyML 技术,例如:

这些技术更适合资源受限的嵌入式设备。

✅ 重点步骤如下:

from models.common import DetectMultiBackend

from utils.general import check_img_size

# 加载模型

model = DetectMultiBackend('yolov5s.pt', device='cpu')

imgsz = check_img_size((640, 640), stride=model.stride, pt=model.pt)

# 导出 ONNX

export_model = model.model.export(imgsz=imgsz, half=False)

export_model.save('yolov5s.onnx')

#include "onnx_lite.h"

void predict() {

ONNX_LITE_SESSION* session = onnx_lite_load_model("yolov5s.onnx");

float input[1 * 3 * 640 * 640]; // 假设输入是 640x640 RGB 图像

float output[1 * 84 * 80 * 80]; // 输出维度

// 输入预处理

preprocess_image(input);

// 推理

onnx_lite_run(session, input, output);

// 后处理

postprocess(output);

}

| 方案 | 是否可行 | 优点 | 缺点 | |------|----------|------|------| | YOLOv5s | ✅ | 模型小,社区支持好 | 推理速度较慢 | | YOLOv8 | ✅ | 性能更好,结构更优 | 需要更多优化 | | TinyML | ✅ | 极致优化 | 开发难度高 | | TensorRT | ❌ | 推理速度快 | H743 不支持 |

如有需要,我可以提供 完整的 H743 移植 ONNXLite 的教程 或 YOLOv5s 的 C 语言推理代码模板。欢迎继续提问!