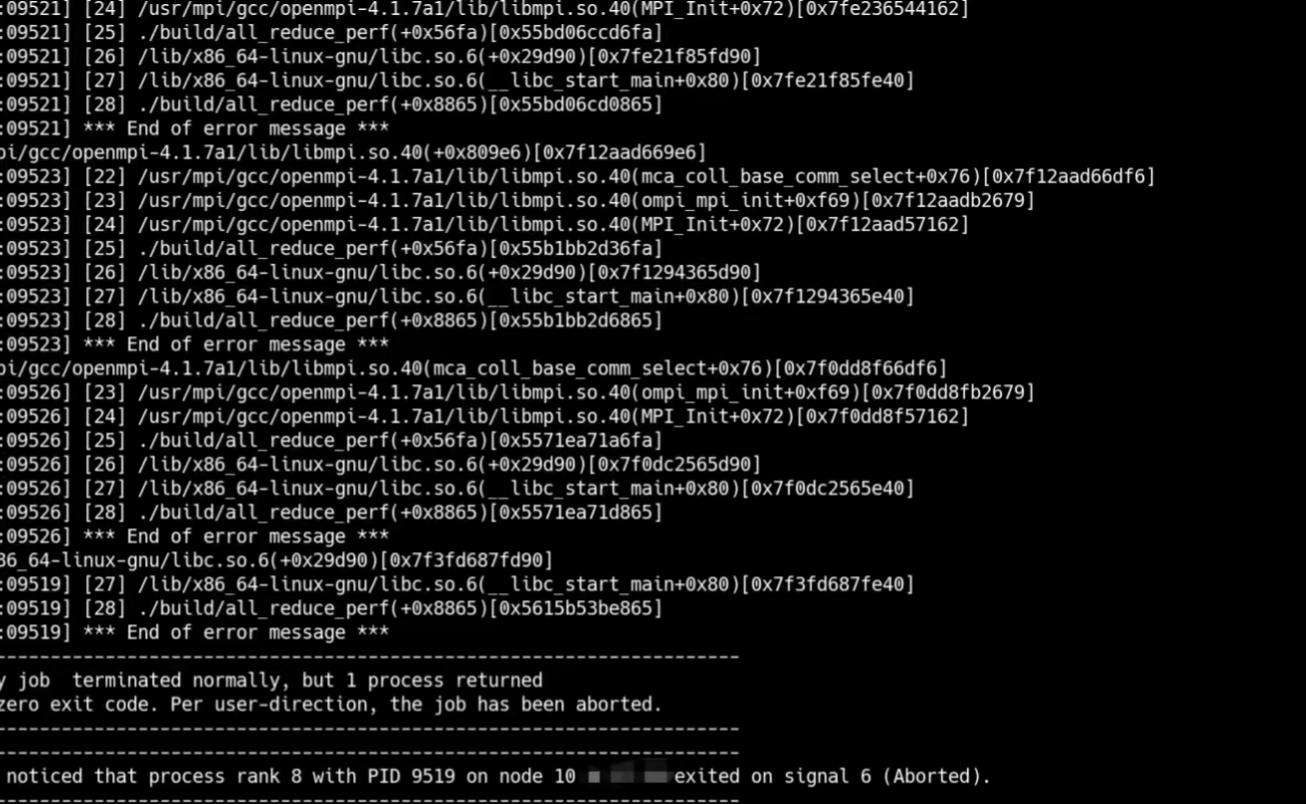

双机gpu服务器nccl测试报错,版本看着没问题,怎么解决啊

下午好🌅🌅🌅

本答案参考通义千问

双机 GPU 服务器进行 NCCL 测试时出现报错,可能是由于网络配置、NCCL 版本不兼容、CUDA 驱动版本不一致、主机名解析问题或防火墙设置等引起的。以下是一些重点排查和解决方案,并附上修改后的代码示例。

nvcc --version 和 nccl-info 查看版本。注意: 不同 CUDA 版本对应的 NCCL 版本不同,需确保对应关系正确。

ping 或 telnet <host> <port> 测试网络连通性。export NCCL_SOCKETS_PORT=12345

重要: 如果使用多网卡,可以指定特定的 IP 地址:

export NCCL_IB_HOPLIST="192.168.1.1 192.168.1.2"

/etc/hosts 中互相映射了对方的 IP 地址。/etc/hosts 内容:192.168.1.1 machine1

192.168.1.2 machine2

hostname 命令确认主机名是否一致。sudo systemctl stop firewalld

sudo firewall-cmd --zone=public --add-port=12345/tcp --permanent

sudo firewall-cmd --reload

nccl-tests 工具验证 NCCL 功能git clone https://github.com/NVIDIA/nccl.git

cd nccl

make -j

mpirun -np 2 -hostfile hosts.txt ./build/all_reduce_perf

hosts.txt 内容如下:machine1:1

machine2:1

| 错误信息 | 原因 | 解决方案 |

|----------|------|----------|

| NCCL error: failed to connect | 网络不通或端口被封锁 | 检查网络连接、防火墙、端口配置 |

| NCCL error: invalid rank | 主机名或 IP 映射错误 | 检查 /etc/hosts 和主机名一致性 |

| NCCL error: not initialized | NCCL 库未正确加载 | 确认 CUDA 和 NCCL 安装完整 |

| NCCL error: no device found | GPU 驱动或设备未就绪 | 检查 NVIDIA 驱动和 GPU 状态 |

如果你在运行自定义的 NCCL 测试程序,可以尝试以下代码片段来调试:

#include <nccl.h>

#include <cuda_runtime.h>

#include <iostream>

int main() {

int nDevices;

cudaGetDeviceCount(&nDevices);

if (nDevices < 2) {

std::cerr << "Error: Need at least two GPUs." << std::endl;

return -1;

}

ncclComm_t comm;

int rank = 0; // 根据实际分配的 rank 设置

int size = 2;

ncclInit();

ncclCommInitRank(&comm, size, rank);

// ... 其他 NCCL 操作 ...

ncclCommDestroy(comm);

ncclShutdown();

return 0;

}

注意: 实际使用中应配合 MPI 或其他分布式框架(如 PyTorch、TensorFlow)来启动多个进程。

ping 和 telnet 测试。如你提供具体的错误信息,我可以进一步帮你定位问题根源。希望以上内容对你有帮助!