刚刚开始学习keras,今天在测试非线性函数拟合的时候发现即便用了‘relu’激活函数还是没有办法很好的拟合结果,这已经困扰我很久了,而且更奇怪的是有一句看起来和结果毫无关系的语句居然会直接改变结果的分布

就是这一句:

print(y_pred)

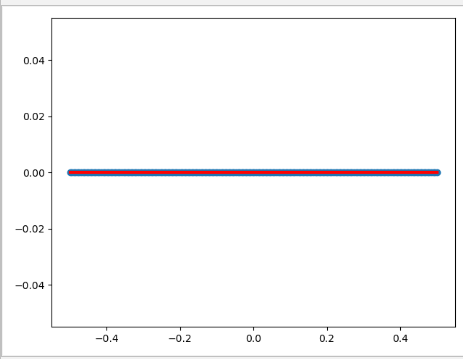

没有加的时候的结果:

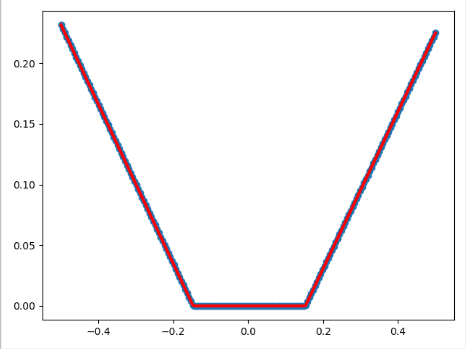

加了之后的结果:

或者

代码如下:

import keras

import numpy as np

import matplotlib.pyplot as plt

#按顺序构成的模型

from keras.models import Sequential

#全连接层

from keras.layers import Dense,Activation

from keras.optimizers import SGD

#使用numpy生成随机数据

x_data = np.linspace(-0.5,0.5,200)

noise = np.random.normal(0,0.02,x_data.shape)

y_data = np.square(x_data) + noise

#显示随机点

plt.scatter(x_data,y_data)

plt.show()

# 构建一个顺序模型

model = Sequential()

# 在模型中添加一个全连接层

model.add(Dense(units=10,input_dim=1,activation='relu'))

# model.add(Activation("relu"))不行?

#model.add(Activation("relu"))

model.add(Dense(units=1,activation='relu'))

# model.add(Activation("relu"))不行

#model.add(Activation("relu"))

# 定义优化算法

sgd = SGD(lr=0.3)

model.compile(optimizer=sgd,loss="mse")

for step in range(3000):

cost = model.train_on_batch(x_data,y_data)

if step%500==0:

print("cost: ",cost)

W,b = model.layers[0].get_weights()

print("W: ",W,"b: ",b)

# x_data输入网络中,得到预测值

y_pred = model.predict(x_data)

# 加不加这一句会对结果造成直接影响

print(y_pred)

plt.scatter(x_data,y_pred)

plt.plot(x_data,y_pred,"r-",lw=3)

plt.show()