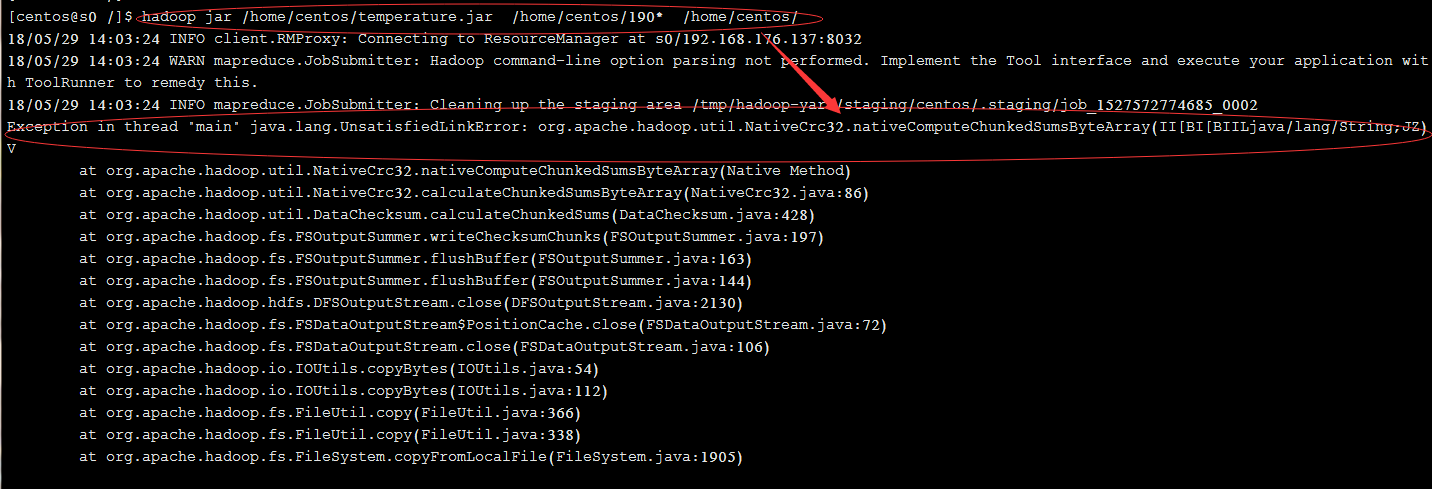

我是在centos操作系统上运行hadoop集群报这个错,Exception in thread "main" java.lang.UnsatisfiedLinkError:

我是在centos操作系统上运行hadoop集群报这个错,Exception in thread "main" java.lang.UnsatisfiedLinkError:

org.apache.hadoop.util.NativeCrc32.nativeComputeChunkedSumsByteArray(II[BI[BIILjava/lang/String;JZ)V ; 我发现凡是运行的程序需要依赖hadoop集群都会报这个错,之前是好好的,现在就报这个错了 ,网上查了好多都是针对windows的,说复制hadoop.dll啥的,没用啊,我这个问题是出现在linux系统上的呀,怎么解决,难道又要我重新搭建环境?

util.NativeCrc32.nativeComputeChunkedSumsByteArray

- 写回答

- 好问题 0 提建议

- 追加酬金

- 关注问题

- 邀请回答

-

4条回答 默认 最新

不急吃口药 2018-05-31 10:00关注

不急吃口药 2018-05-31 10:00关注已经解决,复制的hadoop源码到 lib-->native 中不对版导致的!

本回答被题主选为最佳回答 , 对您是否有帮助呢?解决 无用评论 打赏 举报

悬赏问题

- ¥50 C# 使用DEVMOD设置打印机首选项

- ¥15 想用@vueuse 把项目动态改成深色主题,localStorge里面的vueuse-color-scheme一开始就给我改成了dark,不知道什么原因(相关搜索:背景颜色)

- ¥20 OPENVPN连接问题

- ¥15 flask实现搜索框访问数据库

- ¥15 mrk3399刷完安卓11后投屏调试只能显示一个设备

- ¥100 如何用js写一个游戏云存档

- ¥15 ansys fluent计算闪退

- ¥15 有关wireshark抓包的问题

- ¥15 需要写计算过程,不要写代码,求解答,数据都在图上

- ¥15 向数据表用newid方式插入GUID问题