关注

码龄 粉丝数 原力等级 --

- 被采纳

- 被点赞

- 采纳率

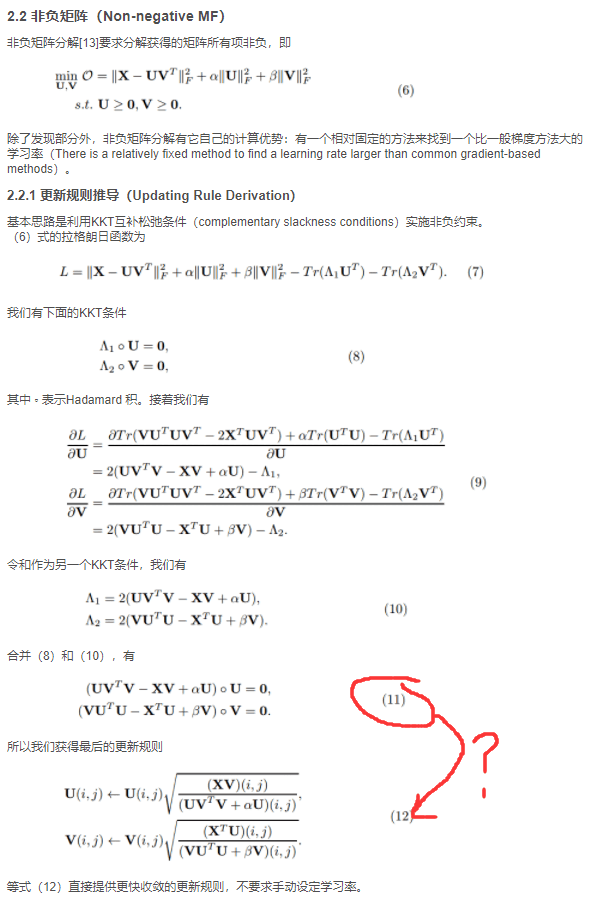

非负矩阵分解更新公式推到疑问

收起

- 写回答

- 好问题 0 提建议

- 关注问题

微信扫一扫点击复制链接

微信扫一扫点击复制链接分享

- 邀请回答

- 编辑 收藏 删除 结题

- 收藏 举报

1条回答 默认 最新

- 关注

码龄 粉丝数 原力等级 --

- 被采纳

- 被点赞

- 采纳率

dabocaiqq 2018-10-26 05:47关注本回答被题主选为最佳回答 , 对您是否有帮助呢? 本回答被专家选为最佳回答 , 对您是否有帮助呢? 本回答被题主和专家选为最佳回答 , 对您是否有帮助呢?解决 无用评论 打赏举报

dabocaiqq 2018-10-26 05:47关注本回答被题主选为最佳回答 , 对您是否有帮助呢? 本回答被专家选为最佳回答 , 对您是否有帮助呢? 本回答被题主和专家选为最佳回答 , 对您是否有帮助呢?解决 无用评论 打赏举报 微信扫一扫点击复制链接

微信扫一扫点击复制链接分享

评论按下Enter换行,Ctrl+Enter发表内容

报告相同问题?

提交

- 2018-08-31 21:43qq_36329233的博客 公式都亲自推导一遍或者直接打印下来(可直接打印网页版或本文文末附的PDF) 在文稿上演算,从而享受随时随地思考、演算的极致快感 。 OK,还是那句话,有任何问题,欢迎任何人随时不吝指正 & 赐教,感谢。 第一层...

- 2026-04-06 20:23flyair_China的博客 这样,我们可以先计算φ(K)^T V(维度为 d_feature × d_model)和φ(K)^T 1_L(维度为 d_feature ×1),然后与φ(Q)相乘,...短期记忆:一个可更新的记忆矩阵M_s,维度为 m_s × d_model,其中m_s较小(例如1024)。

- 2021-07-12 07:003D视觉工坊的博客 具体的讨论请参考这里,本文直接给出结论:当 |M|=−1 时,使得 trace(ΣM) 最大的 M 为: 综合考虑 和 两种情况,我们可以得到: 至此公式推导完了,简单总结一下求解最优变换的步骤: 计算源点云和目标点云质心...

- 2020-04-16 17:10人工智能小花的博客 接下来几章我会陆续给大家介绍AI的数学基础,本章将首先给大家介绍线性代数如何应用于AI。 1. 从初等函数到高等数学 一元线性函数 在中学的初等数学里,把函数f(x)=kx+bf(x)=kx+bf(x)=kx+b (k,bk,bk,b是不变量),...

- 2023-04-25 12:02v_JULY_v的博客 且过程中会尽可能写透彻每一个模型的原理,举两个例子 网上介绍VAE的文章都太数学化(更怕那种表面正确其实关键的公式是错的误导人),如果更边推导边分析背后的理论意义(怎么来的 出发点是什么 为什么要这么做 这么做...

- 2024-12-09 18:03星河AI的博客 DJ的秘密武器:M0 和位移操作 为了保证派对的顺利进行,DJ ( M ) 有一个秘密武器——它可以被分解为两部分:一个小于1但大于等于0.5的实数 ( M_0 ),和一个非负整数 ( n )。这意味着 M = 2 − n ⋅ M 0 M = 2^{-n} ...

- 2019-09-24 18:16同花顺技术的博客 接下来几章我会陆续给大家介绍AI的数学基础,本章将首先给大家介绍线性代数如何应用于AI。 1. 从初等函数到高等数学 一元线性函数 在中学的初等数学里,把函数f(x)=kx+bf(x)=kx+bf(x)=kx+b (k,bk,bk,b是不变量),...

- 2026-05-08 19:08小怪兽会微笑的博客 Transformers are RNNs: Fast Autoregressive Transformers with Linear Attention 在为智能体评估和构建超过 100k token 上下文的超长记忆(ultra long mem)机制时,标准 Transformer 中 O(N2)\mathcal{O}(N^{2})O...

- 2024-05-05 19:54Karen_Yu_的博客 图嵌入的缺陷 图嵌入大致可以分为三类:矩阵分解、随机游走、深度学习 作者在这里提到的图嵌入的常见模型(DeepWalk、Node2Vec)我都没听过,所以看过再更新这里。 3. GNN的优点 1)节点 对于图结构,没有天然的...

- 2024-11-20 23:09whaosoft-143的博客 方法的完整数学描述略显复杂,如果只是想了解主要思想,可以只看上面 PatchMix的流程图即可(其实只是公式多,每个公式也不复杂,后续有机会做个演示动画,帮助大家理解。这个方法也可以用简单的 Mask 方法实现,...

- 2025-04-01 14:22阿正的梦工坊的博客 变量变换公式推导 以下是对Normalizing Flows中变量变换公式 ( p x ( x ) = p u ( u ) ∣ det J T ( u ) ∣ − 1 p_{\mathbf{x}}(\mathbf{x}) = p_{\mathbf{u}}(\mathbf{u}) \left| \det J_T(\mathbf{u}) \right...

- 2024-12-10 22:15whaosoft-143的博客 至于为什么要把它叫做核,是因为这个相似度指标必须满足一些性质,比如非负、对称。但我们这里不用管那么多,只需要知道核是一种衡量距离的指标,决定了核就决定了核回归的形式。 我们来通过一个简单的一维函数拟合...

- 2025-04-07 20:48阿正的梦工坊的博客 我们将详细解析其原理,探讨数学公式的来源,并推导其背后的过程,帮助读者深入理解这一创新方法。

- 2024-12-08 00:15whaosoft-143的博客 查询、键和值的转换 权重矩阵将输入数据投影到三个组成部分: 查询 (q) 键 (k) 值 (v) 这些组成部分通过矩阵乘法计算得出: 查询:q(i) = x(i)Wq 键:k(i) = x(i)Wk 值:v(i) = x(i)Wv 这里,'i'表示输入序列中长度...

- 2024-09-21 21:30RootKai的博客 使用torch.mm()进行矩阵与矩阵的乘法。使用进行更灵活的矩阵和向量的乘法。使用torch.mv()专门进行矩阵与向量的乘法。print(a)我们可以将矩阵-矩阵的乘法AB看成是简单的执行m次矩阵-向量积,并将结果拼接在一起,...

- 2024-11-06 16:14whaosoft-143的博客 这个想法建立在一个理论观察之上:对抗损失的上界主要由损失函数关于输入的最大曲率(即 Hessian 矩阵的最大特征值)决定。换句话说,如果损失景观在某个方向上"陡峭",那么沿这个方向的小扰动就容易造成损失的剧烈...

- 2018-07-24 09:51山水之间2018的博客 Henriques 大神先后两篇论文,影响后来很多工作,核心部分的岭回归,循环移位的近似密集采样,还给出了整个相关滤波算法的详细推导。还有岭回归加kernel-trick的封闭解,多通道HOG特征。 Martin Danelljan大牛...

- 2018-09-02 18:56意念回复的博客 3PCA推导 3.1 最大方差理论与最大可分性 3.1.1最大方差理论 3.1.2最大可分性 3.2 最小平方误差理论与最近重构性 3.2.1最小平方误差理论 3.2.2最近重构性 4 PCA算法 5PCA理论意义 6 总结与讨论 1 PCA简介 ...

- 2022-03-13 18:32PaperWeekly的博客 令 , 得到下面的公式: 推导过程如下: 最终,在不损失标准 Tansformer 优势的情况下,我们的到 COSFORMER 公式如下: 与位置编码的关系 上面的公式中,我们可以看到公式中存在 这样的位置关系,cosformer 提出了一...

- 2017-12-19 13:43上杉绘梨衣-的博客 公式都亲自推导一遍或者直接打印下来(可直接打印网页版或本文文末附的PDF,享受随时随地思考、演算的极致快感),在文稿上演算。 Ok,还是那句原话,有任何问题,欢迎任何人随时不吝指正 & 赐教,感谢。 ...

- 没有解决我的问题, 去提问