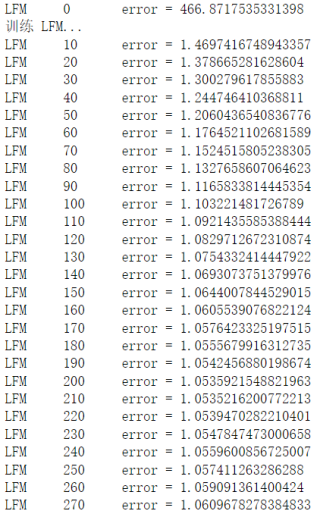

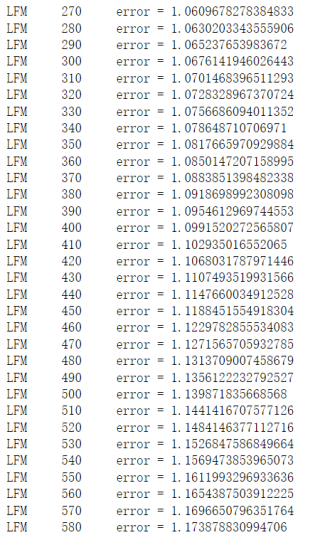

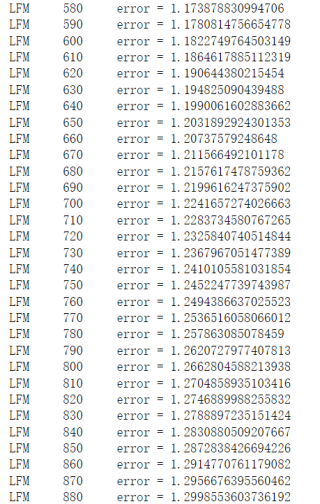

error是一个和方差sse,如下所示,一开始随着训练次数的增加sse确实在减少,但是到了差不多300次的时候又开始增加了,这是为啥,如下是我写的梯度下降,损失函数如下

loss = np.square(np.dot(u_vector, i_vector) - real_rating) - REG * (u_vector * u_vector + i_vector * i_vector)

实现的梯度下降如下

for epoch in range(LFM_EPOCHS):

for uid, iid, real_rating in train_data.itertuples(index=False):

u_vector = user_matrix[uid]

i_vector = movie_matrix[iid]

err = np.float32(real_rating - np.dot(u_vector, i_vector)) # 真实值和预测值的偏差

# 更新梯度

u_vector_cache = u_vector # 下面更新用户向量会覆盖掉,而更新物品向量需要用户向量旧值,所以这里得保存旧值

u_vector += LEARN * (err * i_vector - REG * u_vector) # 这是一个numpy对象

i_vector += LEARN * (err * u_vector_cache - REG * i_vector) # 这是一个Numpy对象

user_matrix[uid] = u_vector

movie_matrix[iid] = i_vector

if epoch % 10 == 0: # 每10次训练,计算一次sse

test_1(epoch)