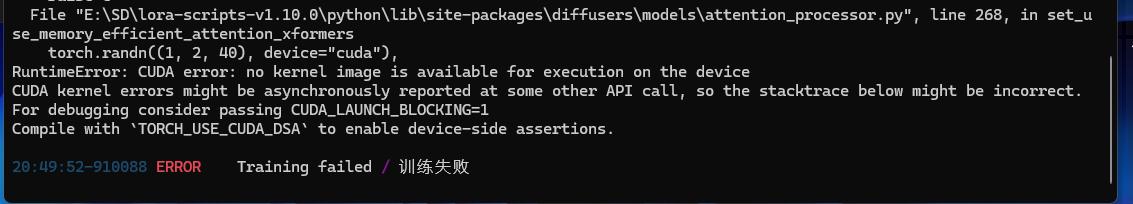

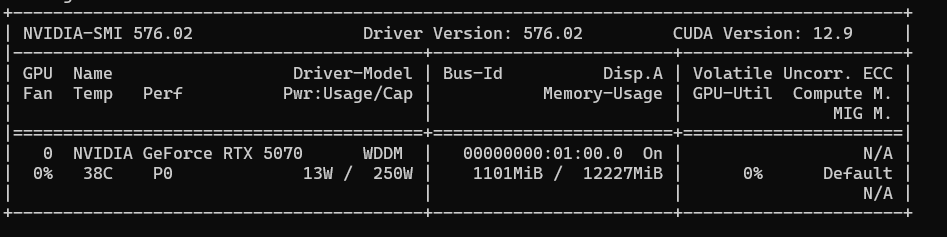

在训练lora的过程中产生报错,但是不知道问题出在哪里,求帮忙解答

晚上好🌙🌙🌙

本答案参考通义千问

在使用 LoRA(Low-Rank Adaptation) 进行模型微调时,遇到报错是非常常见的问题。为了更准确地帮助你解决问题,请提供以下信息:

bert-base-uncased 或 Llama-3)模型不支持 LoRA,或者未正确加载 LoRA 配置。

确保你使用的是支持 LoRA 的库,例如:

示例代码(使用 PEFT):

from peft import LoraConfig, get_peft_model

from transformers import AutoModelForSequenceClassification

model = AutoModelForSequenceClassification.from_pretrained("bert-base-uncased")

config = LoraConfig(r=8, lora_alpha=16, target_modules=["q", "v"], lora_dropout=0.1)

model = get_peft_model(model, config)

重点:确保你的模型是可适配的(即支持 LoRA),否则会抛出 KeyError。

模型权重类型与输入数据类型不一致,例如模型是 float32 而输入是 float64。

model.to(torch.float32) # 或 torch.float16

inputs = {k: v.to(torch.float32) for k, v in inputs.items()}

重点:确保模型和输入数据类型一致,避免 GPU 内存溢出或计算错误。

显存不足,尤其是在使用大模型进行 LoRA 微调时。

torch.cuda.empty_cache() 清理缓存gradient checkpointing示例代码(混合精度):

from torch.cuda.amp import autocast

with autocast():

outputs = model(inputs)

loss = outputs.loss

loss.backward()

重点:合理控制 batch size 和使用混合精度可以显著减少显存占用。

某个参数被错误地设置为 None,而程序期望它是一个整数。

r(LoRA rank)lora_alphatarget_modulesconfig = LoraConfig(

r=8, # 正确

lora_alpha=16,

target_modules=["q", "v"],

lora_dropout=0.1

)

重点:确保所有 LoRA 参数都已正确赋值,不要留空或设为 None。

某些模型(如 Llama)没有 get_input_embeddings 方法,但 PEFT 需要这个接口。

LoraModel 替代 AutoModelfrom peft import LoraModel

# 假设 model 是一个 AutoModel 实例

lora_model = LoraModel(model, config)

重点:对于部分模型(如 Llama、Mistral),需要特别处理其嵌入层。

打印完整错误信息

将完整的错误日志复制粘贴过来,便于定位问题。

检查模型和配置是否匹配

确保你使用的模型支持 LoRA,并且配置参数正确。

尝试最小化测试案例

用一个简单的模型(如 bert-base-uncased)测试 LoRA 是否能正常运行。

更新依赖库

确保 transformers, peft, torch 等库版本兼容。

pip install --upgrade transformers peft torch

from transformers import AutoTokenizer, AutoModelForSequenceClassification

from peft import LoraConfig, get_peft_model

import torch

# 加载模型和分词器

model_name = "bert-base-uncased"

tokenizer = AutoTokenizer.from_pretrained(model_name)

model = AutoModelForSequenceClassification.from_pretrained(model_name)

# 设置 LoRA 配置

config = LoraConfig(

r=8,

lora_alpha=16,

target_modules=["q", "v"],

lora_dropout=0.1,

bias="none",

task_type="SEQ_CLS"

)

# 应用 LoRA

model = get_peft_model(model, config)

# 示例输入

inputs = tokenizer("This is a test sentence.", return_tensors="pt")

# 前向传播

with torch.no_grad():

outputs = model(**inputs)

print(outputs.logits)

如果你能提供具体的错误信息,我可以帮你更精准地定位问题!请将错误信息发给我,我会继续帮你分析。