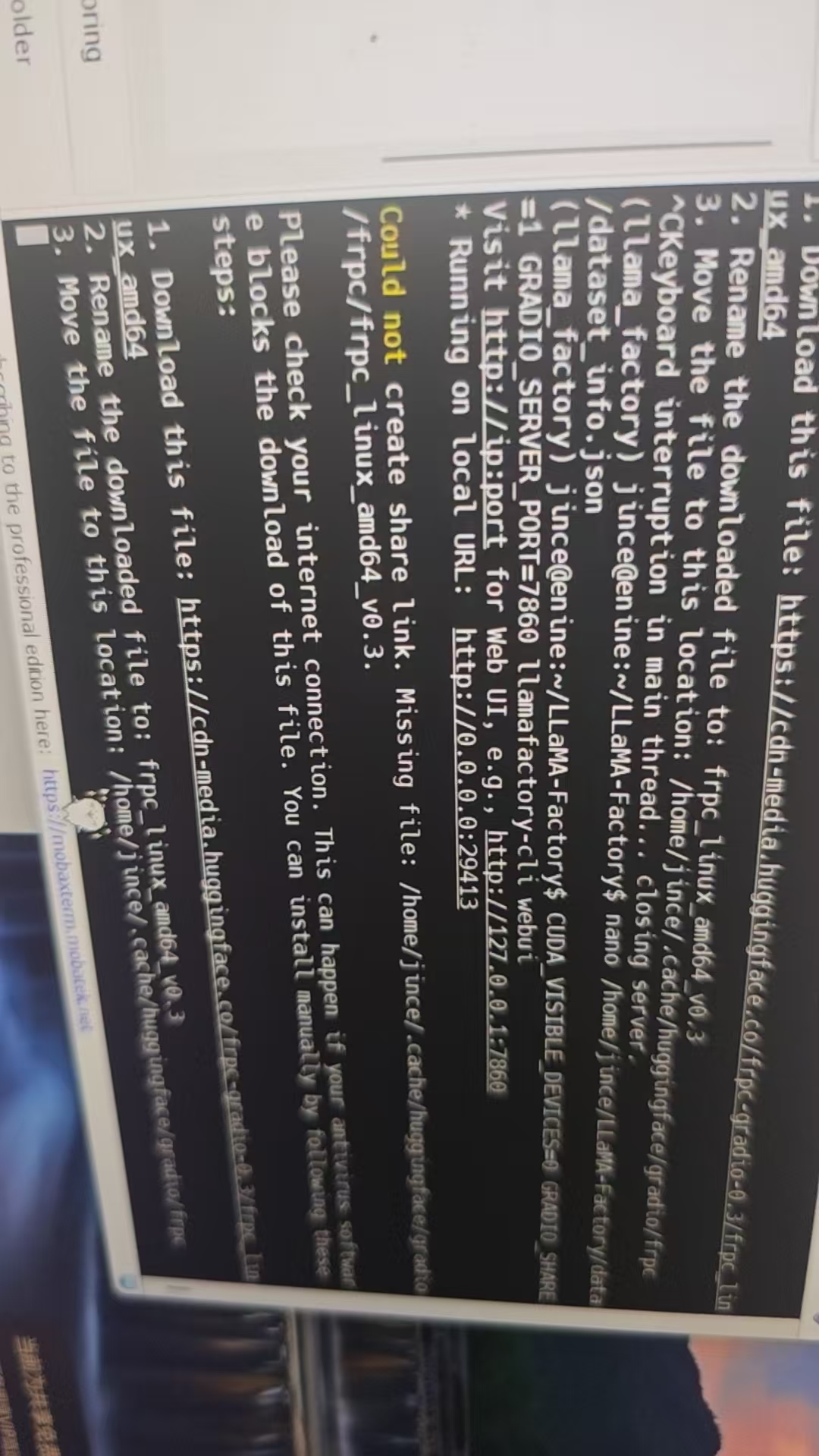

大模型报错这个怎么办,已经单独下载了这个文件但是找不到隐藏文件夹,不知道怎么把这个文件放进去。

下午好🌅🌅🌅

本答案参考通义千问

你提到的问题是关于大模型微调时打不开 WebUI,并且在尝试下载某个文件后无法找到隐藏文件夹,导致无法正确放置该文件。下面我将详细解释这个问题,并提供解决方案。

这可能是由于以下原因造成的:

通常,某些配置文件或资源文件被存储在隐藏文件夹中(例如 .config 或 .cache 文件夹),但你在操作系统中默认不显示这些隐藏文件夹,导致你无法直接找到并放置文件。

确保你已经安装了以下依赖:

pip install -r requirements.txt

如果找不到 requirements.txt,请查看项目文档,或者手动安装以下常见依赖:

pip install torch transformers gradio flask

注意: 如果你使用的是 GPU,确保安装的是

torch的 GPU 版本。

%APPDATA%,进入“AppData\Roaming”目录。.cache.configmodels 或 model_cachels -a ~/

查找类似 .cache, .config, 或者 .local/share 等目录。

假设你下载了一个模型文件,如 model.pth,你需要将其放到对应的隐藏文件夹中。

例如,如果你的模型需要放在 .cache 目录下:

cp model.pth ~/.cache/model.pth

注意: 路径可能根据模型不同而变化,请参考官方文档指定的路径。

有些 WebUI 项目会在启动时加载配置文件,比如 config.json 或 settings.py,你需要确认这些文件中指定的路径是否正确。

例如,在 config.json 中:

{

"model_path": "~/.cache/model.pth"

}

如果路径错误,修改为正确的路径即可。

完成上述操作后,重新运行 WebUI 脚本:

python webui.py

或者根据项目说明运行相应的启动命令。

| 错误提示 | 解决方案 |

|----------|----------|

| No module named 'gradio' | 安装依赖:pip install gradio |

| File not found: ... | 检查文件路径是否正确,确认文件已放入隐藏文件夹 |

| CUDA out of memory | 降低 batch size 或使用 CPU 模式 |

| Permission denied | 使用管理员权限运行脚本,或更改文件权限 |

如果你的 WebUI 启动脚本没有自动加载模型,可以手动指定路径:

from fastapi import FastAPI

import torch

from transformers import AutoTokenizer, AutoModelForCausalLM

app = FastAPI()

# 手动加载模型

model_path = "~/.cache/model.pth" # 修改为你实际的路径

tokenizer = AutoTokenizer.from_pretrained("bert-base-uncased")

model = AutoModelForCausalLM.from_pretrained(model_path)

@app.post("/predict")

async def predict(text: str):

inputs = tokenizer(text, return_tensors="pt")

outputs = model.generate(**inputs)

return {"response": tokenizer.decode(outputs[0], skip_special_tokens=True)}

如有更多具体错误信息或项目名称,我可以提供更针对性的帮助!