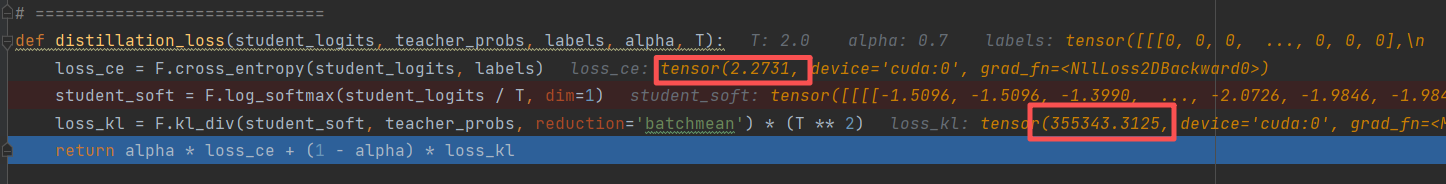

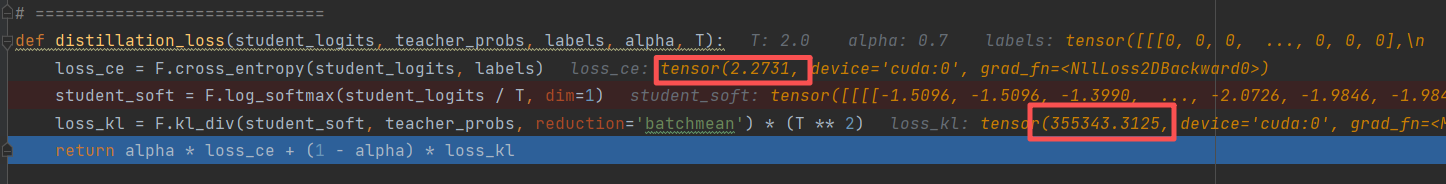

蒸馏任务时候遇到KL损失非常大的问题,通过查看teacher的预测分布,发现数值非常接近one-hot分布,这是导致KL损失非常大的原因吗?大家有遇到这种情况不,如何解决的。

蒸馏任务时候遇到KL损失非常大的问题,通过查看teacher的预测分布,发现数值非常接近one-hot分布,这是导致KL损失非常大的原因吗?大家有遇到这种情况不,如何解决的。

上午好☀️☀️☀️️

本答案参考通义千问

在语义分割模型的知识蒸馏(Knowledge Distillation, KD)任务中,KL散度(Kullback-Leibler Divergence)是常用的一种损失函数,用于衡量教师模型(teacher model)与学生模型(student model)之间的输出分布差异。你提到在训练过程中发现KL损失非常大,并且通过观察发现教师模型的预测分布非常接近 one-hot 分布,这确实可能是导致 KL 损失过大的一个关键原因。

KL 散度的计算公式为:

$$ D_{\text{KL}}(P \parallel Q) = \sum_i P(i) \log \frac{P(i)}{Q(i)} $$

其中:

当教师模型的输出分布非常接近 one-hot 分布时,意味着它对某个类别的预测概率非常高(接近 1),其他类别接近 0。此时,如果学生模型的预测分布与之不一致,就会导致 KL 散度急剧上升。

是的,这种情况在知识蒸馏中非常常见,尤其是在以下场景中:

很多研究者和实践者都遇到过类似的 KL 损失爆炸问题,并提出了多种解决方案。

原理:通过降低教师模型的输出温度(temperature),使其分布更“软”(即概率更分散),从而减少 KL 损失的剧烈变化。

修改后的代码示例(PyTorch):

# 教师模型的输出(假设是 logits)

teacher_logits = teacher_model(inputs)

# 使用温度系数对教师模型的输出进行 softmax

temperature = 4.0 # 通常选择大于1的温度值

teacher_probs = F.softmax(teacher_logits / temperature, dim=1)

# 学生模型的输出

student_logits = student_model(inputs)

student_probs = F.softmax(student_logits, dim=1)

# 计算 KL 损失

kl_loss = F.kl_div(

student_probs.log(),

teacher_probs,

reduction='batchmean'

)

重点说明:

使用温度系数可以显著缓解 KL 损失过大的问题,因为它让教师模型的分布更“平滑”,更容易被学生模型模仿。

有时教师模型的预测概率可能过于极端(比如接近 0 或 1),可以通过对输出进行 clip 操作来防止 KL 损失爆炸。

teacher_probs = torch.clamp(teacher_probs, min=1e-7, max=1 - 1e-7)

重点说明:

clip 操作可以避免 log(0) 导致的数值不稳定问题,同时也能减小 KL 损失的波动。

除了 KL 损失外,可以结合交叉熵损失(Cross Entropy Loss),让学生模型既学习教师的 soft labels,也学习真实标签(hard labels)。

# 假设 label 是真实标签(one-hot 编码)

ce_loss = F.cross_entropy(student_logits, label)

# KL 损失

kl_loss = F.kl_div(...)

# 总损失

total_loss = alpha * kl_loss + (1 - alpha) * ce_loss

重点说明:

混合损失能提高学生模型的学习稳定性,避免只依赖 KL 损失导致的过拟合或不收敛问题。

重点说明:

良好的初始化有助于学生模型更快地收敛,减少 KL 损失的波动。

重点说明:

分阶段蒸馏可以有效控制 KL 损失的大小,避免一开始就出现爆炸性增长。

| 问题 | 原因 | 解决方案 | |------|------|----------| | KL 损失过大 | 教师模型的输出接近 one-hot,导致 KL 散度剧烈变化 | 使用温度系数、clip 操作、混合损失、合理初始化、分阶段蒸馏 |

如果你有具体的代码实现或模型结构,我可以进一步帮你优化蒸馏过程。欢迎继续提问!