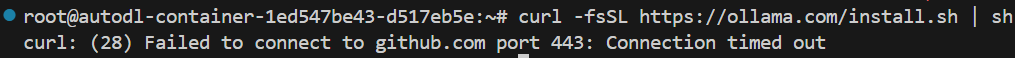

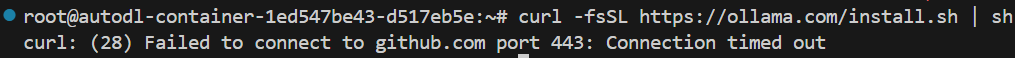

我在Auto DL租用了GPU,使用VS Code远程连接,我想部署Ollama,然后在上面运行大模型。

但现在遇到了这个问题,这个问题该如何解决呢?还有其他方法部署Ollama吗?

求解答,谢谢!

我在Auto DL租用了GPU,使用VS Code远程连接,我想部署Ollama,然后在上面运行大模型。

但现在遇到了这个问题,这个问题该如何解决呢?还有其他方法部署Ollama吗?

求解答,谢谢!

晚上好🌙🌙🌙

本答案参考通义千问

在云服务器上部署 Ollama 是一个相对简单的过程,尤其是在你已经租用了 GPU 的情况下。Ollama 是一个轻量级的模型服务工具,支持多种大模型(如 Llama、Llama2、ChatGLM 等),非常适合在云服务器上运行。

下面我将详细说明如何在 Auto DL 云平台上的 GPU 实例中部署 Ollama,并解决可能遇到的问题。

Ollama 推荐使用 Docker 部署,因为这样可以避免依赖问题。

sudo apt update

sudo apt install docker.io -y

sudo systemctl enable --now docker

注意: 如果你没有权限,可以使用

sudo或者将用户加入docker组。

Ollama 提供了官方的 Docker 镜像,你可以直接拉取并运行:

docker pull ollama/ollama:latest

docker run -d -p 11434:11434 --name ollama ollama/ollama:latest

关键点:

-d表示后台运行-p 11434:11434将容器的 11434 端口映射到主机的 11434 端口--name ollama给容器命名,方便管理

docker ps

你应该看到类似如下输出:

CONTAINER ID IMAGE COMMAND CREATED STATUS PORTS NAMES

abc123def456 ollama/ollama "/bin/sh -c 'exec s..." 10 seconds ago Up 9 seconds 0.0.0.0:11434->11434/tcp ollama

你可以通过浏览器或命令行访问 Ollama 的 API 地址:

http://<你的服务器IP>:11434

或者使用 curl 测试:

curl http://localhost:11434

原因: 云服务器的防火墙或安全组未开放 11434 端口。

解决方案:

原因: 可能是 Docker 配置错误、内存不足、或缺少依赖。

解决方案:

docker logs ollama

docker system prune -a

docker run -d -p 11434:11434 --gpus all --name ollama ollama/ollama:latest

原因: 国内网络限制导致 Ollama 无法连接到模型仓库。

解决方案:

使用国内镜像源(如阿里云)加速下载:

export HTTP_PROXY=http://your.proxy.server:port

export HTTPS_PROXY=http://your.proxy.server:port

或者手动下载模型文件,然后放入 Ollama 的存储目录中(默认为 /root/.ollama/models)

如果你不想用 Docker,也可以直接下载 Ollama 的可执行文件,但需要满足以下条件:

从 Ollama 官方 GitHub 下载对应系统的二进制文件。

例如,Linux 64位:

wget https://github.com/ollama/ollama/releases/download/v0.3.15/ollama-linux-amd64

chmod +x ollama-linux-amd64

mv ollama-linux-amd64 /usr/local/bin/ollama

ollama serve

注意: 此方法不推荐用于 GPU 服务器,因为 Ollama 默认只支持 CPU,除非你自行编译支持 GPU 的版本。

| 方法 | 优点 | 缺点 | |------|------|------| | Docker 部署 | 快速、易维护、兼容性强 | 需要配置 Docker | | 直接二进制部署 | 更轻量 | 不支持 GPU(除非自定义编译) |

你可以将以下内容保存为 deploy_ollama.sh 并执行:

#!/bin/bash

# 安装 Docker

sudo apt update && sudo apt install docker.io -y

sudo systemctl enable --now docker

# 拉取 Ollama 镜像

docker pull ollama/ollama:latest

# 运行 Ollama 容器

docker run -d -p 11434:11434 --name ollama ollama/ollama:latest

# 查看运行状态

docker ps | grep ollama

import requests

response = requests.post(

"http://<your_server_ip>:11434/api/generate",

json={"model": "llama2", "prompt": "Hello, world!"}

)

print(response.json())

llama3,可以先拉取模型:docker exec -it ollama ollama pull llama3

在 Auto DL 上部署 Ollama 是完全可行的,只要合理配置 Docker 和安全组,就能顺利运行大模型。如果你遇到了具体错误,欢迎提供错误信息,我可以帮你进一步排查。

如果你还有其他关于模型调优、API 使用等问题,也欢迎继续提问!