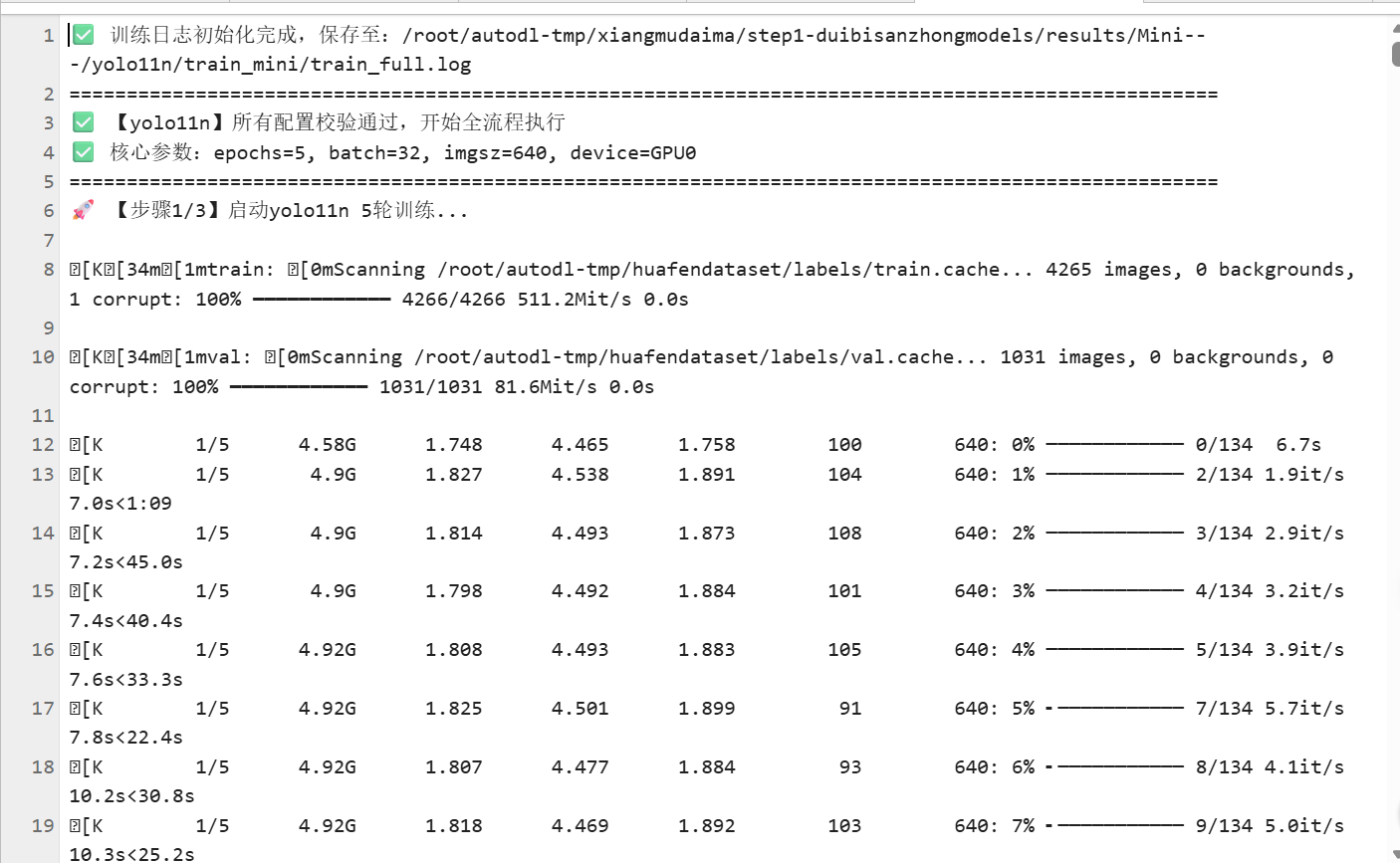

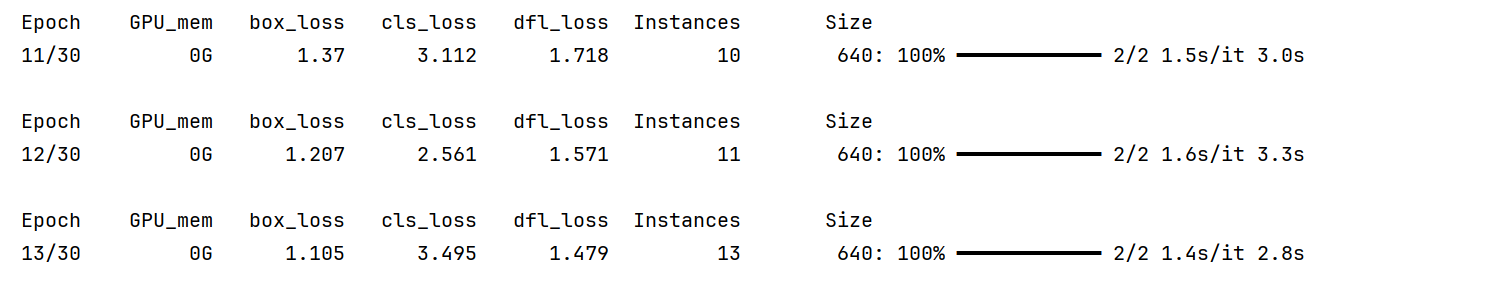

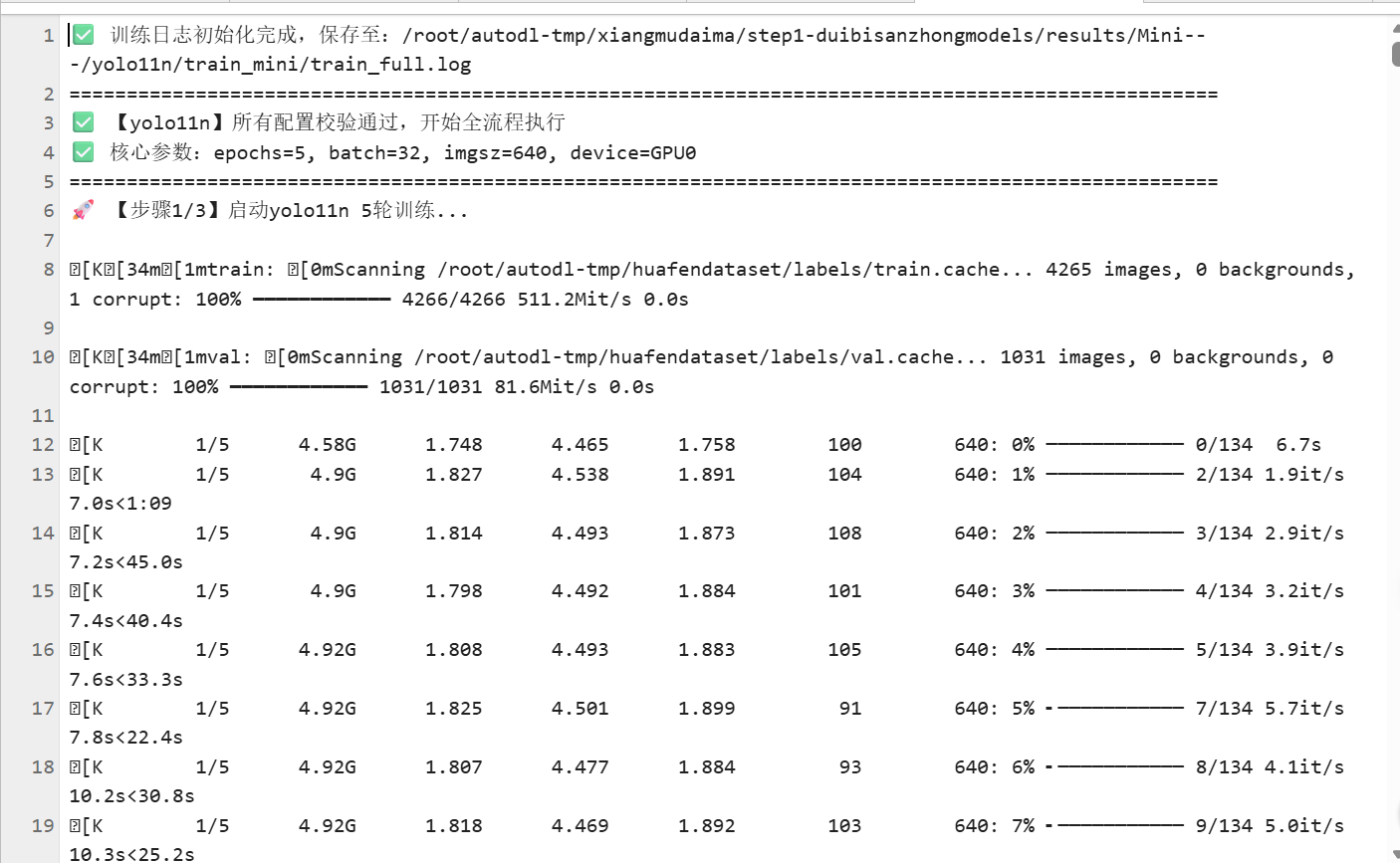

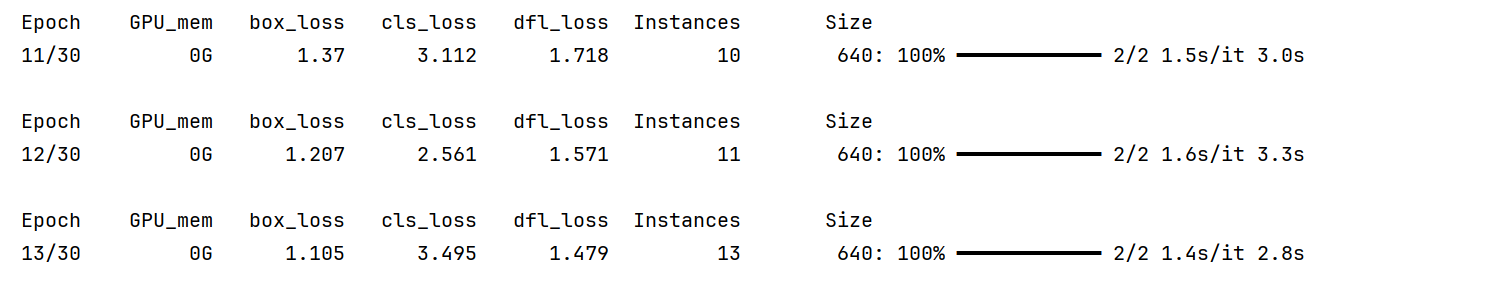

在用autodl训练模型时为什么终端和日志会显示的这么繁琐,而不像另一张图片里用PyCharm的轮数训练这样简洁,有什么解决方法吗?我都是在autodl上训练的。

在用autodl训练模型时为什么终端和日志会显示的这么繁琐,而不像另一张图片里用PyCharm的轮数训练这样简洁,有什么解决方法吗?我都是在autodl上训练的。

晚上好🌙🌙🌙

本答案参考通义千问

在使用 AutoDL(阿里云的深度学习平台)进行模型训练时,终端和日志显示繁琐是一个常见的问题,尤其是在没有图形化界面(如 PyCharm、Jupyter Notebook)的情况下,所有输出都会通过命令行方式展示。这与使用 PyCharm 等 IDE 的可视化界面相比,确实显得不够简洁。

torch.utils.tensorboard 或 logging 模块),日志内容就会显得杂乱。以下是几种提升 AutoDL 训练体验、使终端和日志更清晰的方法:

logging 模块简化输出通过 Python 的 logging 模块控制输出内容,只打印关键信息。

import logging

# 设置日志格式和级别

logging.basicConfig(level=logging.INFO, format='%(asctime)s - %(levelname)s - %(message)s')

# 在训练循环中使用 logging.info()

for epoch in range(epochs):

logging.info(f"Epoch {epoch + 1} started")

# ... 训练逻辑 ...

logging.info(f"Epoch {epoch + 1} finished with loss: {loss}")

重点:使用

logging模块可以统一管理输出信息,避免终端被冗余信息淹没。

TensorBoard 是 TensorFlow 提供的可视化工具,也可以用于 PyTorch 项目中。

pip install tensorboard

在训练脚本中添加以下代码:

from torch.utils.tensorboard import SummaryWriter

writer = SummaryWriter()

for epoch in range(epochs):

# 假设 loss 是当前 batch 的损失

writer.add_scalar("Loss/train", loss, epoch)

writer.add_scalar("Accuracy/train", accuracy, epoch)

writer.close()

然后在 AutoDL 终端运行:

tensorboard --logdir=./runs

重点:使用 TensorBoard 可以将训练过程可视化,而不是依赖终端文本输出。

虽然 AutoDL 主要基于命令行,但你可以通过以下方式提升体验:

重点:使用 IDE 能显著提升开发效率和日志可读性。

如果你不需要实时查看训练进度,可以将每一轮的训练结果保存为文件,便于后期分析。

with open("training_log.txt", "a") as f:

f.write(f"Epoch {epoch+1}: Loss={loss}, Accuracy={accuracy}\n")

重点:将训练日志保存为文件,避免终端被大量信息干扰。

tqdm 显示进度条tqdm 是一个常用的 Python 库,用于在训练过程中显示进度条,使输出更简洁。

pip install tqdm

from tqdm import tqdm

for epoch in range(epochs):

for batch in tqdm(train_loader, desc=f"Epoch {epoch+1}"):

# 训练逻辑

重点:使用

tqdm可以让训练过程更直观、更简洁。

| 方法 | 作用 |

|------|------|

| logging 模块 | 控制输出信息,避免冗余 |

| TensorBoard | 可视化训练过程 |

| Jupyter / VSCode | 提升开发体验 |

| 日志文件保存 | 避免终端混乱 |

| tqdm 进度条 | 显示训练进度,提高可读性 |

如果你能提供具体的训练代码或截图,我可以帮你进一步优化日志输出方式!