我准备用yolov8深度训练模型来实现一个智能识别胃肠镜息肉的这样一个功能,请问这个yolov8的模型能部署到这个Ti60F225上吗

我准备用yolov8深度训练模型来实现一个智能识别胃肠镜息肉的这样一个功能,请问这个yolov8的模型能部署到这个Ti60F225上吗

下午好🌅🌅🌅

本答案参考通义千问

你的问题是关于 YOLOv8 模型能否部署到 Ti60F225 这样的嵌入式设备上,并用于实现 胃肠镜息肉识别 的功能。以下是详细分析和解决方案。

Ti60F225 是一款由 德州仪器(TI) 推出的 Sitara 系列 ARM Cortex-A8 处理器,通常用于工业控制、嵌入式系统等场景。它的性能有限,一般为 1GHz 主频、单核 CPU,并且没有 GPU 或 NPU 加速模块。

重要提示:Ti60F225 并不支持现代深度学习模型的高效推理。

YOLOv8 模型不能直接部署到 Ti60F225 上进行实时推理。

如果你希望将 YOLOv8 模型部署到类似 Ti60F225 的嵌入式设备,可以考虑以下几种方式:

建议使用 TinyML 技术,比如 TensorFlow Lite Micro,适用于低功耗、低内存的嵌入式设备。

这些模型更适合嵌入式设备运行。

这些设备具备更强的计算能力,适合部署深度学习模型。

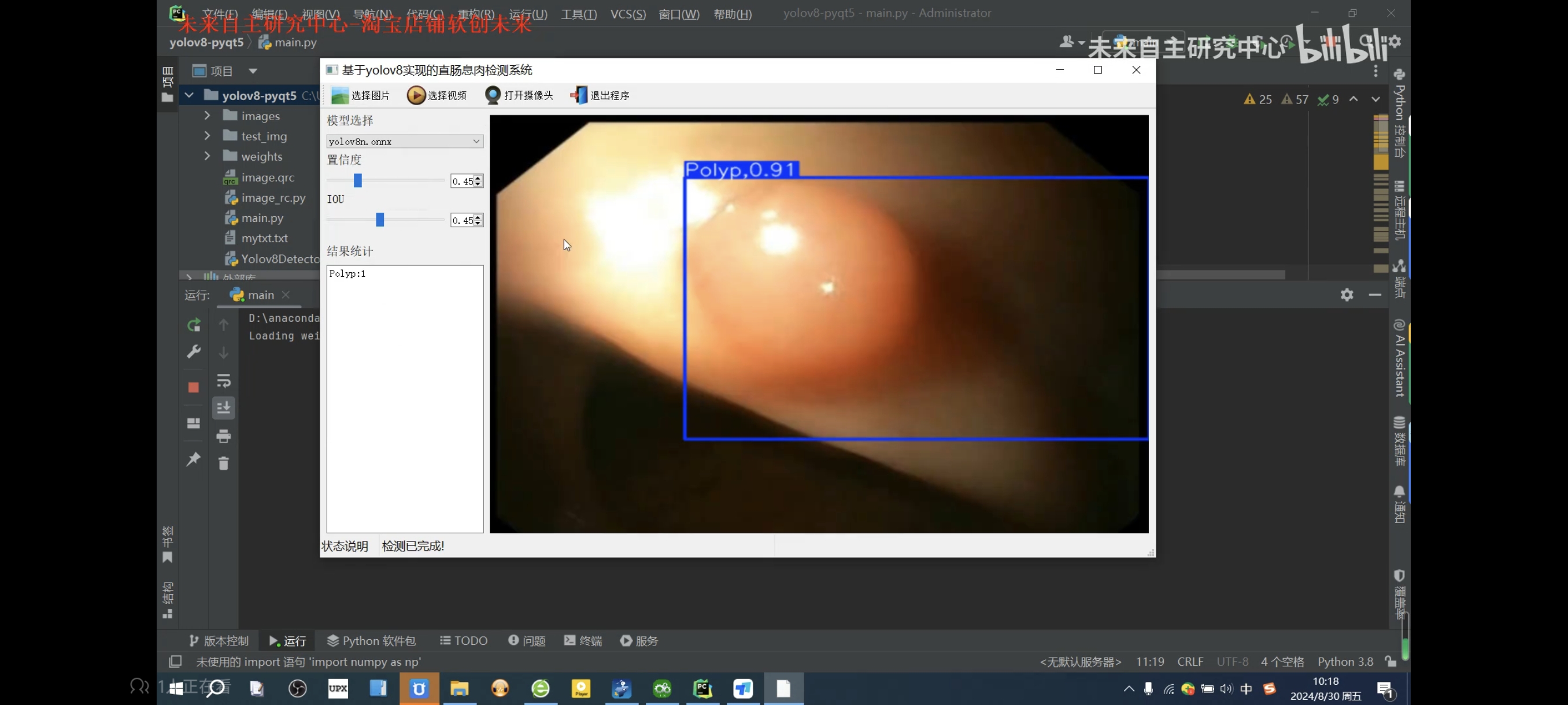

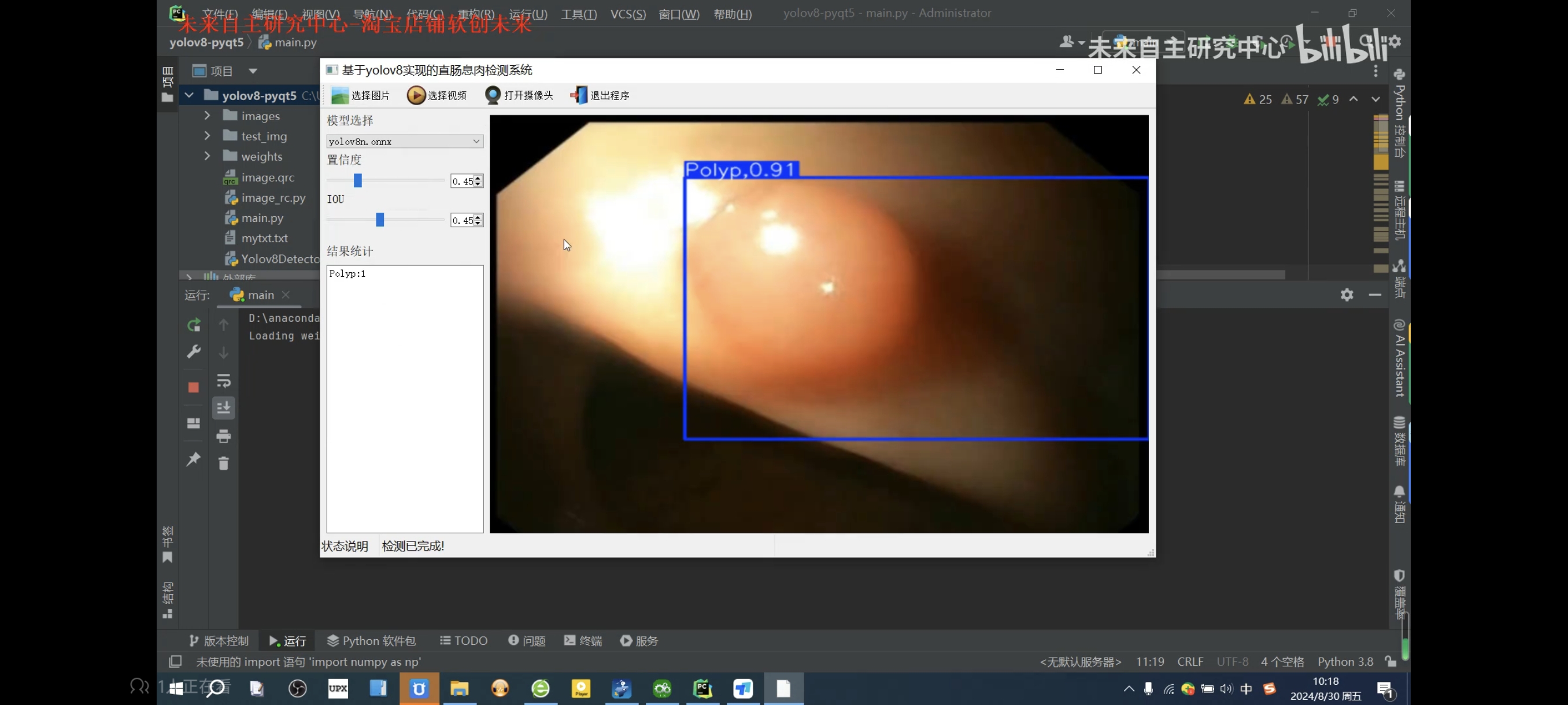

训练 YOLOv8 模型

导出为 ONNX 或 TFLite 格式

# 示例:导出为 ONNX 格式

from ultralytics import YOLO

model = YOLO("yolov8n.pt")

model.export(format="onnx") # 导出为 onnx 格式

在嵌入式设备上部署模型

优化模型性能

| 项目 | 内容 | |------|------| | Ti60F225 是否支持 YOLOv8? | ❌ 不支持,性能不足 | | 替代方案 | 模型优化、更换设备、使用轻量模型 | | 推荐设备 | NVIDIA Jetson Nano, Raspberry Pi 4, Rock Pi 4 | | 模型优化建议 | 量化、剪枝、转换为 TFLite/ONNX |

如果你决定使用 TensorFlow Lite 部署模型,可以参考以下代码:

import tensorflow as tf

# 加载 TFLite 模型

interpreter = tf.lite.Interpreter(model_path="yolov8n_quantized.tflite")

interpreter.allocate_tensors()

# 获取输入输出张量

input_details = interpreter.get_input_details()

output_details = interpreter.get_output_details()

# 输入数据预处理

input_data = preprocess(image) # 你需要自己实现图像预处理

interpreter.set_tensor(input_details[0]['index'], input_data)

# 推理

interpreter.invoke()

# 获取输出结果

output_data = interpreter.get_tensor(output_details[0]['index'])

如果你的硬件是 Ti60F225,建议不要使用 YOLOv8 模型。

建议改用更轻量的模型,或者升级到具有 NPU 的嵌入式设备,如 Jetson Nano。

如果你有更多关于模型训练、数据准备或部署的问题,欢迎继续提问!