让阿豪来帮你解答,本回答参考chatgpt3.5编写提供,如果还有疑问可以评论或留言

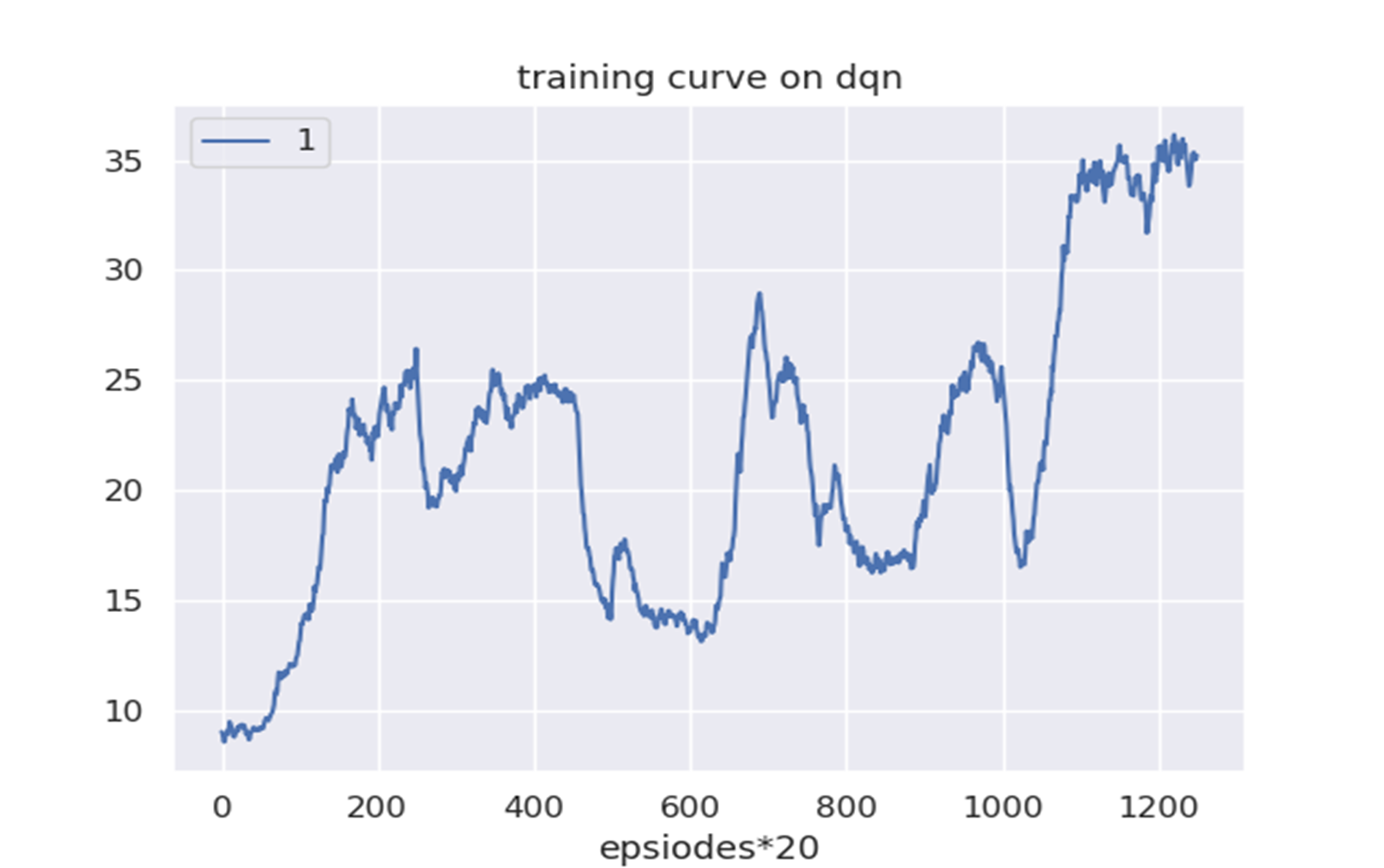

题目:如何处理模型训练过程中前面波动后面收敛的情况?

回答:

- 数据预处理:确保数据质量良好,尽量减小数据的噪声和异常值对模型训练的影响。

- 特征工程:对特征进行适当的处理和筛选,选择对模型最有用的特征,避免过度拟合。

- 超参数调整:调整模型的超参数,如学习率、正则化系数等,寻找最佳参数组合,使模型更快收敛。

- 梯度裁剪:在训练过程中对梯度进行裁剪,避免出现梯度爆炸或梯度消失的情况,有助于加快模型收敛速度。

- 模型选择:尝试不同的模型结构,选择更适合问题的模型,有时候问题本身可能导致模型难以收敛。

- 增加训练数据量:增加训练数据可以提高模型泛化能力,避免过拟合,加快模型收敛。 案例: 例如,在神经网络训练过程中,可以尝试调整学习率、使用更优化的优化器(如Adam、RMSprop等),或者增加数据增强的方法来改善模型收敛情况。 代码示例(以PyTorch为例):

optimizer = torch.optim.Adam(model.parameters(), lr=0.001)

自己觉得收敛了,但前面波动较大的情况可能是因为模型一开始参数随机初始化的影响,可以尝试增加训练时的Batchsize,增加数据量,或者调整模型结构等方法来改善。同时,可以监控训练过程中的损失曲线和准确率曲线,及时调整模型训练策略。

关注

关注