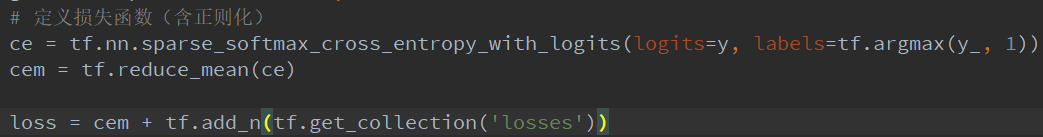

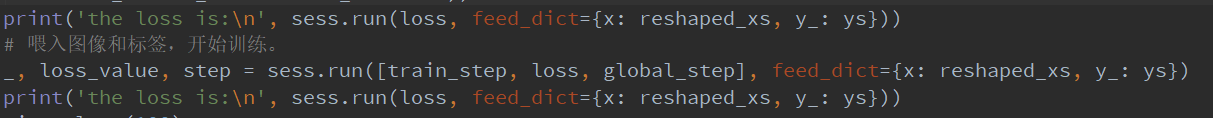

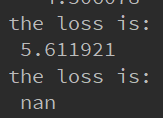

卷积神经网络训练,用的是mnist数据集,第一次训练前损失函数还是一个值,训练一次之后就变成nan了,使用的损失函数是ce = tf.nn.sparse_softmax_cross_entropy_with_logits(logits=y, labels=tf.argmax(y_, 1)),cem = tf.reduce.mean(ce),应该不会出现真数为零或负的情况,而且训练前loss是存在的,只是训练后变为nan,求各位大牛答疑解惑,感激不尽。

卷积神经网络训练loss变为nan

- 写回答

- 好问题 0 提建议

- 追加酬金

- 关注问题

- 邀请回答

-

1条回答 默认 最新

qq_38669600 2019-02-18 00:25关注

qq_38669600 2019-02-18 00:25关注你怎么训练的,有时候损失层中loss的计算可能导致NaN的出现或者梯度过大的话会导致Nan出现,建议检查激活函数的选择是不是好的,换换激活函数试试

解决 无用评论 打赏 举报

悬赏问题

- ¥15 thinkphp6配合social login单点登录问题

- ¥15 HFSS 中的 H 场图与 MATLAB 中绘制的 B1 场 部分对应不上

- ¥15 如何在scanpy上做差异基因和通路富集?

- ¥20 关于#硬件工程#的问题,请各位专家解答!

- ¥15 关于#matlab#的问题:期望的系统闭环传递函数为G(s)=wn^2/s^2+2¢wn+wn^2阻尼系数¢=0.707,使系统具有较小的超调量

- ¥15 FLUENT如何实现在堆积颗粒的上表面加载高斯热源

- ¥30 截图中的mathematics程序转换成matlab

- ¥15 动力学代码报错,维度不匹配

- ¥15 Power query添加列问题

- ¥50 Kubernetes&Fission&Eleasticsearch